Apache KafkaからAmazon S3へのメッセージのエクスポート

このレシピを使用して、Apache KafkaメッセージをAmazon Simple Storage Service (Amazon S3)バケットにエクスポートします。

ノート:

このレシピは、統合ストアでApache Kafka - Amazon S3 | メッセージのエクスポートとして使用できます。 Oracleには、サンプルとしてのみこのレシピが用意されています。 レシピはガイダンスのみを目的としており、エラーがないことは保証されていません。 このレシピはサポートされていません。

概要

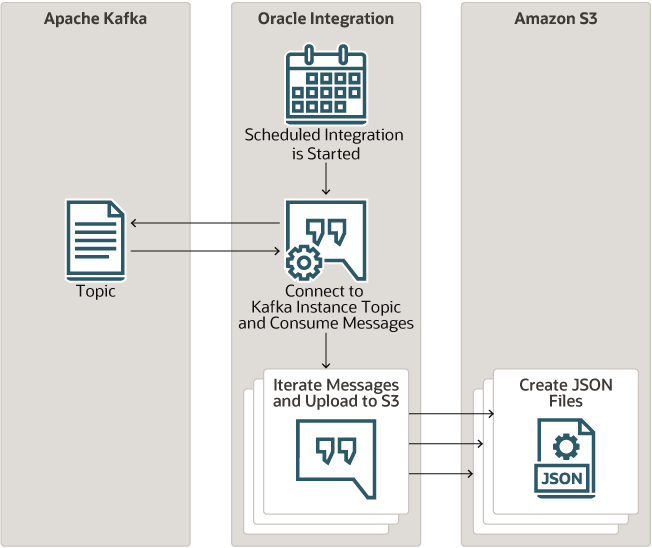

このレシピは、Apache KafkaトピックからAmazon S3バケットにメッセージをJSONファイルとしてエクスポートします。 各Apache Kafkaメッセージは、メッセージの内容を含むJSONファイルとしてエクスポートされます。 レシピでは、標準の「Apache Kafkaアダプタ」と標準の「RESTアダプタ」が使用されます。

レシピを使用するには、レシピ・パッケージをインストールし、レシピ・パッケージ内の接続および他のリソースを構成する必要があります。 その後、統合フローを手動でアクティブ化して実行することも、その実行スケジュールを指定することもできます。 トリガーされると、統合フローは、指定されたApache Kafkaトピック内のメッセージを問い合せ、事前定義された数のメッセージをロードします。 その後、統合によって各メッセージが反復され、指定されたAmazon S3バケットにJSONファイルとしてエクスポートされます。

システムおよびアクセスの要件

- Oracle Integration、バージョン21.2.1以上

- Amazon Web Services (AWS)とAmazon S3

- Apache Kafka

- Confluent

- 管理者ロールを持つAWSのアカウント

- 管理者ロールに影響を与える取引先

レシピ・スキーマ

このセクションでは、レシピのアーキテクチャの概要について説明します。

「図apachekafka-amazons3.pngの説明」

レシピの統合フローが実行スケジュールまたは手動送信によってトリガーされると、Apache Kafkaインスタンス・トピックにメッセージを問い合せます。 指定したトピックにメッセージが存在する場合、統合によって事前定義された数のメッセージがフェッチされます。 反復してメッセージをAmazon S3にエクスポートします。 エクスポートされたメッセージごとに、メッセージのコンテンツを含む対応するJSONファイルが、指定されたAmazon S3バケットに作成されます。

内容は次のとおりです。