Configuración de la replicación bidireccional entre dos bases de datos en la nube de la misma región

Después de configurar la replicación unidireccional, solo quedan algunos pasos adicionales para replicar datos en la dirección opuesta. En este ejemplo de inicio rápido se utilizan Autonomous AI Transaction Processing y Autonomous AI Lakehouse como sus dos bases de datos en la nube.

Antes de empezar

Debe tener dos bases de datos existentes en el mismo arrendamiento y región para continuar con este inicio rápido. Si necesita datos de ejemplo, descargue Archive.zip y, a continuación, siga las instrucciones de Laboratorio 1, Tarea 3: Carga del esquema de ATP.

Visión general

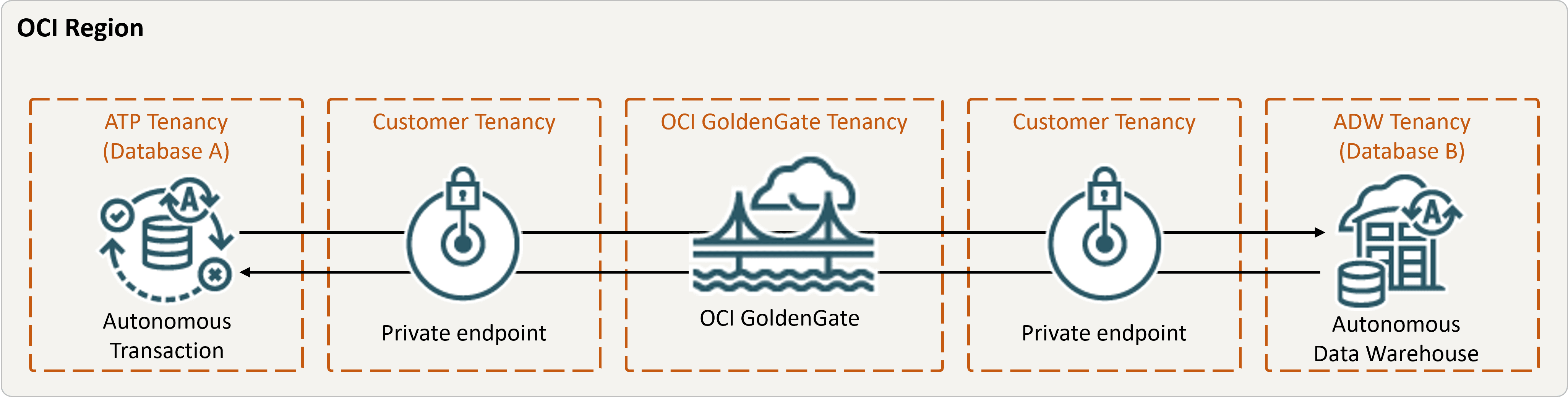

Los siguientes pasos le guiarán a través del proceso para instanciar una base de datos de destino mediante Oracle Data Pump y configurar una replicación bidireccional entre dos bases de datos de la misma región.

Descripción de la ilustración bidirectional.png

Tarea 2: Adición de la información de transacción y una tabla de puntos de control para ambas bases de datos

En la consola de despliegue de OCI GoldenGate, vaya a la pantalla Configuración del servicio de administración y, a continuación, complete lo siguiente:

Tarea 3: Creación del Extract integrado

Un Extract integrado captura los cambios en curso en la base de datos de origen.

Tarea 4: Exportación de datos mediante Oracle Data Pump (ExpDP)

Utilice Oracle Data Pump (ExpDP) para exportar datos de la base de datos de origen a Oracle Object Store.

Tarea 5: Instanciación de la base de datos de destino mediante Oracle Data Pump (ImpDP)

Utilice Oracle Data Pump (ImpDP) para importar datos a la base de datos de destino desde SRC_OCIGGLL.dmp que se ha exportado de la base de datos de origen.

Tarea 6: Adición y ejecución de un Replicat sin integrar

- Agregue y ejecute un Replicat.

- Realice algunos cambios en la base de datos A para verlos replicados en la base de datos B.

Tarea 7: Configuración de la replicación de la base de datos B a la base de datos A

En las tareas 1 a 6 se ha establecido la replicación de la base de datos A a la base de datos B. Los siguientes pasos permiten configurar la replicación de la base de datos B a la base de datos A.