Planifier votre déploiement

Déployez cette architecture en procédant comme suit :

- Mettez en correspondance les blocs de construction d'architecture avec les services Oracle Cloud Infrastructure.

- Planifier l'implémentation initiale en mettant l'accent sur l'orchestration des agents

- Améliorer l'implémentation initiale en ajoutant des agents et en intégrant un raisonnement LLM avancé

Mettre en correspondance les services OCI

Oracle Cloud Infrastructure (OCI) fournit tous les éléments de base nécessaires pour implémenter ce système de manière évolutive et native dans le cloud.

Mettez en correspondance chaque composant avec les services OCI comme suit.

- Implémentation de l'orchestrateur

Vous pouvez exécuter l'orchestrateur MCP sur une instance OCI Compute sur une machine virtuelle Oracle Linux ou en tant que conteneur sur OCI Kubernetes Engine. L'orchestrateur héberge le serveur GenAI Toolbox qui écoute les demandes d'agent et les achemine vers les outils. L'évolutivité d'OCI garantit que l'orchestrateur peut gérer plusieurs enquêtes simultanées sur les fraudes. Vous pouvez éventuellement utiliser OCI API Gateway pour exposer une adresse REST sécurisée pour l'orchestrateur afin que les systèmes externes ou les clients de démonstration puissent lancer le workflow.

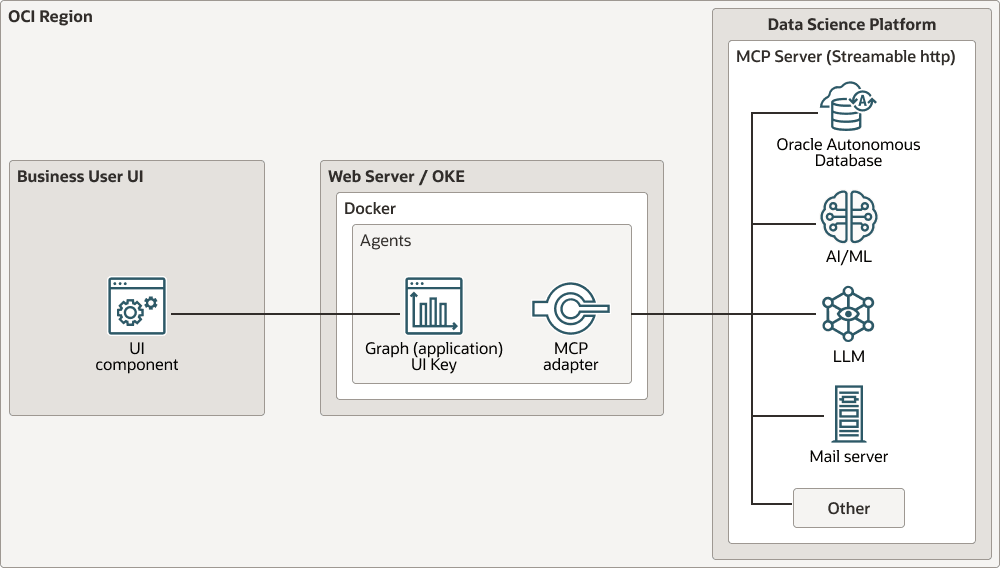

L'orchestrateur héberge tous les agents qui interagissent avec l'interface utilisateur et fournit également un routage vers les outils. Vous pouvez également héberger le serveur MCP dans Oracle Cloud Infrastructure Data Science, où les outils sont exposés à l'aide du protocole HTTP transmissible en continu.

- Agents en tant que fonctions sans serveur

La logique de chaque agent peut être déployée en tant que fonction OCI (microservice sans serveur) ou en tant que conteneur léger. Par exemple, l'agent d'extraction de données peut être une fonction OCI qui accepte des paramètres (ID, type de requête) et renvoie des données JSON à partir d'Autonomous Database. L'analyseur de fraude pourrait être une autre fonction qui prend des données et renvoie un score et un message. L'utilisation d'OCI Functions pour les agents simplifie le déploiement et offre une élasticité permettant de redimensionner automatiquement si de nombreuses analyses de fraude sont exécutées en parallèle. L'orchestrateur MCP appelle les adresses REST de ces fonctions à l'aide d'OCI API Gateway ou d'appels internes. Dans la phase 1, l'exécution de l'outil est simplifiée en exécutant les outils au sein du processus d'orchestration (comme le fait GenAI Toolbox) afin que l'orchestrateur lui-même puisse exécuter les outils de requête de base de données. Cependant, la conception d'agents en tant que fonctions OCI indépendantes fournit une modularité et facilite les démonstrations en montrant chaque fonction déclenchée dans l'ordre.

- Stockage et traitement des données

Oracle Autonomous Transaction Processing (ATP) est le référentiel sécurisé pour toutes les données financières pertinentes, telles que les journaux de transactions, les données de compte, les informations de stratégie et les cas de fraude historiques. Autonomous Database fournit des fonctionnalités d'analyse intégrées de redimensionnement automatique, de cryptage et de langage SQL, qui sont essentielles pour les charges de travail des services financiers du monde réel. L'agent de données utilise SQL et un client Oracle ou une interface de programmation d'application de données (API) REST pour extraire des données de la base. Vous pouvez également utiliser des outils tels qu'Oracle Machine Learning pour l'évaluation avancée si le modèle de fraude est entraîné dans la base de données. Pour diffuser des données de transaction, vous pouvez utiliser OCI Streaming ou Oracle GoldenGate pour alimenter le système en données. Pour un scénario de démonstration, une simple interrogation directe suffit.

- Services d'IA et de machine learning

Pour implémenter la logique de détection des fraudes, OCI propose plusieurs options. Dans la phase 1, les règles ou la détection d'anomalies sont codées directement. La phase 2 implémente les services Oracle AI :

- OCI Generative AI permet d'accéder à de grands modèles de langage pour la génération narrative et le raisonnement de l'agent d'analyseur de fraude. OCI Generative AI est un service entièrement géré proposant des LLM préentraînés qui peuvent être facilement intégrés aux applications. L'analyseur de fraude peut appeler ce service en utilisant son kit de développement logiciel (SDK) et son API avec une invite contenant les données de transaction et recevoir un texte d'explication de fraude en réponse.

- OCI Anomaly Detection évalue les transactions à la recherche d'anomalies en temps réel avec un score élevé indiquant une fraude potentielle. D'abord entraîné sur les données de transaction historiques, l'agent d'analyseur de fraude appelle simplement l'API de détection d'anomalies pour obtenir un score d'anomalie pour une transaction donnée. De même, OCI propose Data Science et Oracle Machine Learning pour entraîner des modèles de fraude personnalisés tels que l'augmentation du gradient ou des algorithmes de graphique pour la fraude. Vous pouvez déployer des modèles, tels qu'un modèle XGBoost pour la fraude, en tant qu'adresses à l'aide du déploiement de modèle Data Science afin qu'ils puissent être appelés par un agent. Pour simplifier la démonstration, vous pouvez contourner le modèle complexe et utiliser directement un petit jeu de règles ou une fonction de notation synthétique. L'architecture prend en charge l'échange ultérieur dans un modèle d'apprentissage automatique sophistiqué sans modifier l'orchestration.

- Oracle Cloud Infrastructure Language fournit des analyses de texte dans les cas où vous devez également analyser des notes ou des communications non structurées dans un cas de fraude. Toutefois, pour notre cas d'utilisation principal, les données structurées et le LLM fournissent les fonctionnalités nécessaires.

- Mise en réseau et intégration

La configuration de réseau cloud virtuel (VCN) et une passerelle de service OCI garantissent que l'orchestrateur et les agents qui utilisent des instances OCI Functions et OCI Compute peuvent communiquer en toute sécurité avec la base de données et les services d'IA sans exposer les données sur le réseau Internet public. OCI Identity and Access Management (IAM) contrôle l'accès afin que seuls l'orchestrateur et les agents puissent appeler les API de l'autre et accéder à la base de données. Ceci est important pour le maintien de la sécurité, en particulier dans un contexte financier. A des fins de démonstration, vous pouvez également configurer la surveillance à l'aide d'OCI Logging pour suivre les exécutions de fonction d'agent et les traces OCI Application Performance Monitoring afin d'afficher la latence de flux de bout en bout.

- Interface client

L'utilisateur interagit avec le système en utilisant un front-end Web ou mobile simple pour appeler la passerelle API OCI afin de déclencher une analyse, ou en utilisant une interface Oracle Digital Assistant (chatbot) pour une démonstration plus interactive. Par exemple, un analyste peut interagir avec l'agent d'analyseur de fraude en fournissant une invite de chatbot telle que "Investigate transaction #123" et le système répond à l'analyse. Oracle Digital Assistant peut être un ajout facultatif pour présenter un système frontal conversationnel, mais le cas d'utilisation principal peut simplement afficher les résultats sur un tableau de bord ou envoyer une alerte par courriel à l'aide d'OCI Notifications.

Phase 1 : Implémenter l'orchestration à l'aide de MCP

Lors de l'implémentation initiale, l'objectif est de s'assurer que le système peut orchestrer plusieurs agents et s'intégrer aux systèmes Oracle, avant d'ajouter une logique d'IA complexe.

Pour atteindre cet objectif, le plan met l'accent sur la mécanique d'orchestration des agents et utilise Google MCP Toolbox for Databases (également appelé Gen AI Toolbox) comme point de départ pour l'orchestrateur du protocole de contexte de modèle (MCP). La boîte à outils, une base de code open source sur GitHub, est un serveur MCP pour les bases de données conçues pour connecter les agents basés sur LLM aux bases de données SQL. Cette architecture adapte la boîte à outils pour Oracle Cloud Infrastructure (OCI) en branchant des outils propres à Oracle et en la déployant sur OCI.

La phase 1 de ce plan crée une colonne vertébrale d'orchestration opérationnelle sur OCI qui s'intègre avec succès à une base de données Oracle et inclut un serveur MCP central (Gen AI Toolbox) orchestrant au moins deux agents (extraction et analyse des données). La phase 2 de ce plan introduit un raisonnement plus avancé.

- Définitions d'outils

Dans la boîte à outils d'IA générative, un outil est une action qu'un agent peut effectuer, telle qu'une requête SQL spécifique. Un outil est défini de manière déclarative, par exemple à l'aide de YAML, et est accessible via le serveur MCP. Le cas d'emploi en cours crée un registre d'outils similaire pour les actions telles que "Extraire les transactions récentes pour l'utilisateur" ou "Obtenir les détails de la stratégie", chaque action étant mise en correspondance avec une requête de base de données Oracle ou avec un appel de fonction OCI. Le registre permet à un agent d'appeler ces outils par leur nom. L'avantage d'une approche basée sur la configuration est la flexibilité : vous pouvez mettre à jour ou ajouter de nouveaux outils sans redéployer l'ensemble de l'application. A des fins de démonstration, l'orchestration de la phase 1 peut être plus scripté, avec des outils appelés en séquence, mais l'architecture jette les bases de la phase 2 où l'agent peut décider dynamiquement quels outils utiliser.

- Structure d'orchestration

La boîte à outils d'IA générative fonctionne avec des structures d'orchestration d'agent telles que LangChain/Langraph et LlamaIndex AgentWorkflow. Dans cette implémentation, le serveur MCP coordonne la séquence des appels d'agent. Vous pouvez créer un script pour l'orchestration à l'aide d'un workflow simple, tel que l'appel de l'agent de données, l'appel de l'agent de fraude, puis la prise de décision. Vous pouvez le faire avec du code personnalisé ou en utilisant une bibliothèque de flux de travail existante. Il est utile de tirer parti de toutes les bibliothèques ou modèles client de la boîte à outils d'IA générative pour maintenir le contexte. L'orchestrateur utilise le résultat de l'agent de données comme entrée dans la structure d'invite/d'entrée de l'agent de fraude. La phase 1 garantit que le workflow fonctionne correctement et que le contexte est préservé avec précision entre les étapes. Il en résulte une couche d'orchestration qui simplifie l'exécution d'un système d'agents, maintient le contexte entre les étapes et prend en charge les workflows multi-agents comme décrit pour AgentWorkflow, mais implémenté dans ce cas avec les services OCI.

- Observabilité et journalisation

Gen AI Toolbox est livré avec la prise en charge intégrée de OpenTelemetry pour la surveillance de l'utilisation des outils. OCI Logging fournit la journalisation de chaque appel d'agent et d'outil pour faciliter le débogage et fournir une visibilité sur ce que chaque agent fait lors des démonstrations. La phase 1 peut utiliser la console ou les journaux OCI pour montrer comment l'orchestrateur appelle une fonction pour interroger la base de données, ce qui a été renvoyé, puis comment l'analyse de la fraude a été effectuée. Cette transparence séduit les parties prenantes et contribue à renforcer la confiance dans les décisions prises en matière d'IA.

Phase 2 : Implémenter l'intelligence LLM améliorée

La deuxième phase de ce plan intègre le raisonnement avancé du grand modèle de langage (LLM) et des agents supplémentaires pour rendre le système plus autonome et plus perspicace.

L'architecture fondamentale reste largement la même que dans la phase 1, mais vous remplacez ou augmentez simplement les internes des agents et en ajoutez de nouveaux. Le serveur MCP reste la colle d'intégration, le courtage entre l'agent LLM et la base de données OCI, les fonctions, etc. Cette approche progressive montre des progrès incrémentiels en démontrant d'abord l'épine dorsale dans OCI avec une logique simple, puis en branchant un puissant LLM pour rendre le système beaucoup plus intelligent dans l'explication et le traitement des cas de fraude.

- Raisonnement d'agent piloté par LLM

Au lieu d'effectuer des actions dans une séquence fixe, l'agent d'analyseur de fraude de la phase 2 utilise OCI Generative AI et un LLM pour décider dynamiquement quels outils appeler et quand. Par exemple, compte tenu d'une instruction ouverte ("Investiguer cette réclamation pour fraude"), l'invite de l'agent pourrait énumérer les outils disponibles (requêtes de base de données, contrôle des sanctions, etc.) et le LLM pourrait planifier une séquence d'appels. Cela ressemble à un agent de type ReAct ou à l'utilisation des capacités de planification de LangChain. L'orchestrateur MCP facilite ces interactions d'agent à outil, en bouclant les décisions du LLM via des exécutions d'outils et en renvoyant des résultats. Le service Oracle Cloud Infrastructure Generative AI Agents met l'accent sur l'orchestration des outils pour gérer les workflows complexes. Dans l'architecture actuelle, nous implémentons ce concept en combinant l'approche Gen AI Toolbox avec le LLM d'OCI. Vous pouvez intégrer des structures telles que LangChain (prise en charge dans Oracle Cloud Infrastructure Data Science) pour faciliter la gestion des invites, telles que "Outil : GetRecentTransactions(user_id=123)", et pour analyser les sorties de LLM que l'orchestrateur peut exécuter. Cette capacité fait de l'analyseur de fraude un agent plus cognitif capable de raisonner en plusieurs étapes qui permet des dialogues d'enquête plus complexes.

- Agents et outils supplémentaires

Vous pouvez introduire des agents supplémentaires pour élargir les capacités du système. Par exemple, un agent d'analyse de graphes peut utiliser l'analyse réseau, telle qu'une base de données de graphes ou un modèle de machine learning, pour trouver des relations entre des entités, telles que des e-mails ou des appareils courants sur des comptes utilisés par des anneaux de fraude. Un autre peut être un agent d'explication qui vérifie spécifiquement la conformité des sorties ou simplifie le langage pour une explication orientée client. Chaque agent utilise un service OCI spécifique : un agent graphique peut utiliser Oracle Graph ou une bibliothèque d'analyse réseau dans Data Science. L'orchestrateur MCP peut coordonner ces agents en parallèle ou en séquence selon les besoins. Par exemple, une fois l'agent d'analyse des fraudes terminé, l'orchestrateur peut déclencher un agent de notification qui utilise OCI Email Delivery ou OCI Notifications pour envoyer un rapport aux enquêteurs. L'orchestrateur fonctionne comme un chef d'orchestre : l'ajout d'agents enrichit l'orchestre d'analyse sans avoir besoin d'une réécriture de la logique de base.

- Boucle de retour d'apprentissage automatique

La phase 2 peut intégrer l'apprentissage au fil du temps. Tous les résultats, confirmés ou non par une fraude, peuvent être intégrés à Oracle Autonomous Data Warehouse et utilisés pour réentraîner les modèles à l'aide de pipelines Data Science. Bien qu'elle ne fasse pas partie de l'orchestration des agents en temps réel, elle ferme la boucle dans le cycle de vie de la solution. En démontrant qu'OCI peut non seulement effectuer la détection, mais également l'améliorer en utilisant des données historiques avec AutoML ou Oracle Machine Learning, vous pouvez montrer une amélioration continue aux parties prenantes.