Migrer Hadoop vers Oracle à l'aide du service Migrator WANdisco LiveData

LiveData Le migreur est déployé sur un noeud de périphérie du cluster Hadoop. Le déploiement est effectué en quelques minutes sans impact sur les opérations de production en cours. Les utilisateurs peuvent commencer à utiliser le produit immédiatement à l'aide de la ligne de commande, de l'API REST ou de l'interface utilisateur pour effectuer la migration.

A propos de la migration des données Hadoop

Voici les étapes standard d'une migration d'Apache Hadoop vers le cloud :

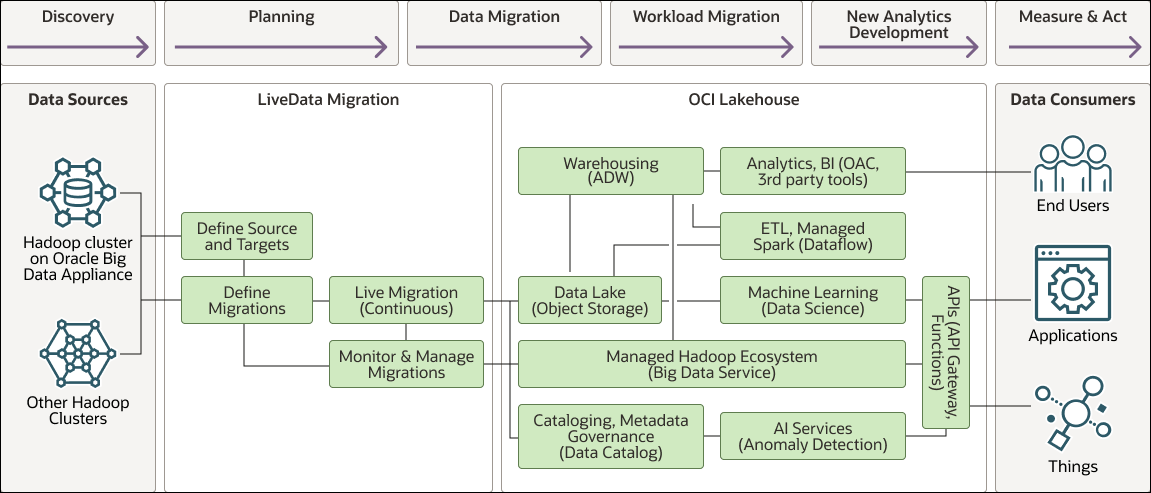

Le diagramme suivant illustre l'architecture et les composants du flux.

Description de l'illustration hadoop-lakehouse-migration.png ci-après

hadoop-lakehouse-migration-oracle.zip

- Repérage : identifiez les ensembles de données et les charges de travail à migrer vers le cloud.

- Planification : élaborer un plan et une chronologie pour les phases d'exécution de la migration.

- Migration des données : effectuez la migration des données requises de l'environnement Hadoop sur site vers le cloud.

- Migration de charge globale : effectuez la migration des charges de travail et/ou des applications de l'environnement sur site vers le cloud.

- Nouveau développement d'analyses : commencez à développer de nouvelles analyses, une IA et un apprentissage automatique, puis tirez parti du nouvel environnement cloud.

- Mesure et action : effectuez des analyses pour mesurer les indicateurs clés de performance, évaluer les performances, établir des prévisions et permettre à l'entreprise d'agir de manière appropriée.

Pour tenter de simplifier la migration vers le cloud, de nombreuses entreprises choisissent de suivre une stratégie de migration " transfert et transfert ". Cette stratégie suppose de manière simplifiée que la migration peut être effectuée sans apporter de modifications aux données ou aux applications. La logique est " juste de les déplacer lorsqu'ils sont dans le Cloud ". Cette hypothèse entraîne de nombreux projets ou projets en échec qui dépassent leur temps et leurs coûts. Il nécessite soit que les systèmes existants soient mis hors service pour s'assurer qu'aucun changement de données ne se produise, soit que les organisations passent du temps à développer des solutions personnalisées pour gérer les changements de données. D'autres inconvénients de cette stratégie sont, d'abord, qu'elle exige que les entreprises effectuent un basculement en même temps de l'ensemble des applications et des données. Deuxièmement, elle ne tire pas parti des nouvelles fonctionnalités cloud.

WANdisco favorise une approche axée sur les données pour les migrations de lac de données. Une approche axée sur les données consiste à transférer les données rapidement et à ne pas tenter de migrer toutes les applications existantes en même temps. Cette approche accélère la mise à disposition des données par les data scientists afin qu'ils puissent commencer à utiliser les données migrées dès le premier jour. Cela permet de consacrer beaucoup plus de temps aux nouvelles informations et innovations en matière d'IA. Les entreprises peuvent démontrer un retour sur investissement plus rapide dans la migration vers le cloud, tandis que les charges de travail de production sur site existantes peuvent continuer à être exécutées sans incidence. Cette approche offre également une flexibilité pour la migration des applications et de la charge globale. Elle permet d'éviter toute approche Big Bang et donne aux entreprises du temps nécessaire pour optimiser les charges de travail du nouvel environnement cloud, en s'assurant de son exécution optimale et en tirant parti des nouvelles fonctionnalités qui leur sont offertes. Les entreprises peuvent effectuer autant de tests parallèles que nécessaire pour s'assurer qu'elles ne subiront aucun coût caché, et une approche axée sur les données leur donne également le temps de déterminer si certaines applications n'ont pas besoin d'être migrées du tout, mais plutôt de les remplacer par le nouveau développement qui a eu lieu.

Définir des sources et des cibles

Pendant le déploiement, WANdisco LiveData Migrator repère automatiquement le cluster Apache Hadoop Distributed File System (HDFS) source, de sorte que vous n'avez qu'à définir l'environnement cible.

Définir la migration

Les migrations transfèrent les données existantes de la source vers la cible définie. WANdisco LiveData Migrator migre les modifications apportées aux données source pendant leur migration et s'assure que la cible est à jour avec ces modifications. Pour ce faire, il continue à effectuer la migration.

Les utilisateurs créent généralement plusieurs migrations afin qu'ils puissent sélectionner un contenu spécifique à partir du système de fichiers source par chemin. Vous pouvez également effectuer une migration vers plusieurs systèmes de fichiers indépendants en même temps en définissant plusieurs cibles de migration.

Pour créer une migration, indiquez un nom de migration, sélectionnez les systèmes de fichiers source et cible et indiquez le chemin d'accès au système de fichiers source à migrer. Vous pouvez éventuellement appliquer des exclusions pour spécifier des règles pour les données qui doivent être exclues d'une migration et appliquer d'autres paramètres de configuration facultatifs.

LiveData Migrator prend également en charge la migration des métadonnées Hive de la source vers les métastores cible. LiveData Migrator se connecte aux métastores via l'utilisation d'agents de métadonnées locaux ou distants. Les règles de métadonnées sont ensuite utilisées pour définir les métadonnées à migrer de la source vers la cible.

Lors de la définition des migrations, vous pouvez spécifier de démarrer automatiquement la migration et de déterminer s'il s'agit d'une migration en direct, ce qui signifie qu'elle appliquera en permanence toutes les modifications en cours de la source vers la cible.