使用 WANdisco LiveData 移轉程式將 Hadoop 移轉至 Oracle

LiveData 移轉程式部署在 Hadoop 叢集的邊緣節點上。只需幾分鐘即可執行部署,不會影響目前的生產作業。使用者可以使用命令行、REST API 或使用者介面 (UI) 立即開始使用產品,以執行移轉。

關於移轉 Hadoop 資料

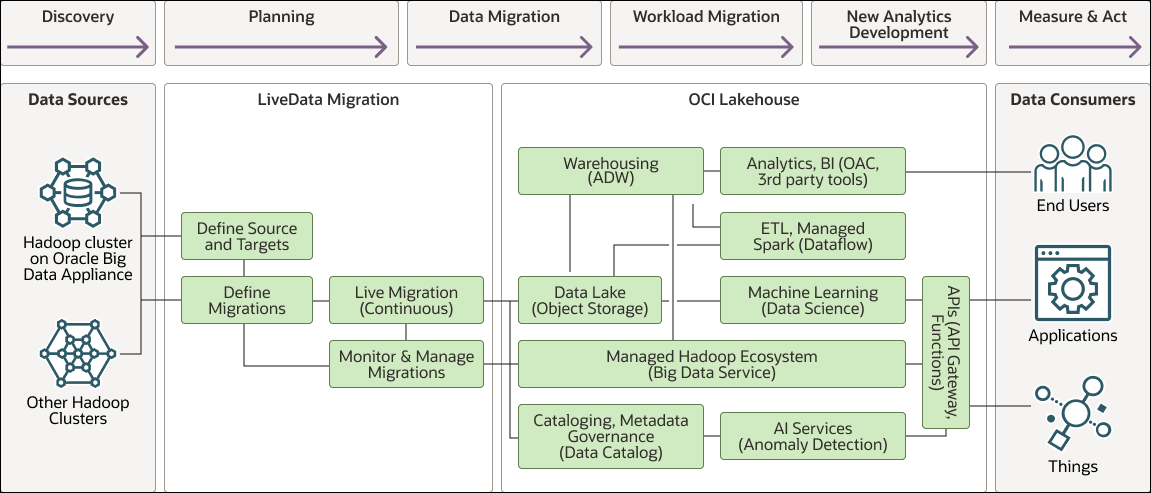

以下是 Apache Hadoop 與雲端移轉有關的典型步驟:

下圖說明流程架構與元件。

hadoop-lakehouse-migration.png 圖解說明

hadoop-lakehouse-migration-oracle.zip

- 尋找:識別要移轉至雲端的資料集與工作負載。

- 計畫:開發執行移轉之階段的計畫與時間軸。

- 資料移轉:執行將資料從企業內部部署的 Hadoop 環境移轉至雲端。

- 工作負載移轉:執行將工作量和 (或) 應用系統從企業內部部署環境移轉至雲端的工作負載。

- 新的分析開發:開始開發新的分析、AI 和機器學習,藉此利用新的雲端環境。

- 評量與動作:執行分析以評量 KPI、評估績效、進行預測,以及讓業務能夠適當採取行動。

為了嘗試並簡化雲端移轉作業,許多組織會選擇遵循「原封不動移轉」的移轉策略。此策略會假設在不對資料或應用程式進行任何變更的情況下,即可執行移轉。邏輯就是「將它們隨著雲端而移動。」此假設導致許多失敗的專案或專案超過其時間與成本。它需要將現有系統關機,以確保不會發生資料變更,也需要組織花時間開發自訂解決方案來處理資料變更。除了這個策略之外,組織還需要組織同時執行所有應用系統和資料的大邦切換,而第二,它無法利用新的雲端功能。

WANdisco 提供資料優先方法以進行資料湖移轉。資料優先方法的重點在於快速移動資料,不會嘗試同時移轉所有現有的應用程式。這些焦點讓資料分析師更快地運用,以便從第一天開始使用移轉的資料。實現更快速的洞察力和全新的 AI 創新。組織可證明雲端移轉的投資報酬率加快,但現有的企業內部部署生產環境工作負載仍可繼續執行,不受影響。這個方法也提供靈活的應用程式與工作負載移轉選項。它可避免任何大港方法,同時為組織提供時間將新雲端環境的工作負載最佳化,確保新系統以最佳方式執行,並充分利用這些新功能。組織可以視需要進行平行測試,以確保不會體驗任何隱藏的成本,而且資料優先方法也能夠讓他們決定某些應用系統是否不需要全部移轉,而是用新的開發取代。

定義移轉

移轉會將現有資料從來源傳輸至定義的目標。WANdisco LiveData 移轉程式會在移轉來源資料時移轉對來源資料所做的任何變更,並確保目標與這些變更保持在最新狀態。這麼做會繼續執行移轉。

使用者通常會建立多個移轉,以便依路徑從來源檔案系統選取特定內容。您也可以定義多個移轉目標,同時移轉至多個獨立檔案系統。

若要建立移轉,請提供移轉名稱,選取來源和目標檔案系統,並指定要移轉的來源檔案系統路徑。或者,您可以套用排除項目來指定應從移轉排除的資料規則,也可以套用其他選擇性組態設定值。

LiveData Migrator 也支援將 Hive 描述資料從來源移轉至目標描述資料存放區。LiveData Migrator 透過使用本機或遠端描述資料代理程式連線至描述資料存放區。接著,描述資料規則會用來定義要從來源移轉至目標的描述資料。

定義移轉時,您可以指定自動開始移轉,並判斷是否應為即時移轉,這意味著它會持續將任何從來源到目標的持續變更套用。