| ナビゲーションリンクをスキップ | |

| 印刷ビューの終了 | |

|

Oracle Solaris Cluster システム管理 Oracle Solaris Cluster 4.0 (日本語) |

| ナビゲーションリンクをスキップ | |

| 印刷ビューの終了 | |

|

Oracle Solaris Cluster システム管理 Oracle Solaris Cluster 4.0 (日本語) |

1. Oracle Solaris Cluster の管理の概要

2. Oracle Solaris Cluster と RBAC

5. グローバルデバイス、ディスクパス監視、およびクラスタファイルシステムの管理

7. クラスタインターコネクトとパブリックネットワークの管理

StorageTek Availability Suite ソフトウェアを使用したホストベースのデータ複製の構成

クラスタにおける StorageTek Availability Suite ソフトウェアの理解

StorageTek Availability Suite ソフトウェアが使用するデータ複製方式

クラスタ間でホストベースのデータ複製を構成するためのガイドライン

プライマリクラスタのファイルシステムを NFS アプリケーション向けに構成する方法

セカンダリクラスタのファイルシステムを NFS アプリケーション向けに構成する方法

プライマリクラスタで NFS アプリケーションリソースグループを作成する方法

この付録では、Oracle Solaris Cluster Geographic Edition を使用しない、ホストベースの複製の代替方法を説明します。 Oracle では、ホストベースの複製に Oracle Solaris Cluster Geographic Edition を使用して、クラスタ間のホストベースの複製の構成と操作を簡素化することをお勧めします。「データ複製についての理解」を参照してください。

この付録の例は、StorageTek Availability Suite ソフトウェアを使用してクラスタ間のホストベースのデータ複製を構成する方法を示しています。この例では、NFS アプリケーション用の完全なクラスタ構成を示し、個別のタスクの実行方法に関する詳細情報を提供します。すべてのタスクはグローバルクラスタの投票ノードで行われます。例には、ほかのアプリケーションやクラスタ構成で必要な手順がすべて含まれているわけではありません。

スーパーユーザーの代わりに役割に基づくアクセス制御 (RBAC) を使用してクラスタノードにアクセスする場合は、すべての Oracle Solaris Cluster コマンドの承認を提供する RBAC の役割になることができるようにします。ユーザーがスーパーユーザーでない場合、一連のデータ複製手順には、次の Oracle Solaris Cluster RBAC の承認が必要です。

solaris.cluster.modify

solaris.cluster.admin

solaris.cluster.read

RBAC の役割についての詳細は、『Oracle Solaris の管理: セキュリティーサービス』を参照してください。各 Oracle Solaris Cluster サブコマンドで必要となる RBAC の承認については、Oracle Solaris Cluster のマニュアルページを参照してください。

ここでは、耐障害性について紹介し、StorageTek Availability Suite ソフトウェアが使用するデータ複製方式について説明します。

耐障害性は、プライマリクラスタに障害が発生した場合に、アプリケーションを代替クラスタに復元する機能です。災害耐性のベースは、データ複製とテイクオーバーです。テイクオーバーは、1 つ以上のリソースグループおよびデバイスグループをオンラインにすることにより、アプリケーションサービスをセカンダリクラスタに再配置します。

プライマリクラスタおよびセカンダリクラスタ間でデータが同期して複製されている場合、プライマリサイトで障害が発生してもコミットされたデータは失われません。ただし、データが非同期で複製されていた場合、プライマリサイトで障害が発生する前にセカンダリクラスタに複製されていなかったデータがある可能性があり、それらのデータは失われます。

このセクションでは、StorageTek Availability Suite が使用するリモートミラー複製方式とポイントインタイムスナップショット方式について説明します。このソフトウェアは、sndradm と iiadm コマンドを使用してデータを複製します。詳細は、sndradm(1M) および iiadm(1M) のマニュアルページを参照してください。

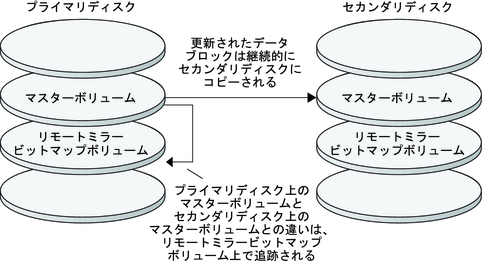

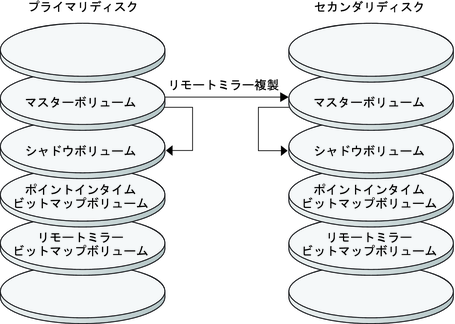

図 A-1 はリモートミラー複製を示しています。プライマリディスクのマスターボリュームのデータは、TCP/IP 接続を経由してセカンダリディスクのマスターボリュームに複製されます。リモートミラービットマップは、プライマリディスク上のマスターボリュームと、セカンダリディスク上のマスターボリュームの差分を追跡します。

図 A-1 リモートミラー複製

リモートミラー複製は、リアルタイムに同期で実行することも非同期で実行することもできます。各クラスタの各ボリュームセットはそれぞれ、同期複製または非同期複製に構成できます。

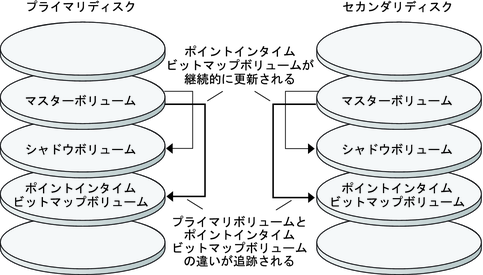

図 A-2 は、ポイントインタイムスナップショットを示しています。各ディスクのマスターボリュームのデータは、同じディスクのシャドウボリュームにコピーされます。ポイントインタイムピットマップは、マスターボリュームとシャドウボリューム間の違いを追跡調査します。データがシャドウボリュームにコピーされると、ポイントインタイムビットマップはリセットされます。

図 A-2 ポイントインタイムスナップショット

図 A-3 に、この構成例でミラー複製とポイントインタイムスナップショットがどのように使用されているかを示します。

図 A-3 構成例での複製

このセクションでは、クラスタ間のデータ複製の構成ガイドラインを提供します。また、複製リソースグループとアプリケーションリソースグループの構成のコツも紹介します。これらのガイドラインは、クラスタのデータ複製を構成する際に使用してください。

このセクションでは、次の項目について説明します。

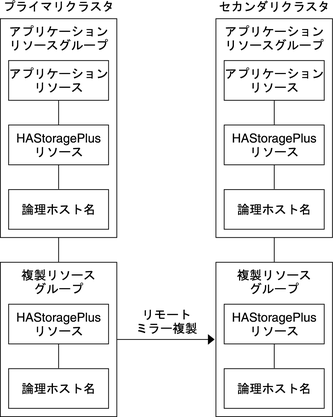

複製リソースグループは、StorageTek Availability Suite ソフトウェアの制御下にあるデバイスグループと論理ホスト名リソースを結び付けます。論理ホスト名は、データ複製ストリームの各終端に存在し、デバイスへのプライマリ入出力パスとして動作しているのと同じクラスタノードにある必要があります。複製リソースグループには、次の特徴があります。

フェイルオーバーリソースグループである

フェイルオーバーリソースは、常に単一のノード上で実行されます。フェイルオーバーが発生すると、フェイルオーバーリソースがフェイルオーバーに加わります。

論理ホスト名は、各クラスタ (プライマリおよびセカンダリ) 内のいずれかのノードでホストされ、StorageTek Availability Suite ソフトウェアのデータ複製ストリームのソースおよびターゲットアドレスを提供するために使用されます。

HAStoragePlus リソースを持つ

HAStoragePlus リソースは、複製リソースグループがスイッチオーバーまたはフェイルオーバーしたときに、デバイスグループをフェイルオーバーします。Oracle Solaris Cluster ソフトウェアはまた、デバイスグループがスイッチオーバーしたときに、複製リソースグループをフェイルオーバーします。このように複製リソースグループとデバイスグループは常に結び付き、同じノードから制御されます。

HAStoragePlus リソース内に次の拡張プロパティーを定義する必要があります。

GlobalDevicePaths。この拡張プロパティーは、ボリュームが属するデバイスグループを定義します。

AffinityOn property = True。この拡張プロパティーは、複製リソースグループがスイッチオーバーまたはフェイルオーバーしたときに、デバイスグループをスイッチオーバーまたはフェイルオーバーします。この機能はアフィニティースイッチオーバーと呼ばれます。

HAStoragePlus についての詳細は、SUNW.HAStoragePlus(5) のマニュアルページを参照してください。

結び付いているデバイスグループに -stor-rg を付けた名前になる

たとえば、devgrp-stor-rg などです。

プライマリクラスタとセカンダリクラスタでオンラインになる

高可用性を実現するためには、アプリケーションはアプリケーションリソースグループのリソースとして管理される必要があります。アプリケーションリソースグループは、フェイルオーバーアプリケーションまたはスケーラブルアプリケーション向けに構成できます。

HAStoragePlus リソース内で ZPoolsSearchDir 拡張プロパティーを定義する必要があります。この拡張プロパティーは、ZFS ファイルシステムを使用するために必要です。

プライマリクラスタ上に構成したアプリケーションリソースとアプリケーションリソースグループは、セカンダリクラスタ上でも構成される必要があります。また、アプリケーションリソースがアクセスするデータは、セカンダリクラスタに複製する必要があります。

このセクションでは、次のアプリケーションリソースグループを構成するためのガイドラインを紹介します。

フェイルオーバーアプリケーションでは、1 つのアプリケーションが 1 度に 1 ノード上で動作します。ノードで障害が発生すると、アプリケーションは同じクラスタ内の別のノードにフェイルオーバーします。フェイルオーバーアプリケーション向けリソースグループは、以下の特徴を持っていなければなりません。

アプリケーションリソースグループがスイッチオーバーまたはフェイルオーバーされた場合、HAStoragePlus リソースにファイルシステムまたは zpool をフェイルオーバーさせる

デバイスグループは、複製リソースグループとアプリケーションリソースグループに結び付けられています。したがって、アプリケーションリソースグループがフェイルオーバーすると、デバイスグループと複製リソースグループもフェイルオーバーします。アプリケーションリソースグループ、複製リソースグループおよびデバイスグループは、同じノードによって制御されます。

ただし、デバイスグループや複製リソースグループがフェイルオーバーしても、アプリケーションリソースグループはフェイルオーバーを行いません。

アプリケーションデータがグローバルマウントされている場合は、アプリケーションリソースグループに HAStoragePlus リソースを必ず入れなければならないわけではありませんが、入れることをお勧めします。

アプリケーションデータがローカルマウントされている場合は、アプリケーションリソースグループに HAStoragePlus リソースを必ず入れなければなりません。

HAStoragePlus についての詳細は、SUNW.HAStoragePlus(5) のマニュアルページを参照してください。

プライマリクラスタでオンライン、セカンダリクラスタでオフラインとなる

セカンダリクラスタがプライマリクラスタをテイクオーバーした場合は、セカンダリクラスタ上のアプリケーションリソースグループをオンラインにします。

図 A-4 に、フェイルオーバーアプリケーションでのアプリケーションリソースグループと複製リソースグループの構成を示します。

図 A-4 フェイルオーバーアプリケーションでのリソースグループの構成

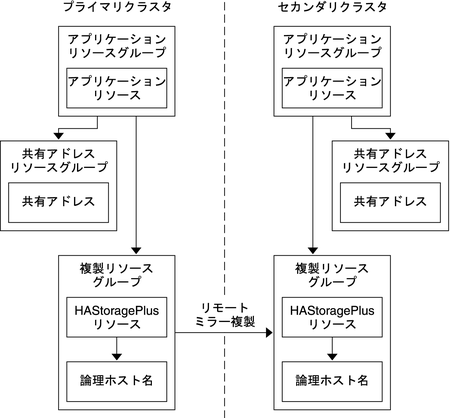

スケーラブルアプリケーションでは、アプリケーションは複数のノードで実行されて、1つの論理サービスを作成します。スケーラブルアプリケーションを実行しているノードで障害が発生しても、フェイルオーバーは起こりません。アプリケーションは別のノードで引き続き実行されます。

スケーラブルアプリケーションをアプリケーションリソースグループのリソースとして管理している場合は、アプリケーションリソースグループをデバイスグループと結び付ける必要はありません。したがって、アプリケーションリソースグループ向けに HAStoragePlus リソースを作成する必要はありません。

スケーラブルアプリケーション向けリソースグループは、以下の特徴を持っていなければなりません。

共有アドレスは、受信データを配信するためにスケーラブルアプリケーションを実行するノードで使用されます。

プライマリクラスタでオンライン、セカンダリクラスタでオフラインとなる

図 A-5 に、スケーラブルアプリケーションでのリソースグループの構成を示します。

図 A-5 スケーラブルアプリケーションでのリソースグループの構成

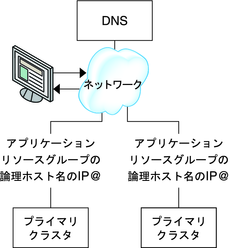

プライマリクラスタに障害が発生した場合、アプリケーションをできるだけ早くセカンダリクラスタにスイッチオーバーする必要があります。セカンダリクラスタがテイクオーバーできるようにするには、DNS を更新する必要があります。

クライアントは DNS を使用して、アプリケーションの論理ホスト名を IP アドレスにマップします。アプリケーションをセカンダリクラスタに移動することによりテイクオーバーを行ったあとに、アプリケーションの論理ホスト名と新しい IPアドレス間のマッピングが反映されるように DNS 情報を更新する必要があります。

図 A-6 クライアントからクラスタへの DNS マッピング

DNS を更新するには、nsupdate コマンドを使用します。詳細は、nsupdate(1M) のマニュアルページを参照してください。テイクオーバーの管理の例については、「テイクオーバーの管理の例」を参照してください。

プライマリクラスタが修復されたら、オンラインに戻すことができます。元のプライマリクラスタにスイッチバックするには、次の手順を実行します。

プライマリクラスタとセカンダリクラスタを同期させ、プライマリボリュームが最新のものであることを確認します。これを行うには、複製データストリームがなくなるように、セカンダリノードのリソースグループを停止します。

データ複製の方向を逆にして、元のプライマリクラスタが元のセカンダリクラスタにふたたびデータを複製するようにします。

プライマリクラスタでリソースグループを起動します。

クライアントがプライマリクラスタのアプリケーションにアクセスできるように、DNS を更新します。

表 A-1 に、StorageTek Availability Suite ソフトウェアを使用して NFS アプリケーション向けにどのようにデータ複製を構成するかを示すこの例でのタスクを示します。

表 A-1 タスクマップ: データ複製の構成例

|

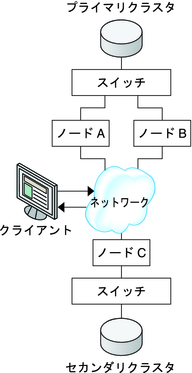

図 A-7 に、構成例で使用するクラスタ構成を示します。構成例のセカンダリクラスタにはノードが 1 つ含まれていますが、これ以外のクラスタ構成も使用できます。

図 A-7 クラスタ構成例

表 A-2 に、構成例で必要となるハードウェアとソフトウェアをまとめました。 Oracle Solaris OS、Oracle Solaris Cluster ソフトウェア、およびボリューム管理ソフトウェアは、StorageTek Availability Suite ソフトウェアとソフトウェア更新をインストールする前にクラスタノードにインストールしてください。

表 A-2 必要なハードウェアとソフトウェア

|

このセクションでは、NFS アプリケーション向けにディスクデバイスグループとリソースグループをどのように構成するかを説明します。追加情報については、「複製リソースグループの構成」および「アプリケーションリソースグループの構成」を参照してください。

ここでは、次の手順について説明します。

構成例のために作成されたグループとリソースの名前を次の表に示します。

表 A-3 構成例内のグループとリソースのサマリー

|

devgrp-stor-rg 以外のグループとリソースの名前は一例で、必要に応じて変更可能です。複製リソースグループは、devicegroupname-stor-rg というフォーマットでなければなりません。

Solaris ボリュームマネージャー ソフトウェアについては、『Oracle Solaris Cluster ソフトウェアのインストール』の第 4 章「Solaris ボリュームマネージャー ソフトウェアの構成」を参照してください。