7 Installation et démarrage d'ACSLS HA 8.4

Le package SUNWscacsls contient le logiciel de l'agent ACSLS qui communique avec Oracle Solaris Cluster. Il comprend des fichiers de configuration spéciaux ainsi que des patchs qui garantissent l'interaction correcte entre ACSLS et Solaris Cluster.

Procédure d'installation de base

-

Décompressez le fichier

SUNWscacsls.ziptéléchargé dans le répertoire /opt.# cd /opt # unzip SUNWscacsls.zip

-

Installez le package

SUNWscacsls.# pkgadd -d .

-

Répétez les étapes 1 et 2 sur le noeud adjacent.

-

Vérifiez qu'

acslspoolreste monté sur l'un des deux noeuds.# zpool status acslspool

Si

acslspooln'est pas monté, vérifiez sur l'autre noeud.Si

acslspooln'est pas monté sur l'autre noeud, importez-le vers le noeud actuel comme suit :# zpool import -f acslspool

Vérifiez avec

zpool status. -

Accédez au répertoire

/opt/ACSLSHA/utilsur le noeud qui possèdeacslspoolet exécutez le scriptcopyUtils.sh. Cette opération met à jour ou copie les fichiers essentiels vers les emplacements appropriés sur les deux noeuds. Il n'est pas nécessaire de répéter cette opération sur le noeud adjacent.# cd /opt/ACSLSHA/util # ./copyUtils.sh

-

Sur le noeud où

acslspoolest actif, en tant qu'utilisateuracsss, démarrez l'application ACSLS (acsssenable) et vérifiez qu'elle fonctionne. Résolvez tous les problèmes éventuels. Les problèmes majeurs peuvent être résolus en supprimant puis en réinstaller le package STKacsls sur le noeud.S'il est nécessaire de réinstaller le package STKacsls, exécutez le script

/opt/ACSLSHA/util/copyUtils.shaprès avoir installé le package. -

Arrêtez

acsls.# su - acsss $ acsss shutdown $ exit #

-

Exportez

acslspooldepuis le noeud actif.# zpool export acslspool

Remarque :

Cette opération échoue si l'utilisateuracsssest connecté, si un shell d'utilisateur est actif dansacslspoolou si un serviceacsssest toujours activé. -

Importez

acslspooldepuis le noeud adjacent.# zpool import acslspool

-

Démarrez l'application ACSLS sur ce noeud et vérifiez que les bibliothèques fonctionnent correctement. Résolvez tous les problèmes éventuels. Les problèmes majeurs peuvent être résolus en supprimant puis en réinstaller le package STKacsls sur le noeud.

S'il est nécessaire de réinstaller le package STKacsls, exécutez le script

/opt/ACSLSHA/util/copyUtils.shaprès avoir installé le package.

Configuration d'ACSLS HA

Cette étape permet de créer trois ressources ACSLS gérées et contrôlées par Solaris Cluster :

-

acsls-rsest l'application ACSLS elle-même. -

acsls-storageest le système de fichiers ZFS dans lequel réside ACSLS. -

<logical host>est l'IP virtuelle (l'identité réseau commune aux deux noeuds). Voir Configuration de /etc/hosts.

Après leur création, ces ressources sont assignées à un groupe de ressources commun appelé acsls-rg.

Pour configurer ces ressources, vérifiez d'abord que acslspool est monté (zpool list), puis accédez au répertoire /opt/ACSLSHA/util et exécutez acsAgt configure :

# cd /opt/ACSLSHA/util # ./acsAgt configure

Cet utilitaire invite à saisir le nom de l'hôte logique. Vérifiez que l'hôte logique est défini dans le fichier /etc/hosts, et que l'adresse IP correspondante est associée au groupe ipmp défini dans le Configuration du système Solaris pour ACSLS HA. Par ailleurs, avant d'exécuter acsAgt configure, utilisez zpool list pour confirmer que acslspool est monté sur le noeud de serveur actuel.

Cette étape de configuration peut prendre quelques minutes. Après la création des poignées de ressources, l'opération tente de démarrer l'application ACSLS.

Surveillance du fonctionnement du cluster d'ACSLS

Il existe plusieurs points de vue pour visualiser le fonctionnement du cluster d'ACSLS. Lorsque Solaris Cluster sonde l'application ACSLS une fois par minute, il est utile d'afficher les résultats des sondes dès qu'elles se produisent. Lorsqu'une sonde renvoie un état pour déclencher une commutation de noeud, il est utile de visualiser l'arrêt sur un noeud et le démarrage sur le noeud adjacent. Il est généralement utile de visualiser l'intégrité opérationnelle de l'application ACSLS au fil du temps.

Le principal point de vue opérationnel provient d'ACSLS. La fin du journal acsss_event.log peut fournir la meilleure indication quant à l'intégrité globale du système à chaque instant.

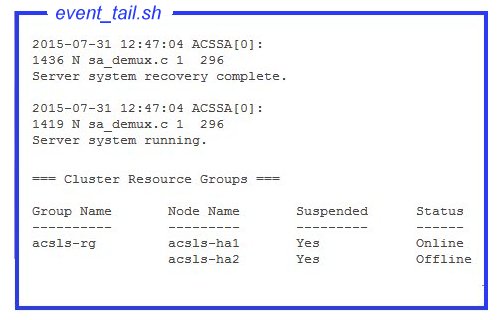

L'outil event_tail.sh dans le répertoire /opt/ACSLSHA/util/ fournit un accès direct au fichier acsss_event.log depuis chaque noeud. La vue fournie à partir de cet outil reste active, même lorsque le contrôle passe d'un noeud à l'autre. En plus de prendre en charge l'activité normale d'ACSLS, cet outil assure le suivi dynamique de chaque changement d'état du groupe de ressources du cluster d'ACSLS (acsls-rg) ce qui permet de visualiser en temps réel la mise hors ligne d'un noeud et la mise en ligne de l'autre. Activez cet outil depuis le shell de la manière suivante :

# /opt/ACSLSHA/util/event_tail.sh

Pour afficher l'activité de démarrage ou d'arrêt du point de vue d'un seul noeud, affichez le fichier start_stop_log à partir du noeud comme suit :

# tail -f /opt/ACSLSHA/log/start_stop_log

Pour afficher le résultat de chaque sonde périodique sur le noeud actif :

# tail -f /opt/ACSLSHA/log/probe_log

L'agent de Solaris Cluster et d'ACSLS Cluster envoie les détails des événements importants au journal du système Solaris (var/adm/messages). Pour afficher le journal système d'un noeud donné, un lien est fourni dans le répertoire /opt/ACSLSHA/log :

# tail -f /opt/ACSLSHA/log/messages

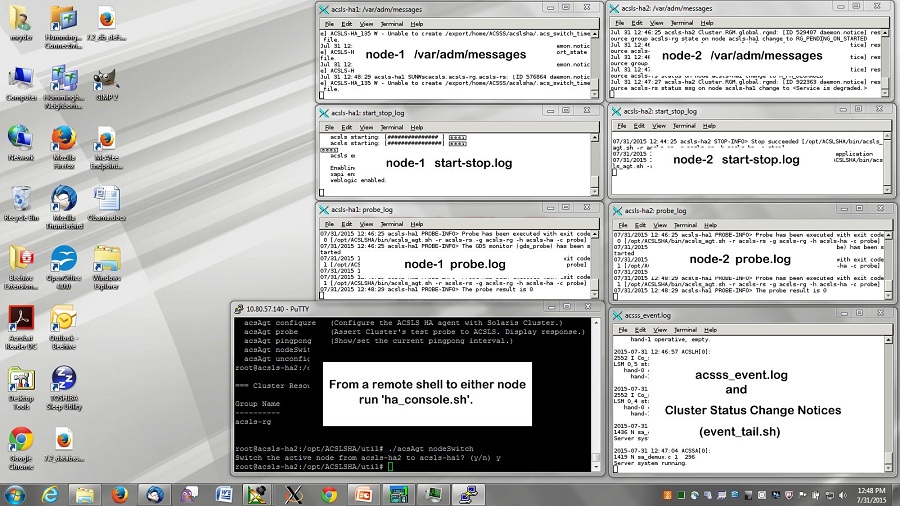

L'utilitaire ha_console.sh

Etant donné qu'une configuration en cluster comporte plusieurs points de vue et que le contrôle du cluster migre d'un noeud à l'autre au fil du temps, il peut s'avérer difficile de suivre l'activité opérationnelle du système à chaque instant à partir d'un seul point de vue. Grâce à l'utilitaire ha_console.sh utility il est plus facile de fournir une vue d'ensemble.

Connectez-vous à l'un des noeuds du système ACSLS HA à partir du bureau distant et exécutez

ha_console.shwho am i) pour déterminer où diriger DISPLAY. Connectez-vous directement au noeud HA à partir de la console locale ou du bureau pour voir l'affichage. Si des problèmes se produisent, recherchez des messages dans le fichier gnome-terminal.log du répertoire /opt/ACSLSHA/log.

# /opt/ACSLSHA/util/ha_console.sh

Cet utilitaire surveille tous les journaux mentionnés dans cette section à partir des deux noeuds. Il ouvre sept fenêtres de terminal gnome sur l'écran de la console locale. Il peut s'avérer utile pour organiser les fenêtres affichées à l'écran comme suit :

A partir d'un seul écran de terminal, vous obtenez une vue d'ensemble de l'intégralité du cluster ACSLS.

Comme le système distant envoie des données d'affichage à l'écran local, vous pouvez ouvrir un accès X-11 sur votre système local. Sur des systèmes UNIX, la commande à utiliser pour cela est xhost +. Sur un système Windows, il est nécessaire d'installer un logiciel client X-11 tel que xming ou exceed.

Si vous rencontrez des difficultés pour utiliser ha_console.sh, il est possible d'ouvrir plusieurs sessions de connexion à partir du système local vers chaque noeud pour afficher les différents journaux mentionnés dans cette section.

Vérification du fonctionnement du cluster

-

Une fois qu'

acslshaa démarré et est enregistré sur Solaris Cluster, utilisez les commandes du cluster pour vérifier l'état du groupe de ressources d'ACSLS et de ses ressources associées.# clrg status === Cluster Resource Groups === Group Name Node Name Suspended Status ---------- --------- --------- ------ acsls-rg node1 No Online node2 No Offline # clrs status === Cluster Resources === Resource Name Node Name State Status Message ------------- --------- ----- -------------- acsls-rs node1 Online Online node2 Offline Offline acsls-storage node1 Online Online node2 Offline Offline <logical host> node1 Online Online node2 Offline Offline -

Suspendez provisoirement la disponibilité du cluster au basculement afin de simplifier les tests initiaux.

# clrg suspend acsls-rg # clrg status

-

Testez la commutation du cluster du noeud actif vers le noeud en veille.

# cd /opt/ACSLSHA/util # ./acsAgt nodeSwitch

L'activité de basculement peut être surveillée à partir de plusieurs points de vue à l'aide des procédures décrites dans la section précédente.

-

Vérifiez la connectivité au réseau depuis un système client ACSLS à l'aide du nom d'hôte logique du serveur ACSLS.

# ping acsls_logical_host # ssh root@acsls_logical_host hostname passwd:

Cette opération doit renvoyer le nom d'hôte du noeud actif.

-

Vérifiez le fonctionnement d'ACSLS.

# su acsss $ acsss status

-

Répétez les étapes 3, 4 et 5 pour le noeud opposé.

-

Rétablissez la disponibilité au basculement du cluster.

# clrg resume acsls-rg # clrg status

-

Les séries de tests suivantes comprennent la vérification du comportement de basculement du noeud.

Pour effectuer plusieurs scénarios de basculement en séquence, diminuez l'intervalle pingpong par défaut de vingt à cinq minutes. (Voir le Affinage des réglages dans ACSLS HA pour plus d'informations.) A des fins de test, il est pratique de diminuer le paramètre par défaut.

Pour modifier l'intervalle pingpong, accédez au répertoire

/opt/ACSLSHA/utilet exécutezacsAgt pingpong.# ./acsAgt pingpong Pingpong_interval current value: 1200 seconds. desired value: [1200] 300 Pingpong_interval : 300 seconds

-

Réinitialisez le noeud actif et surveillez le fonctionnement depuis les deux consoles système et à partir des points de vue suggérés dans Surveillance du fonctionnement du cluster d'ACSLS. Vérifiez le basculement automatique vers le noeud en veille.

-

Vérifiez l'accès réseau à l'hôte logique depuis un système client, comme suggéré à l'étape 4.

-

Une fois que le fonctionnement d'ACSLS est actif sur le nouveau noeud, réinitialisez ce noeud et observez le basculement vers le noeud opposé.

Si vous surveillez le fonctionnement avec

ha_console.sh, les fenêtres associées au noeud de réinitialisation disparaissent. Lorsque le noeud est de nouveau actif, réexécutez la commandeha_console.shsur chaque noeud pour restaurer les fenêtres à partir du noeud nouvellement réinitialisé. -

Répétez la vérification du réseau comme suggéré à l'étape 4.

Le Fonctionnement du cluster d'ACSLS fournit un ensemble complet de scénarios de basculement. Vous pouvez tester autant de scénarios que vous le souhaitez avant de mettre le système ACSLS HA en production. Avant de replacer le système en production, restaurez l'intervalle pingpong recommandé pour éviter une répétition du basculement systématique.