Guide de démarrage avec OCI pour les ingénieurs DevOps

Oracle Cloud Infrastructure (OCI) fournit aux développeurs des outils pour créer, gérer et automatiser des applications en nuage natives. Ce guide présente un aperçu de ces outils et de leur application au cours du cycle de vie DevOps.

Le cycle de vie DevOps

DevOps est une méthode de travail qui encourage plusieurs équipes, principalement le développement et les opérations, à collaborer et à réaliser une livraison continue dans le cycle de vie du développement logiciel. Différents outils contribuent à différentes étapes du cycle de vie.

|

|

Du côté Développement, vous avez besoin d'outils pour vous aider dans les étapes suivantes :

|

Du côté Opérations, vous avez besoin d'outils pour vous aider dans les étapes suivantes :

|

De nombreux outils fournis par OCI pour l'utilisation de DevOps sont étroitement connectés et permettent de traiter plusieurs étapes du cycle de vie. Les sections de ce guide regroupent les étapes et les informations connexes en conséquence.

- Planifier et gérer votre infrastructure avec les outils de gestion de la configuration et d'infrastructure-code.

- Code pour une modification constante à l'aide des stratégies et des outils de conception d'application.

- Créer, tester, publier et déployer avec les outils d'intégration et de livraison en continu.

- Opérer en toute confiance à l'aide de la sécurité pour OCI.

- Surveiller avec les outils d'observabilité.

L'approche DevOps

L'automatisation est utilisée tout au long du cycle de vie DevOps. Elle réduit le besoin de tâches et d'interventions manuelles et augmente la fréquence des livraisons. La gestion de la configuration et l'infrastructure-code rendent possible une grande partie de cette automatisation.

La gestion de la configuration est le processus d'application des méthodes de programmation pour garantir la mise en oeuvre, les fonctions et la performance d'une application.

L'infrastructure en tant que code (IaC) utilise du code lisible par l'utilisateur pour définir, provisionner et gérer l'infrastructure. L'infrastructure-code est un composant clé du modèle de livraison continue.

Dans OCI, Ansible et Terraform sont les outils les plus utilisés pour la gestion de la configuration et l'infrastructure-code. Ansible est principalement un outil de gestion de la configuration utilisé pour la configuration, l'application de correctifs et le déploiement et la maintenance d'applications. Terraform est un outil d'infrastructure-code utilisé pour le provisionnement et la mise hors service de l'infrastructure. Ils sont fréquemment utilisés ensemble.

Gestion de la configuration

Le service OCI DevOps est conçu pour s'intégrer de façon transparente à deux outils de gestion de la configuration : Ansible et Chef.

Ansible

La collection Ansible pour OCI automatise le provisionnement et la configuration de l'infrastructure des ressources OCI, telles que les services de calcul, d'équilibrage de charge et de base de données.

Les modules Ansible pour OCI sont un jeu d'interpréteurs qui aident Ansible à effectuer des appels pour les points d'extrémité d'API OCI. Au niveau de base, Ansible amène un serveur ou une liste d'hôtes à un état connu en utilisant les concepts suivants :

- Inventaire : Explique où exécuter les commandes; statiques ou dynamiques

- Tâche : Appel à un module Ansible

- Jeux : Série de tâches ou de rôles Ansible mappés à un groupe d'hôtes dans l'inventaire; exécution dans l'ordre

- Livres de jeux : Série de jeux expliquant ce qu'il faut exécuter et utilisation de YAML

- Rôle : Structure standard permettant de spécifier des tâches et des variables. Permet la modularité et la réutilisation

Chef

Chef est un outil d'automatisation pour la gestion de la configuration qui se concentre sur la livraison et la gestion de piles informatiques complètes. Avec le service DevOps pour OCI, les utilisateurs peuvent gérer les ressources OCI à l'aide du plugiciel Chef Knife.

Puppet est un autre outil de gestion de la configuration commun utilisé pour concevoir, déployer, configurer et gérer des serveurs. Vous pouvez intégrer Puppet à OCI, mais il nécessite des scripts manuels car OCI n'a pas de plugiciel direct.

Infrastructure-code

OCI utilise Terraform pour l'infrastructure-code. Terraform comporte un langage déclaratif qui vous permet de coder l'infrastructure et un moteur qui utilise ces configurations pour gérer l'infrastructure.

Vous pouvez utiliser le fournisseur Terraform pour OCI et l'interface de ligne de commande Terraform pour rédiger et appliquer des configurations à partir de votre machine locale gérant l'infrastructure OCI, mais cette approche présente deux problèmes :

- Contrôle des versions manquant : Vous devez effectuer le suivi des différentes versions du code si vous avez besoin d'annuler des modifications ou de créer des branches.

- Collaboration : Vous devez centraliser les configurations et les plans pour vous assurer que tout le monde reste synchronisé.

Au lieu d'utiliser Terraform directement, utilisez le gestionnaire de ressources OCI, hôte Terraform en nuage pour le contrôle source centralisé, la gestion d'état et la file d'attente des tâches. Le gestionnaire de ressources facilite la gestion de l'infrastructure ou des piles par le personnel DevOps en masquant Terraform dans les modèles.

Le gestionnaire de ressources inclut également l'automatisation basée sur Terraform, comme la détection des ressources et des dérives. Comme il n'est pas toujours réaliste de rédiger d'abord les configurations Terraform, puis de provisionner l'infrastructure, vous pouvez créer des ressources dans la console, puis utiliser la détection des ressources du gestionnaire de ressources pour générer la pile et la configuration. Les rapports de détection de dérive permettent de déterminer si les ressources provisionnées ont des états différents de ceux définis dans la dernière configuration exécutée de la pile.

Les microservices vous permettent de concevoir une application en tant qu'ensemble de services faiblement couplés qui utilisent le modèle "share-nothing" (aucun partage des ressources) et s'exécutent en tant que processus sans état. Cette approche facilite l'évolution et la maintenance de l'application.

Dans une architecture de microservices, chaque microservice possède une tâche simple et communique avec les clients ou d'autres microservices à l'aide de mécanismes de communication légers tels que les demandes d'API REST. Les applications conçues en tant que microservices présentent les caractéristiques suivantes :

- Faciles à maintenir et à déployer de manière indépendante

- Facilement évolutifs et hautement disponibles

- Faiblement couplés à d'autres services

- Développés à l'aide du langage et du cadre de programmation qui conviennent le mieux au problème

La conteneurisation est une approche commune de l'architecture de microservice. Les conteneurs utilisent la virtualisation du système d'exploitation et ne contiennent que l'application et ses binaires connexes, ce qui permet un démarrage rapide et une sécurité accrue.

Conteneurisation et Docker

Docker est une plate-forme de projet et de conteneurisation à code source libre qui standardise l'empaquetage des applications et leurs dépendances en conteneurs, qui partagent le même système d'exploitation hôte. Utilisez des conteneurs Docker pour assurer une livraison rapide et cohérente de vos applications, un déploiement et un ajustement réactifs et une portabilité.

Une image Docker est un modèle en lecture seule avec des instructions permettant de créer un conteneur Docker. Une image Docker contient une application qui doit être exécutée par Docker en tant que conteneur, ainsi que les dépendances associées. Pour créer une image Docker, vous devez d'abord créer un fichier Dockerfile pour décrire cette application, puis créer l'image Docker à partir du fichier Dockerfile.

Les images Docker peuvent être stockées dans un registre tel que le registre de conteneurs pour OCI. Sans registre, il est difficile aux équipes de développement de tenir à jour un ensemble cohérent d'images Docker pour leurs applications conteneurisées. Sans un registre géré, il est difficile d'appliquer des droits d'accès et des politiques de sécurité aux images.

Pour un tutoriel de présentation, voir Transmission d'une image vers Oracle Cloud Infrastructure Registry.

Kubernetes

Le déploiement d'applications conteneurisées crée un nouveau problème : la gestion de milliers de conteneurs. Kubernetes est un outil à code source libre qui orchestre automatiquement le cycle de vie des conteneurs, en les répartissant sur l'ensemble de l'infrastructure d'hébergement. Kubernetes redimensionne les ressources en fonction de la demande. Il approvisionne, programme, supprime et surveille en permanence l'état des conteneurs.

La rubrique À quoi sert Kubernetes? couvre certains concepts et historiques clés relatifs à Kubernetes.

Moteur Kubernetes OCI

Le moteur Kubernetes pour OCI (OKE) (parfois appelé OKE) est un service entièrement géré, évolutif et hautement disponible que vous pouvez utiliser pour déployer vos applications conteneurisées dans le nuage.

Bien que vous n'ayez pas besoin d'utiliser un service Kubernetes géré, le moteur Kubernetes d'OCI est un moyen facile d'exécuter des grappes hautement disponibles avec le contrôle, la sécurité et la performance prévisible d'OCI qui donne aux équipes DevOps une visibilité et un contrôle supérieurs.

-

Accédez à vos grappes à l'aide de

kubectl, qui est inclus dans Cloud Shell, ou utilisez une installation locale dekubectl. - Augmentez la disponibilité des applications à l'aide de grappes couvrant plusieurs domaines de disponibilité (centres de données) dans n'importe quelle région commerciale en tirant parti de l'ajustement automatique des groupes de noeuds et des pods Kubernetes.

- Mettez facilement et rapidement à niveau les grappes de conteneurs, sans aucun temps d'arrêt, pour les tenir à jour avec la dernière version stable de Kubernetes.

- Observation des grappes Kubernetes à l'aide de mesures, de journaux et de demandes de travail.

Fonctions

Les fonctions hébergent des applications tout en les écartant des serveurs réels. Grâce à l'architecture sans serveur extensible du service de fonctions, vous n'avez aucune tâche d'administration à effectuer, au niveau de l'infrastructure ou des logiciels. Vous n'avez pas à vous soucier du provisionnement ou de la mise à jour des instances de calcul. Les correctifs et les mises à niveau de logiciel du système d'exploitation sont appliqués automatiquement. Les fonctions garantissent que votre application est hautement disponible, évolutive, sécurisée et surveillée. Vous pouvez écrire du code en Java, Python, Node, Go, Ruby et C# (et pour les cas d'utilisation avancés, utiliser votre propre fichier Dockerfile et votre propre machine virtuelle Graal). Vous pouvez ensuite déployer votre code, l'appeler directement ou le déclencher en réponse à des événements.

L'intégration continue et la livraison ou le déploiement continu (CI/CD) constituent les meilleures pratiques DevOps.

L'intégration continue est la pratique permettant aux développeurs d'intégrer l'ensemble de leur travail le plus tôt possible dans le cycle de vie. Des modifications de code incrémentielles et fréquentes sont créées, testées et révisées selon les besoins, en fonction de commentaires constants. Une modification du code doit déclencher automatiquement des étapes standardisées de compilation et de test qui garantissent que les modifications de code fusionnées dans le référentiel sont exemptes d'erreurs et qu'elles fonctionnent avec le code existant.

La livraison ou le déploiement en continu est la pratique consistant à transmettre rapidement les modifications de code des développeurs aux utilisateurs. Une fois que le code a passé avec succès les tests unitaires, d'intégration, d'acceptation et autres, il est mis en production dans le cadre d'un déploiement continu automatisé ou d'un processus manuel de livraison continue.

DevOps pour OCI

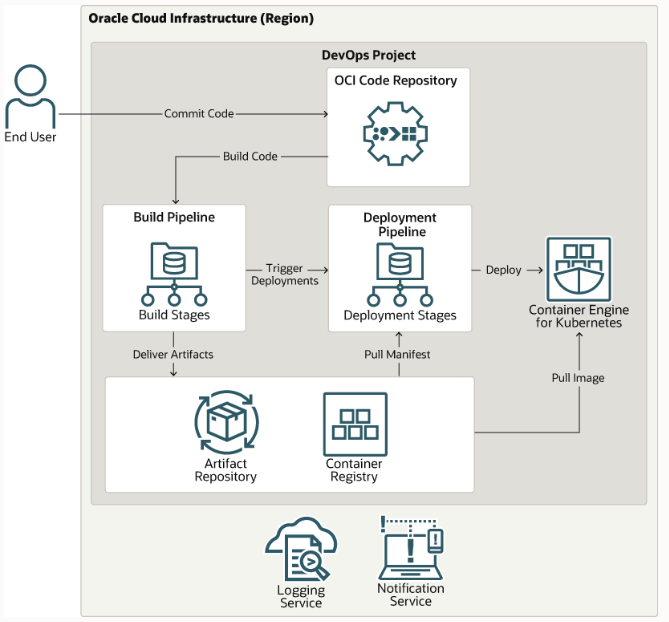

Les pipelines de compilation et de déploiement sont le coeur du flux de travail d'intégration et de livraison en continu DevOps.

Le service OCI DevOps vous permet de créer et de déployer visuellement des pipelines qui automatisent les appels à des outils plus ciblés. DevOps offre la flexibilité nécessaire pour l'intégration à vos flux de travail d'intégration et de livraison en continu existants.

Pour explorer l'intégration et la livraison en continu dans OCI, vous pouvez créer un pipeline de conteneur à l'aide de DevOps ou développer, déboguer et déployer des applications sur Kubernetes Engine.

DevOps Projets

La première étape de la création et du déploiement d'applications à l'aide du service DevOps pour OCI consiste à créer un projet DevOps. Un projet DevOps est un regroupement logique des ressources DevOps nécessaires pour mettre en oeuvre un flux de travail d'intégration et de livraison en continu. Dans le cadre de la création du projet dans la console, ou à l'aide d'une API ou d'une interface de ligne de commande, vous créez les ressources suivantes :

|

Les projets DevOps permettent de gérer les ressources du cycle de vie de vos logiciels en un seul endroit et de les partager facilement. Lorsque vous utilisez conjointement DevOps pour OCI et les référentiels d'artefact, vous pouvez être sûr que la version du logiciel prévue pour la publication est celle qui est déployée, et que vous pouvez revenir à une version antérieure connue.

Code

Dans le service DevOps, vous pouvez créer vos propres référentiels de code privés dans un référentiel de code OCI, comme Git. Les validations, les mises à jour, les branches et l'utilisation du stockage sont visibles dans la console et un identificateur Oracle Cloud (OCID) est affecté au référentiel lorsque vous le créez. Vous pouvez également modifier, cloner et supprimer des référentiels.

En outre, vous pouvez utiliser des référentiels de code externes tels que GitHub et GitLab, ou mettre en miroir un référentiel de code externe de GitHub, GitLab ou Bitbucket Cloud vers un référentiel de code OCI. Si vous utilisez des référentiels auto-hébergés (serveur GitLab et serveur Bitbucket) avec des adresses IP privées, vous pouvez toujours y accéder à partir de vos pipelines.

Pour plus d'informations, voir Gestion des référentiels de code et Ajout d'une étape de compilation gérée.

Artefacts

Un artefact est une référence à tout fichier binaire, ensemble, manifeste Kubernetes, image de conteneur ou autre fichier qui compose votre application et qui sera transmis à un environnement de déploiement cible. Les artefacts générés par votre compilation et utilisés dans votre déploiement sont stockés dans des registres. OCI comporte deux types de registre pour le stockage, le partage et la gestion des artefacts :

- Le registre de conteneurs est un service géré basé sur des normes ouvertes qui stocke plusieurs versions de Docker ou d'autres images de conteneur, plus les fichiers connexes tels que les manifestes et les graphiques Helm. Ces images peuvent être poussées vers une grappe Kubernetes pour un déploiement à l'aide de Kubernetes Engine (OKE).

- Le service de registre d'objets stocke les ensembles de logiciels, les bibliothèques, les fichiers .zip et d'autres types de fichiers utilisés pour déployer des applications. Ces fichiers peuvent être appelés lorsque le pipeline de déploiement est déclenché.

Vous pouvez également utiliser des registres d'objets externes tels que Sonatype ou Artifactory et les mettre en miroir dans le registre d'objets d'OCI. Cela signifie que vous pouvez continuer à utiliser votre configuration courante avec DevOps pour OCI.

Pipelines de compilation et de déploiement

Les pipelines de compilation et de déploiement OCI DevOps réduisent les erreurs liées aux changements et le temps que vous consacrez à la compilation et au déploiement des versions. Les développeurs valident le code source dans un référentiel de code, créent et testent les artefacts logiciels avec un exécuteur de compilation, transmettent ces derniers aux référentiels OCI, puis exécutent un déploiement sur les plates-formes OCI.

Vous pouvez utiliser DevOps pour mettre en oeuvre diverses stratégies de pipeline de déploiement, notamment une stratégie bleu-vert (qui se compose de deux environnements de production identiques), une stratégie de test canari et une stratégie continue.

Pour des instructions détaillées sur le pipeline, voir Gestion des pipelines de compilation et Gestion des pipelines de déploiement.

Les journaux des exécutions de compilation et des déploiements sont stockés dans le service Journalisation pour OCI aux fins de vérification et de gouvernance. Votre équipe peut également recevoir des avis provenant des événements de vos pipelines DevOps au moyen du service Avis pour OCI.

Vous pouvez également utiliser le plugiciel Jenkins Compute pour centraliser l'automatisation et les déploiements à grande échelle, transmettre vos artefacts au registre d'artefacts pour OCI et déclencher les pipelines de déploiement DevOps.

Un environnement est un ensemble de ressources de calcul sur lesquelles des artefacts sont déployés et il s'agit de la plate-forme cible de votre application. Les types d'environnement d'exécution cible pris en charge par OCI incluent des instances de calcul de machine virtuelle ou sans système d'exploitation dans Oracle Linux et CentOS, Kubernetes Engine et les fonctions. L'environnement choisi pour le déploiement dépend de vos besoins en matière de flexibilité, de sécurité, de vitesse et d'autres exigences :

- Les hôtes sans système d'exploitation offrent un contrôle et une sécurité supérieurs. Une bonne option pour les projets nécessitant un espace plus constant, plus grand ou plus séparé et sécurisé. Voir Aperçu du service de calcul.

- Les machines virtuelles offrent plus de polyvalence, d'évolutivité et de partage des ressources. Les applications partagées et le matériel physique permettent des économies de coûts, accélèrent la récupération après sinistre et le provisionnement. Voir Aperçu du service de calcul.

- Kubernetes Engine est idéal pour les environnements à haute densité et pour les déploiements de petites et moyennes entreprises où vous devez en faire plus avec moins de ressources. Voir Conception d'application.

- Les fonctions sont adaptées aux charges de travail dynamiques où l'utilisation change fréquemment, car vous payez pour les services uniquement lorsque vous les utilisez.

Vous devez créer votre grappe de moteur Kubernetes, votre fonction ou votre instance de calcul avant de créer un environnement DevOps. Vous créez des références à différents environnements de destination pour le déploiement DevOps.

DevSecOps est une approche de la culture, de l'automatisation et de la conception de plates-formes qui intègre la sécurité en tant que responsabilité partagée tout au long du cycle de vie DevOps.

La sécurité continue comporte trois éléments principaux :

- Lors de l'ajout de nouvelles fonctions, la sécurité doit être continuellement affinée et mise à jour. Des contrôles de sécurité nouveaux ou modifiés peuvent être ajoutés (ou certains peuvent être supprimés). Ces contrôles doivent être testés en permanence pendant les cycles de développement et de déploiement à l'aide de suites de tests de sécurité automatisées.

- Les applications en nuage natives doivent être créées à des fins de résilience. Parce que même un logiciel soigneusement conçu et testé peut contenir des failles de sécurité, un système robuste de surveillance de la sécurité doit identifier les intrusions et les infections en temps réel. Les réponses automatisées aux incidents doivent protéger les services.

- Au fur et à mesure que de nouvelles fonctions sont disponibles en production au moyen du pipeline d'intégration et de livraison en continu, les vérificateurs de conformité de la sécurité et les systèmes d'évaluation de la vulnérabilité d'application doivent mesurer et enregistrer tout nouveau risque. Les risques identifiés lors de la nouvelle intégration de fonctions nécessitent la révision du cadre des contrôles de sécurité, qui doit être modifié pour atténuer ces risques.

Service IAM

Chambre forte

À titre de meilleure pratique, les ingénieurs DevOps utilisent le service de chambre forte pour OCI pour aider à améliorer la sécurité globale de leurs déploiements d'application et de service.

Vous pouvez utiliser le service de chambre forte pour gérer de manière centralisée les clés de chiffrement et les clés secrètes. Les clés secrètes sont des données d'identification telles que des mots de passe, des jetons ou toute autre donnée confidentielle que vous devez utiliser avec d'autres services pour OCI et des applications ou systèmes externes. Le stockage des clés secrètes dans une chambre forte offre une sécurité supérieure à celle fournie par d'autres emplacements, tels que du code ou des fichiers de configuration.

Le service de chambre forte s'intègre directement aux services pour OCI, aux trousses SDK et aux clients d'API, et gère le chiffrement des données d'identification de mot de passe utilisées avec toute application externe.

Meilleures pratiques de sécurité pour Kubernetes Engine

Lors de l'utilisation du moteur Kubernetes pour OCI, suivez ces meilleures pratiques de sécurité :

- Contrôlez l'accès à vos grappes provisionnées à l'aide des politiques IAM et des règles de contrôle d'accès basé sur les rôles (RBAC) de Kubernetes. Voir À propos du contrôle d'accès et du moteur Kubernetes (OKE).

- Chiffrer les objets de données sensibles (tels que les jetons d'authentification et les données d'identification) en tant que clés secrètes Kubernetes lorsqu'ils sont stockés dans etcd.

- Utiliser les politiques de sécurité des pods pour limiter ou restreindre l'accès aux ressources. Voir Utilisation de politiques de sécurité de pod avec Kubernetes Engine (OKE).

- Utiliser la sécurité des groupes de noeuds pour les grappes et les pods.

- Définir les règles d'accès réseau pour les communications vers et depuis les pods.

- Définir des modèles d'utilisation multilocataire pour les grappes Kubernetes (isolement).

- Améliorer la sécurité de l'image de conteneur à l'aide de la vérification des signatures et du balayage de vulnérabilités. Voir Signature d'images à des fins de sécurité et Balayage d'images pour détecter les vulnérabilités.

Lors de l'utilisation du service Fonctions pour OCI, respectez les meilleures pratiques de sécurité suivantes :

- Contrôlez les accès d'appel et de gestion aux fonctions et aux applications à l'aide du service IAM .

- Améliorer la sécurité de l'image de conteneur à l'aide de la vérification des signatures et du balayage de vulnérabilités. Voir Signature d'images à des fins de sécurité et Balayage d'images pour détecter les vulnérabilités.

- Respecter les conseils relatifs au contrôle de l'accès.

Les outils DevOps doivent vous aider à comprendre parfaitement le fonctionnement de votre système et à choisir les bonnes mesures à surveiller de manière proactive. Vous devez détecter les problèmes dès le début du processus et être en mesure de surveiller l'état en permanence.

Les outils DevOps doivent également vous aider à maintenir la sécurité de bout en bout des systèmes d'information, qu'il s'agisse du centre de données physique, des réseaux ou des applications.

Avec une approche adéquate en matière d'observabilité, vous pouvez réduire les temps d'arrêt, accélérer le délai moyen de détection et réduire le délai moyen de résolution et améliorer la satisfaction des clients et la prestation de services.

Services d'observabilité pour OCI

Le service Surveillance peut vous aider à obtenir des données clés sur les charges de travail OCI à l'aide des DevOps mesures pour l'état et la performance. Vous pouvez configurer des alarmes avec des seuils pour détecter les anomalies d'infrastructure et d'application et y répondre.

Bien que les mesures OCI soient visibles dans les graphiques au moyen de la console, vous pouvez utiliser le plugiciel Grafana pour voir les mesures des ressources de tous les fournisseurs dans un seul tableau de bord Grafana.

Le service Service de journalisation peut ingérer des données de journal provenant de centaines de sources. Vous pouvez générer des journaux tels que des journaux de vérification et des journaux de flux de réseau et les utiliser pour diagnostiquer des problèmes de sécurité. Les journaux DevOps regroupent tous les journaux des ressources de projet DevOps.

Log Analytics est une solution en nuage basée sur l'apprentissage automatique qui surveille, agrée, indexe et analyse toutes les données de journal des environnements sur place et multinuages. Il vous permet d'effectuer des recherches, d'explorer et de mettre en corrélation ces données pour résoudre les problèmes plus rapidement, acquérir une visibilité opérationnelle et améliorer la prise de décisions.

Le service d'avis est un service de publication et d'abonnement hautement disponible et à faible latence qui envoie des alertes et des messages aux partenaires de services, de courriel et de transmission de messages, y compris Slack et PagerDuty.

Events effectue le suivi des modifications de ressource à l'aide d'événements conformes à la norme Cloud Native Computing Foundation (CNCF) CloudEvents. Il élimine la complexité du suivi manuel des modifications apportées aux ressources en nuage. Les événements DevOps sont des fichiers JSON, générés avec certaines opérations de service, qui contiennent des informations sur ces opérations. Vous pouvez définir des règles qui déclenchent une action particulière lorsqu'un événement se produit.

Services et outils DevOps

- La gestion des dépendances d'application détecte les vulnérabilités de sécurité dans les dépendances d'application.

- Le service Surveillance de la performance des applications fournit un jeu complet de fonctions pour surveiller les applications et diagnostiquer les problèmes de performance.

- Le registre d'artefacts fournit des référentiels pour le stockage, le partage et la gestion des ensembles de développement logiciel.

- Le moteur Kubernetes vous aide à définir et à créer des grappes Kubernetes pour permettre le déploiement, l'ajustement et la gestion des applications conteneurisées.

- Le service Registre de conteneurs permet de stocker, de partager et de gérer des images de conteneurs (telles que des images Docker) dans un registre géré par Oracle.

- Le service Tableaux de bord de la console vous permet de créer des tableaux de bord personnalisés dans la console pour surveiller les ressources, les diagnostics et les mesures clés de votre location.

- DevOps est un service qui automatise la livraison et le déploiement de logiciels.

- Le service Événements vous aide à créer une automatisation en fonction des modifications d'état des ressources de votre location.

- Le service des fonctions est une plate-forme sans serveur qui vous permet de créer, d'exécuter et d'adapter une logique métier sans gérer d'infrastructure.

- Le service GIA utilise des domaines d'identité pour fournir des fonctions de gestion des identités et des accès, telles que l'authentification, l'authentification unique (SSO) et la gestion du cycle de vie des identités.

- Le service de journalisation fournit une interface unique hautement évolutive et entièrement gérée pour tous les journaux d'une location.

- Log Analytics vous permet d'indexer, d'enrichir, d'agréger, d'explorer, de rechercher, d'analyser, de corréler, de visualiser et de surveiller toutes les données de journaux de vos applications et de votre infrastructure de système.

- Le service Surveillance vous permet d'interroger les mesures et de gérer les alarmes. Les mesures et les alarmes permettent de surveiller l'état, la capacité et les performances de vos ressources en nuage.

- Le service Avis diffuse des messages vers des composants répartis au moyen d'un modèle de publication-abonnement, afin d'assurer une livraison durable, sécurisée, très fiable et à faible latence des messages.

- Le gestionnaire des ressources automatise le déploiement et les opérations pour toutes les ressources OCI à l'aide du modèle Infrastructure-code.

- Le service de diffusion en continu fournit une solution entièrement gérée, évolutive et durable pour l'ingestion et l'utilisation de flux de données à volume élevé en temps réel.

- Le service de chambre forte est un service de gestion du chiffrement qui stocke et gère les clés de chiffrement et les clés secrètes permettant d'accéder en toute sécurité aux ressources.

- Le service Balayage de vulnérabilités améliore votre sécurité en vérifiant régulièrement si les hôtes et les images de conteneur présentent des vulnérabilités potentielles.

Ressources supplémentaires

| Explorer | Communauté | Formation et certification |

|---|---|---|

| Page de produit du service DevOps Oracle Learning : DevOps pour OCI |

Blogue pour les développeurs Oracle |