Préparer l'environnement réseau du centre de données

L'architecture réseau d'Oracle Private Cloud Appliance repose sur une connectivité Ethernet haute vitesse physique. Préparez la configuration réseau du centre de données afin qu'elle réponde aux exigences d'intégration de l'appareil.

L'infrastructure réseau de Private Cloud Appliance fait partie intégrante du système et ne doit pas être modifiée. Le réseau ne s'intègre à aucune structure de gestion ou de provisionnement de centre de données telle que Cisco ACI, Network Director ou autre.

Cependant, Private Cloud Appliance peut communiquer avec la structure Cisco ACI de votre centre de données à l'aide de la fonctionnalité L3Out (routes statiques ou eBGP) fournie par Cisco ACI. Pour plus d'informations sur cette fonction Cisco, reportez-vous au Guide Cisco ACI Fabric L3Out.

Aucune modification des commutateurs réseau dans Private Cloud Appliance n'est prise en charge, sauf si le support technique Oracle vous le demande ou via un article de la base de connaissances sur le site Web My Oracle Support.

Pour obtenir des informations conceptuelles importantes sur la mise en réseau des appliances, reportez-vous à Infrastructure réseau de l'appliance de cloud privé. Il décrit les différents réseaux et leurs rôles, les liaisons montantes qui se connectent au réseau du centre de données et les ressources réseau réservées au fonctionnement de l'appareil.

Configuration requise pour les liaisons montantes de l'appareil

Lors de la préparation de l'installation de Private Cloud Appliance, sélectionnez une configuration de liaison montante et configurez le réseau du centre de données pour accepter cette configuration.

Sur chaque commutateur Spine, les ports 1 à 4 peuvent être utilisés pour les liaisons montantes vers le réseau du centre de données. Pour les vitesses de 10Gbps ou 25Gbps, le port du commutateur Spine doit être divisé à l'aide d'un séparateur 4 voies ou d'un câble de séparation. Pour des vitesses plus élevées de 40Gbps ou 100Gbps, chaque port de commutateur utilise une seule connexion par câble direct.

Les liaisons montantes sont configurées pendant l'initialisation du système, en fonction des informations que vous fournissez dans le cadre de la liste de contrôle de l'installation initiale du système. Les ports de liaison montante de commutateur Spine inutilisés, y compris les ports de coupure inutilisés, sont désactivés pour des raisons de sécurité.

Il est essentiel que les deux commutateurs Spine aient les mêmes connexions aux commutateurs de centre de données de niveau supérieur. Cette configuration assure la redondance et la répartition de la charge au niveau des commutateurs Spine, des ports et des commutateurs de centre de données. Ce câblage sortant dépend de la topologie réseau que vous déployez. Le modèle de câblage joue un rôle clé dans la poursuite du service lors des scénarios de basculement.

Pour plus d'informations sur le choix de la configuration appropriée et sur les topologies disponibles (Mesh, Square, Triangle), reportez-vous à Liaisons montantes. Des conseils de configuration et des exemples de référence sont également fournis.

-

Avant l'installation, vous devez exécuter des câbles réseau de votre infrastructure réseau existante vers le site d'installation de Private Cloud Appliance. Pour obtenir des instructions, reportez-vous à Connexion de Private Cloud Appliance au réseau de centre de données.

-

Prévoyez de connecter au moins 1 port Ethernet haut débit sur chaque commutateur spine au réseau Ethernet public de votre centre de données.

-

La configuration du réseau d'administration en option nécessite 2 connexions de câbles supplémentaires (une à partir du port 5 sur les deux commutateurs Spine) à une paire de commutateurs de centre de données de niveau supérieur.

-

La connectivité des liaisons montantes est basée sur la couche 3 du modèle OSI.

-

Lors de la mise à niveau à partir de la version logicielle de l'appareil 3.0.2-b892153 ou antérieure et de l'exécution de vPC/HSRP, si vous souhaitez modifier la configuration réseau pour prendre en charge les nouvelles fonctionnalités, contactez Oracle pour obtenir de l'aide.

Configuration DNS de centre de données pour l'appliance de cloud privé

Pour intégrer les données de la zone DNS dédiée de l'appliance de cloud privé dans la configuration DNS du centre de données, deux options sont prises en charge : délégation de zone ou configuration manuelle.

L'approche privilégiée consiste à configurer la délégation de zone. Toutefois, si vous sélectionnez une configuration manuelle, il est recommandé d'enregistrer les noms d'hôte et les adresses IP du réseau de gestion, du réseau client et des réseaux publics supplémentaires dans le DNS (Domain Name System) du centre de données avant la configuration initiale. En particulier, toutes les adresses publiques, les adresses IP virtuelles et les adresses de services d'infrastructure doivent être enregistrées dans le DNS avant l'installation.

Toutes les adresses inscrites dans le DNS doivent être configurées pour la résolution aval. La résolution inverse n'est pas prise en charge dans la zone de services de l'appliance de cloud privé.

Délégation de zone (préférée)

Pour que la délégation de zone fonctionne, il est nécessaire que les caches récursifs du centre de données puissent atteindre le port TCP/UDP 53 sur l'adresse IP virtuelle partagée par les noeuds de gestion de l'appareil. Il peut être nécessaire de modifier la configuration de votre pare-feu.

Configurez le serveur DNS du centre de données pour qu'il fonctionne comme la zone parent de la zone DNS de l'appareil. Ainsi, toutes les demandes DNS pour la zone enfant sont déléguées au serveur DNS interne de l'appareil. Dans la configuration DNS du centre de données, ajoutez un enregistrement de serveur de noms pour la zone enfant et un enregistrement d'adresse pour le serveur faisant autorité de cette zone.

Dans cet exemple, il est supposé que le domaine DNS du centre de données est example.com, que l'appareil est nommé mypca et que l'adresse IP virtuelle du cluster de noeuds de gestion est 192.0.2.102. Le nom d'hôte du serveur DNS interne de l'appareil est ns1.

$ORIGIN example.com.

[...]

mypca IN NS ns1.mypca.example.com.

ns1.mypca IN A 192.0.2.102La recherche DNS pour les adresses de services a été modifiée dans la version logicielle du contrôleur 3.0.2-b1483396. Les enregistrements d'adresse individuels par service ont été consolidés dans des enregistrements CNAME faisant référence à un enregistrement services ou adminservices commun. Avec la délégation de zone du sous-domaine de l'appareil, les recherches pour un RTYPE défini renvoient l'enregistrement CNAME et le RTYPE. Les codes express pour les RTYPE non définis qui n'avaient précédemment renvoyé aucune réponse, renvoient désormais un enregistrement CNAME uniquement.

Configuration manuelle

Ajoutez manuellement des enregistrements DNS pour toutes les étiquettes ou tous les noms d'hôte requis par l'appareil.

Dans les exemples, il est supposé que le domaine DNS du centre de données est example.com, que l'appareil est nommé mypca et que l'adresse IP virtuelle du cluster de noeuds de gestion est 192.0.2.102 dans le réseau de données et 203.0.113.12 dans le réseau d'administration (facultatif).

Pour le stockage d'objets, vous devez pointer le libellé DNS vers l'adresse IP publique Object Storage. Il s'agit de l'adresse IP publique que vous affectez spécifiquement à cette fin lors de la configuration des plages d'adresses IP publiques du centre de données lors de la configuration initiale.

|

Service d'infrastructure d'appliance et libellé DNS |

Enregistrement DNS de centre de données |

Enregistrement DNS de centre de données avec réseau d'administration activé |

|---|---|---|

|

Service Admin

|

|

|

|

Networking, calcul, stockage de blocs, services de demandes de travail

|

|

|

|

Service Identity and Access Management

|

|

|

|

DNS Service

|

|

|

|

Object Storage

Utilisez l'adresse IP publique Object Storage à partir de la configuration initiale de l'appliance. |

|

|

|

File Storage

|

|

|

|

Gestionnaire d'alertes

|

|

|

|

API

|

|

|

|

Service OKE

|

|

|

|

Service principal de ressource

|

|

|

|

Grafana

|

|

|

|

Prometheus

|

|

|

|

Prométhée-gw

|

|

|

|

Interface utilisateur Web de service

|

|

|

|

Interface utilisateur Web Compute

|

|

|

Directives relatives à la configuration réseau des centres de données

Suivez ces directives importantes pour une intégration fluide de Private Cloud Appliance au réseau du centre de données.

Notes de changement de centre de données

-

Toutes les liaisons montantes, par défaut et client, sont configurées pour utiliser le groupement de liaisons (LACP). Tous les ports de commutateur inclus dans une configuration de liaison montante doivent appartenir au même groupe de groupement de liaisons (LAG). Les ports de commutateur situés du côté centre de données des liaisons montantes doivent être configurés en conséquence.

-

Les commutateurs Spine fonctionnent avec la fonctionnalité de canal de port virtuel (vPC) activée dans les configurations de routage statique.

-

Private Cloud Appliance prend en charge la connectivité de liaison montante basée sur la couche 3 au centre de données client. Le routage statique et le routage dynamique basé sur BGP4 sont pris en charge dans la couche 3.

-

La négociation automatique n'est pas disponible pour les ports de liaison montante. La vitesse de transfert doit être spécifiée à l'extrémité des commutateurs client.

Pour plus d'informations, reportez-vous aux sections Uplinks et Uplink Protocols.

Instructions relatives au réseau d'administration

Si vous choisissez de séparer l'accès de l'appliance d'administration du trafic de données, assurez-vous que le réseau du centre de données est configuré en conséquence, afin que tout le trafic puisse être acheminé vers les destinations appropriées à la fois dans l'administration et dans le réseau de données.

- Accès aux adresses de service

-

Lorsque le réseau d'administration est activé, certains services d'infrastructure d'appliance sont accessibles via l'adresse IP virtuelle de gestion d'administration, et non via l'adresse IP virtuelle de noeud de gestion standard. Ces adresses de service sont les suivantes :

-

'admin'

-

'adminconsole'

-

'prometheus-gw'

-

'prometheus'

-

"grafana"

-

'api'

-

"gestionnaire d'alertes"

-

'rps'

Les adresses de service suivantes sont toujours accessibles via l'adresse IP virtuelle de noeud de gestion dans le réseau de données :

-

'console'

-

'iaas'

-

'identité'

-

'stockage'

-

'objectstorage'

-

'dns'

-

"containerengine"

Assurez-vous que le pare-feu du centre de données est configuré pour autoriser ce trafic. Si vous gérez les enregistrements DNS requis par l'appareil dans la configuration DNS du centre de données, assurez-vous qu'ils pointent vers le réseau et l'adresse corrects, comme indiqué dans Configuration DNS du centre de données pour l'appliance de cloud privé (Configuration manuelle).

-

- Gestion de cluster OKE

-

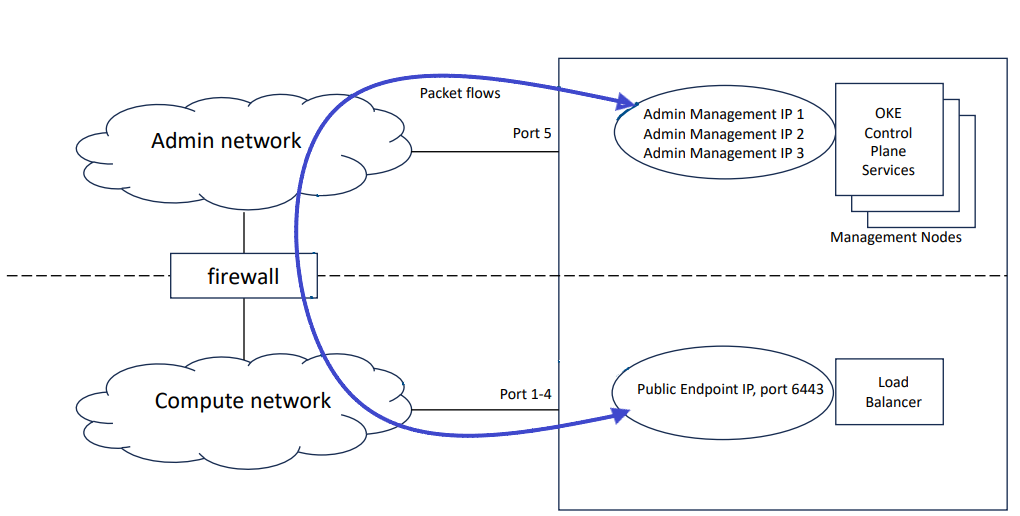

Lorsque Kubernetes Engine est utilisé sur un système configuré avec un réseau d'administration distinct, le pare-feu du centre de données doit être configuré pour autoriser le trafic entre le plan de contrôle OKE et les clusters OKE déployés par les utilisateurs Compute Enclave.

Le plan de contrôle OKE s'exécute sur les noeuds de gestion du réseau d'administration, tandis que les clusters OKE sont déployés sur le réseau de données. L'interface de gestion d'un cluster OKE est le port 6443 sur son adresse IP publique d'équilibreur de charge. Cette adresse est affectée à partir de la plage d'adresses IP du centre de données que vous avez réservée et configurée en tant qu'adresses IP publiques lors de la configuration initiale de l'appareil.

En raison de la ségrégation du réseau, le trafic provenant du plan de contrôle OKE doit quitter l'appareil via le réseau d'administration, puis passer à nouveau par le réseau de données pour atteindre le cluster OKE. L'infrastructure réseau du centre de données doit autoriser le trafic dans les deux sens. Sans le pare-feu et les règles de routage nécessaires, les utilisateurs ne peuvent pas déployer de clusters OKE.

Adresses IP système par défaut

L'adresse IP de gestion représente la connexion d'un composant au réseau d'administration interne.

Pour la gestion du matériel, Private Cloud Appliance utilise un réseau interne au système. Il n'est pas recommandé de connecter les ports de gestion ou les commutateurs réseau d'administration interne à l'infrastructure réseau du centre de données.

Le tableau de cette section répertorie les adresses IP de gestion par défaut affectées aux serveurs et aux autres composants matériels dans une configuration de base de Private Cloud Appliance.

|

Unité de rack |

Composant de rack |

Adresse IP de gestion affectée pendant la fabrication |

|---|---|---|

|

32 |

Commutateur Spine |

|

|

31 |

Commutateur Spine |

|

|

26 |

Commutateur de gestion |

|

|

25 |

Bascule Feuille/Données |

|

|

24 |

Bascule Feuille/Données |

|

|

Adresse IP virtuelle du noeud de gestion |

ILOM : |

|

|

7 |

Noeud de gestion |

ILOM : |

|

6 |

Noeud de gestion |

ILOM : |

|

5 |

Noeud de gestion |

ILOM : |

|

VIP de stockage |

Pool de performances Pool de capacité |

|

|

3-4 |

Serveur de contrôleur Oracle ZFS Storage Appliance (2 unités de rack) |

ILOM : |

|

1-2 |

Serveur de contrôleur Oracle ZFS Storage Appliance (2 unités de rack) |

ILOM : |

Une adresse IP est affectée aux noeuds de calcul dans le réseau d'administration interne pendant le processus de provisionnement. L'adresse IP du système est basée sur DHCP ; l'adresse IP du système est affectée à ILOM, où le troisième octet passe de 2 à 0. Par exemple : si un noeud de calcul reçoit l'adresse IP 100.96.2.64, son ILOM dispose de l'adresse IP 100.96.0.64. Lorsqu'elles sont affectées à un hôte, ces adresses IP sont stockées et conservées dans la base de données DHCP.