En savoir plus sur la détection des fraudes en continu

Dans ce guide de solutions, vous apprendrez à utiliser le cadre de cybersécurité NVIDIA Morpheus pour déployer une détection de fraude en temps réel basée sur l'IA à l'aide d'un pipeline Morpheus accéléré par GPU et publier les résultats à l'aide de Compute Cloud@Customer. La solution permet une détection instantanée des fraudes sans attendre les traitements batch et assure la sécurité de vos données en les traitant localement en périphérie.

Avant de commencer

- Système d'exploitation : Ubuntu 24.04 LTS

- Plate-forme : NVIDIA AI Enterprise sur une instance Oracle Compute Cloud@Customer à noeud unique équipée d'un GPU NVIDIA L40S.

Avant de commencer, assurez-vous que les outils suivants sont installés sur l'ordinateur hôte :

- Docker et Docker Compose (

docker compose V2) - Git et Git LFS (

git-lfs) - Python 3 et

Pip

Workflow

Le workflow tire parti de la structure de cybersécurité NVIDIA Morpheus pour effectuer une inférence accélérée par GPU sur un flux de données de transactions financières.

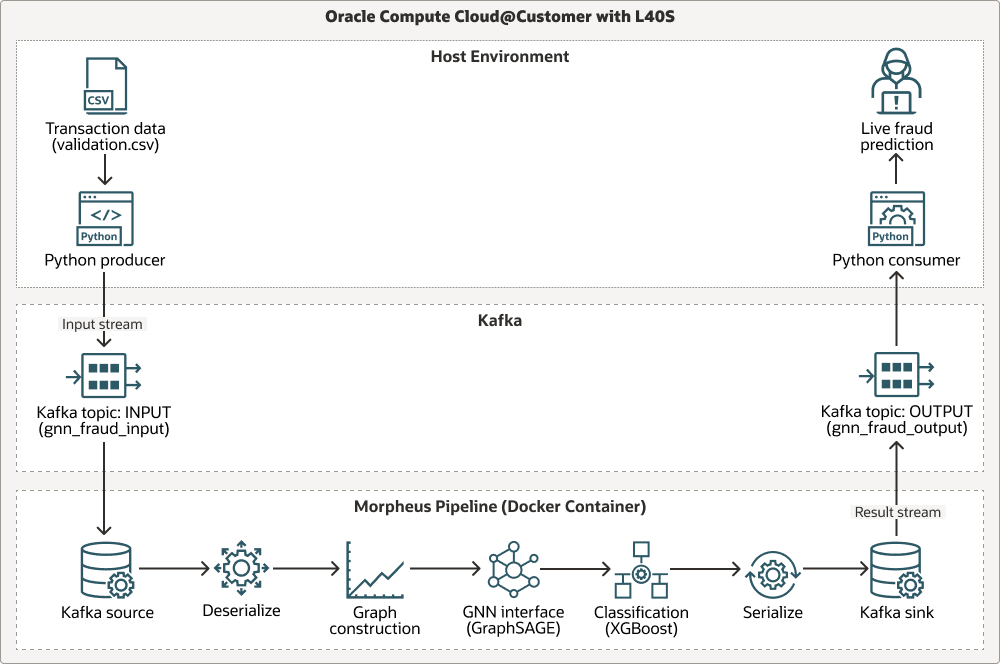

Le diagramme suivant présente un workflow via trois couloirs : l'environnement hôte, Apache Kafka et le pipeline Morpheus :

Le pipeline ingère des données de transaction en direct via Apache Kafka, effectue une analyse contextuelle basée sur des graphiques à l'aide d'un modèle Graph Sample and Aggregate (GraphSAGE) préentraîné et exécute la classification finale des fraudes à l'aide de XGBoost. Toutes les étapes sont accélérées à l'aide des bibliothèques RAPIDS NVIDIA (cuDF, cuML), ce qui optimise l'ensemble du processeur graphique de workflow pour un débit élevé. Le flux du processus est le suivant :

Transaction data (.csv)est produit par un émetteur Python.- Les données sont transmises au flux

INPUTde la rubrique Kafka. - Les données sont traitées par le pipeline Morpheus en étapes : lecture à partir de la source Kafka, désérialisation, construction d'un graphique, interface avec l'interface Graph Neural Network (GNN) (

GraphSAGE), classification avecXGBoost, sérialisation des résultats et écriture dans le récepteur Kafka. - Les résultats sont envoyés au flux

OUTPUTde la rubrique Kafka. - Un destinataire Python reçoit une sortie et fournit une prédiction de fraude en direct.

Provenance du modèle

Le pipeline d'inférence au cœur de cette architecture utilise deux modèles de machine learning préentraînés : un GNN GraphSAGE et un classificateur XGBoost. Ces modèles ont été générés à l'aide d'un pipeline d'entraînement distinct, qui est inclus dans le référentiel Morpheus pour référence.

- Emplacement du script de formation :

examples/gnn_fraud_detection_pipeline/training.py. - Processus : le script traite un ensemble de données historique étiqueté pour entraîner le GNN sur les fonctionnalités basées sur des graphiques et le modèle

XGBoostsur les incorporations résultantes.

Dans cette solution, vous n'avez pas besoin d'exécuter le script d'entraînement car les modèles préentraînés sont déjà fournis. Mettre l'accent sur le déploiement et l'exécution du pipeline d'inférence en temps réel.

Cette architecture prend en charge les composants suivants :

- Oracle Compute Cloud@Customer

Oracle Compute Cloud@Customer est une infrastructure entièrement gérée à l'échelle du rack qui vous permet d'utiliser OCI Compute où que vous soyez. Bénéficiez des avantages de l'automatisation et de l'économie du cloud dans votre data center en exécutant des formes OCI Compute et GPU avec des services de stockage et de mise en réseau sur Compute Cloud@Customer. Vous pouvez exécuter des applications et exploiter la puissance de GenAI sur l'infrastructure cloud de votre centre de données tout en vous aidant à gérer la résidence des données, la sécurité et les connexions à faible latence aux ressources locales et aux opérations en temps réel.

- CuDF/cuMLRAPIDS

RAPIDS cuDF/cuML est une suite de bibliothèques accélérées par GPU pour des utilitaires de manipulation de données et d'apprentissage automatique hautes performances dans le pipeline Morpheus.

- Docker + Conda

Docker + Conda fournissent une approche en couches de la gestion des dépendances, à l'aide de Docker pour l'isolation au niveau du système d'exploitation et de Conda pour la gestion de l'environnement Python complexe dans le conteneur.

Remarques concernant la production

Lors de l'implémentation de cette solution dans un environnement de production, tenez compte de l'évolutivité et de la résilience que Kubernetes peut fournir. Vous pouvez migrer cette solution vers OCI Kubernetes Engine (OKE) en effectuant les opérations suivantes :

- Mise en conteneur des scripts d'aide du producteur et du consommateur.

- Déploiement de Kafka à l'aide d'un opérateur Kubernetes de niveau production.

- Déploiement du pipeline Morpheus en tant que travail ou déploiement Kubernetes.

A propos des services et rôles requis

Cette solution requiert les services et rôles suivants :

- Oracle Compute Cloud@Customer

- NVIDIA AI Enterprise 6.0

-

Ubuntu Linux (ou une distribution Linux compatible)

- Docker

- NVIDIA Morpheus 25.02

Il s'agit des rôles nécessaires pour chaque service.

| Nom du service : Rôle | Obligatoire pour... |

|---|---|

Oracle Compute Cloud@Customer : administrator |

Configurez et déployez l'instance de machine virtuelle NVIDIA AI Enterprise, gérez les ressources réseau et assurez l'accès au GPU NVIDIA L40S. |

Ubuntu Linux : root ou utilisateur disposant de privilèges sudo

|

Installez le logiciel prérequis (Docker, Git), gérez les services système et exécutez les commandes Docker. |

| NVIDIA AI Enterprise : Utilisateur de compte | Extrayez l'image de conteneur NVIDIA Morpheus requise du catalogue NVIDIA GPU Cloud (NGC). |

Reportez-vous à Produits, solutions et services Oracle pour obtenir ce dont vous avez besoin.