Configuration pour la récupération après sinistre

Vous pouvez utiliser les scripts fournis avec ce manuel de solutions pour créer un cliché YAML dans un cluster Kubernetes principal et le restaurer dans un autre cluster Kubernetes (secondaire). Il est important de planifier la configuration et de comprendre les exigences avant de télécharger et d'utiliser les scripts pour configurer votre cliché YAML.

Remarques :

Cette solution suppose que les clusters Kubernetes, y compris le plan de contrôle et les noeuds de processus actif, existent déjà.Planification de la configuration

Planifiez les ressources et la configuration sur le système secondaire en fonction du système principal. Les scripts exigent que les deux clusters Kubernetes existent déjà. Vous devez pouvoir accéder aux deux clusters à l'aide de l'outil de ligne de commande Kubernetes,

kubectl, afin d'exécuter des commandes sur ces derniers.

Remarques :

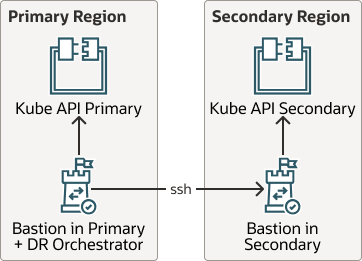

Cette solution suppose que les clusters Kubernetes, y compris le plan de contrôle et les noeuds de processus actif, existent déjà. Les recommandations et les scripts fournis dans ce manuel ne vérifient pas les ressources, le plan de contrôle ou la configuration des noeuds de processus actif.Le diagramme suivant montre qu'une fois configuré, vous pouvez restaurer le cliché d'artefact dans des clusters Kubernetes complètement différents.

Description de l'image kube-api-dr.png

Suivez les exigences suivantes pour Restore lors de la planification de votre configuration :

Vérifier

Après avoir exécuté le script

maak8DR-apply.sh, vérifiez que tous les artefacts qui existaient dans le cluster principal ont été répliqués vers le cluster secondaire. Examinez le cluster secondaire et vérifiez que les pods du site secondaire sont en cours d'exécution sans erreur.

Lorsque vous exécutez le script maak8DR-apply.sh, la structure crée le répertoire working_dir en tant que /tmp/backup.date. Lorsque vous exécutez les scripts maak8-get-all-artifacts.sh et maak8-push-all-artifacts.sh individuellement, le répertoire de travail est fourni dans chaque cas en tant qu'argument dans la ligne de commande.