Configurazione dello streaming strutturato Spark mediante i flussi di lavoro

È possibile configurare un task di streaming all'interno di un flusso di lavoro per l'elaborazione continua dei dati di flusso.

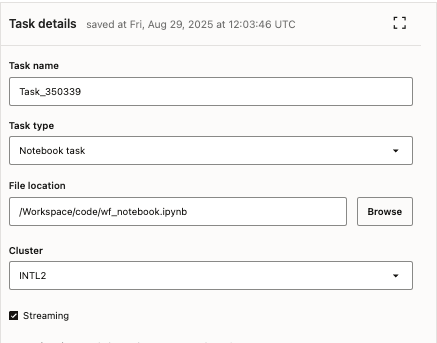

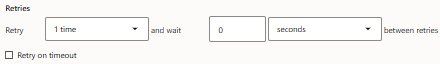

Prima è necessario creare un job, quindi aggiungere un blocco note o un task Python a tale job per iniziare a utilizzare i flussi di lavoro con lo streaming in Oracle AI Data Platform Workbench.

Dopo l'avvio di un task di streaming, l'esecuzione continua finché non viene interrotta manualmente. Durante la normale manutenzione mensile, l'attività di streaming viene arrestata e riavviata dal servizio senza richiedere alcuna azione da parte tua.