Informazioni sullo streaming

Puoi elaborare i dati in streaming o i dati prodotti in modo continuo quasi in tempo reale in Oracle AI Data Platform Workbench utilizzando la funzionalità di streaming strutturato di Apache Spark.

Sia i notebook che i flussi di lavoro supportano lo streaming strutturato di Apache Spark. È possibile utilizzare le seguenti origini e sink per leggere i dati dei flussi, scrivere i dati dei flussi in e per le posizioni dei checkpoint.

Tabella 17-1 Fonti e lavelli supportati

| Origine o lavandino | Supportato? |

|---|---|

| Percorso del volume (/Volume/bronze/bucket1) | Supportato per tutti i formati |

| Percorso area di lavoro (/Workspace/folder1/) | Supportato per tutti i formati |

| Tabelle nei cataloghi con tre nomi di parte (catalog.schema.table) | Supportato solo per il formato Delta

Non supportato per i formati Parquet, CSV, JSON e ORC Esempio 1: codice supportato

Esempio 2: codice non supportato

|

| Kafka | Supportato per qualsiasi flusso compatibile con Kafka senza convenzione di denominazione in tre parti

Non supportato per il catalogo basato su Kafka in base alla convenzione di denominazione in tre parti |

| Servizio di streaming OCI | Supportato |

| Percorso di storage degli oggetti OCI (utilizzando OCI://) | Non supportata |

| Oracle Autonomous AI Lakehouse, Oracle AI Database, Oracle Autonomous AI Transaction Processing | Non supportato per lo streaming (readStream o writeStream) |

Streaming strutturato tramite notebook

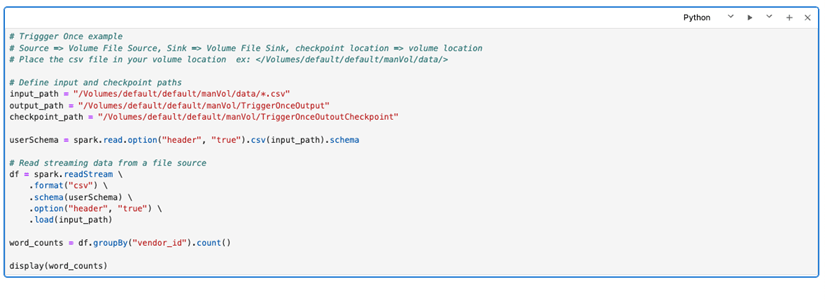

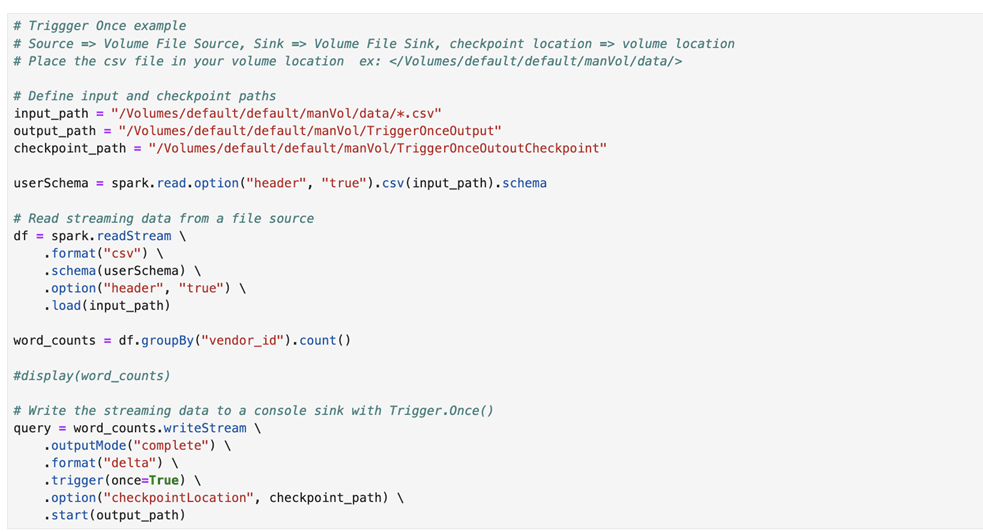

È possibile scrivere codice Python per elaborare i dati di flusso in un notebook. I percorsi di volume o di area di lavoro sono validi come posizione di checkpoint, ma i percorsi di storage degli oggetti (formato oci://) non sono supportati come posizione di checkpoint. Si consiglia di utilizzare i percorsi di volume come posizione di checkpoint.

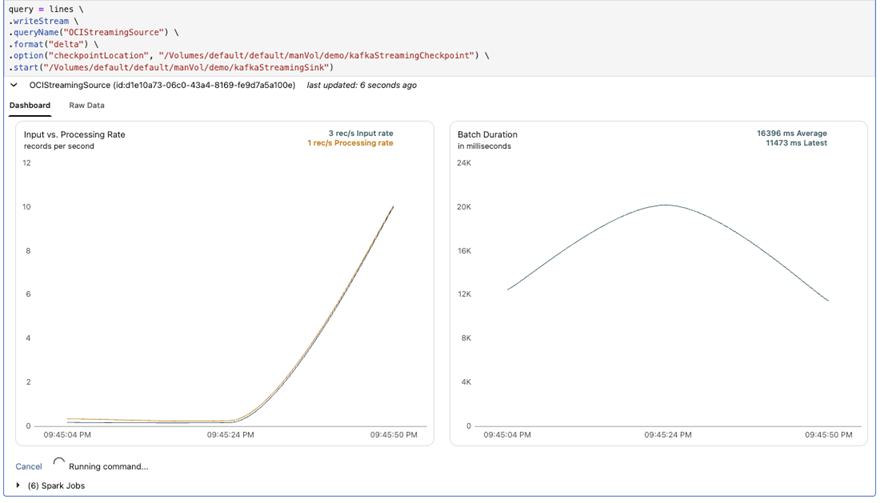

È possibile visualizzare gli eventi correlati allo streaming di Apache Spark, ad esempio la velocità di input, la velocità di elaborazione e la durata del batch dalla scheda Dashboard nel notebook durante l'esecuzione del codice di streaming.

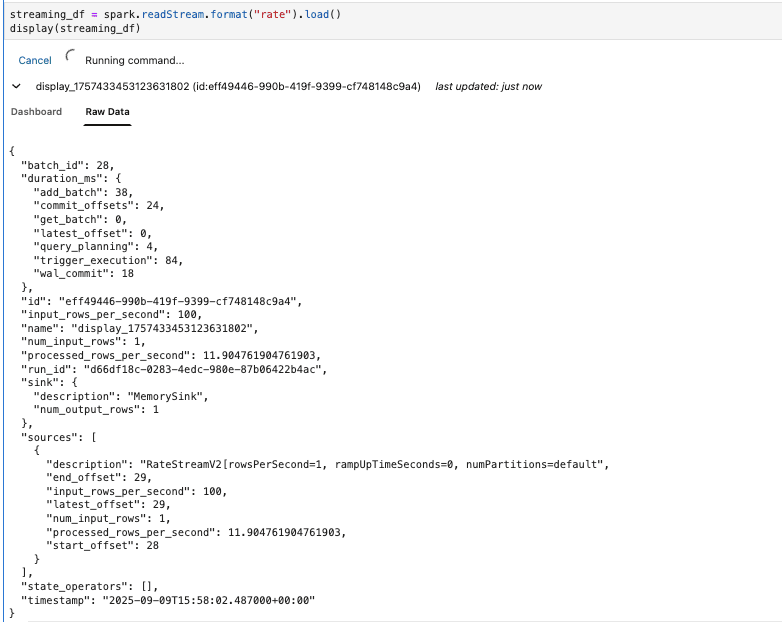

È inoltre possibile visualizzare gli eventi relativi allo streaming raw dalla scheda Dati raw mentre si sviluppa il codice in modo incrementale.