ワークフローを使用したSpark構造化ストリーミングの構成

ストリーム・データを継続的に処理するために、ワークフロー内でストリーミング・タスクを構成できます。

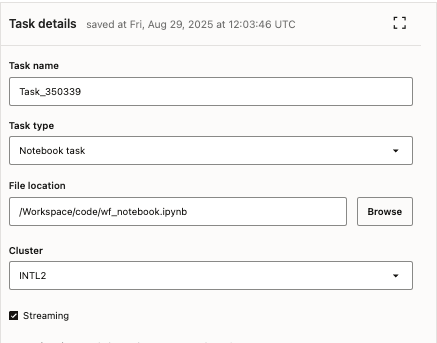

最初にジョブを作成し、そのジョブにノートブックまたはPythonタスクを1つ追加して、Oracle AI Data Platform Workbenchでストリーミングを使用するワークフローの使用を開始する必要があります。

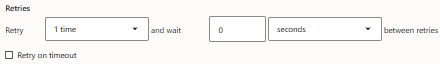

ストリーミング・タスクが開始されると、手動で停止するまで実行が続行されます。定期的な月次メンテナンス中、ストリーミング・タスクはサービスによって停止および再起動され、ユーザー側からのアクションは必要ありません。