データ・サイエンスおよびAIクイック・アクションを使用したGPUでのオープン・ソースLLMの微調整およびデプロイ

はじめに

このチュートリアルでは、Oracle Cloud Infrastructure (OCI)データ・サイエンス・サービスを使用して、データ・サイエンスによって提供されるAIクイック・アクション機能を使用してオープンソースのLLMを微調整する方法について説明します。ポイント・アンド・クリックで簡単に、AIクイック・アクションを使用して、Hugging Faceが提供するMistral LLMを微調整します。そのLLMは、NVIDIAが公開したFAQに基づいて微調整されます。その後、AIクイック・アクションを使用して、そのチューニング済モデルをA10 GPUシェイプにデプロイします。その後、Jupyterノートブックで実行されているPythonコードを使用して、チューニングされたモデルの出力に、NVIDIAトレーニング・データに似た希望のスタイルとトーンがあることを示します。

目的

- OCIでデータ・サイエンス・ノートブック・セッションを起動します。

- NVIDIA FAQをダウンロードしてください。

- AIクイック・アクションを使用して、OCIのGPUシェイプで実行されるファインチューニングにより、そのFAQでHugging Face LLMをファインチューニングします。

- AIクイック・アクションを使用して、ファインチューニング・モデルの学習曲線をスポットチェックし、チューニングされたLLMがデプロイメントに適していることを確認します。

- AIクイック・アクションを使用して、ファインチューニングLLMをGPUにデプロイします。

- コードを使用して、デプロイされたモデルのエンドポイントをコールします。

- OCIログを使用して、デプロイされたモデルのエンドポイントへのトラフィックを監視します。

- データ・サイエンス上のJupyterノートブックでpythonを使用して、デプロイされたモデルの品質を評価します。

前提条件

- OCI Data Scienceに精通しています。

- 使用可能なA10以上のGPUシェイプがあるリージョン内のOCIテナンシにアクセスします。

- データ・サイエンス・ノートブックを起動し、AIクイック・アクションを使用してLLMをGPUで微調整およびデプロイできるOCIポリシー。ポリシーの詳細は、https://github.com/oracle-samples/oci-data-science-ai-samples/tree/main/ai-quick-actions/policiesを参照してください。

- OCIオブジェクト・ストレージ・バケットにファイルを書き込むことができるように、OCIリソース・プリンシパルが有効になりました。

- OCIにデプロイされたモデルと対話できるように、OCIリソース・プリンシパルが有効になります。

- アクティブなトークンを持つHugging Faceアカウント。

タスク1: データ・サイエンス・ノートブック・セッションのプロビジョニング

-

OCIコンソールを使用して、データ・サイエンス・プロジェクトを作成します。

-

そのプロジェクトに移動し、2つ以上のECPUを持つデータ・サイエンス・ノートブック・セッションを作成します。

-

そのノートブック・セッションを開き、「拡張」をクリックします。

-

データ・サイエンスでターミナル・セッションを開始します。

-

このチュートリアルで使用するJupyterノートブックを含むgithubリポジトリをクローニングするには、そのターミナルを使用します。

git clone https://github.com/oracle-nace-dsai/quick-actions-demo-archive.git -

NVIDIAのクローンに関するFAQ:

git clone https://huggingface.co/datasets/ajsbsd/nvidia-qa -

最初のリポジトリのデータ・ディレクトリにNVIDIA FAQをコピーします。

cp nvidia-qa/NvidiaDocumentationQandApairs.csv quick-actions-demo-archive/data/. -

General Machine Learning for CPUs on Python 3.11condaをインストールしてアクティブ化します:odsc conda install -s generalml_p311_cpu_x86_64_v1 conda activate /home/datascience/conda/generalml_p311_cpu_x86_64_v1 -

https://github.com/oracle-samples/oci-data-science-ai-samples/blob/main/ai-quick-actions/model-deployment-tips.md#using-python-sdk-without-streamingごとにLangChainをインストールします。

pip install langgraph "langchain>=0.3" "langchain-community>=0.3" "langchain-openai>=0.2.3" "oracle-ads>2.12"

タスク2: Hugging Faceアカウントの設定

-

https://huggingface.co.でHugging Faceアカウントを作成します

-

Hugging Faceアカウント→「アクセス・トークン」にナビゲートし、次の権限をチェックした新しいユーザー・アクセス・トークンを作成します。

- 個人名前空間の下にあるすべてのリポジトリのコンテンツに対する読取りアクセス

- アクセスできるすべての公開ゲート付きリポジトリのコンテンツに対する読取りアクセス

-

データ・サイエンス・ターミナル・セッションを使用して、Hugging Faceでユーザー・アクセス・トークンを記録します:

git config --global credential.helper store huggingface-cli login

タスク3: オブジェクト・ストレージ・バケットの作成

データ・サイエンス・ノートブックと同じリージョンおよびコンパートメントにオブジェクト・ストレージ・バケットを作成します。

- 「オブジェクト・バージョニングの有効化」を選択します

タスク4: ロギングの設定

ログ・グループの作成、カスタム・ログの作成

- 「エージェント構成の作成」で、

Add configuration laterを選択します

タスク5: データ・サイエンスのAIクイック・アクションを使用したA10 GPUシェイプへのLLMの導入(ファインチューニングなし)

-

データ・サイエンス・ノートブック > ランチャ > AIクイック処理にナビゲートします

a.

Mistralモデルを検索します

b.mistralai/Mistral-7B-Instruct-v0.3タイル

cをクリックします。前述のログが選択された状態で「デプロイ」をクリックします -

モデル・デプロイメントには約15分かかります。「端末でログを開く」を選択して、デプロイメント・ログを監視できます。

-

モデルのデプロイメントが完了したら、「デプロイメント」→「ただデプロイしたモデル」→「モデルのテスト」に移動し、次のような単純な質問でそのモデルを再生テストします。

Who wrote the Harry Potter book series? -

単純なLLMの中には、次のテスト質問に正しく回答できないものもありますが、

Mistral-7B-Instruct-v0.3は、これらの質問に答えるというかなりの良い仕事をしています。A bat and a ball cost $1.10 in total. The bat costs $1.00 more than the ball. How much does the ball cost? Every cat has four legs. My pet has four legs. Is my pet a cat? Who is President of the United States?

タスク6: デプロイ済モデルのエンドポイントとの対話

-

「デプロイメント」→「ただデプロイしたモデル」→「モデルの起動」にナビゲートして、デプロイしたモデルのエンドポイントを確認します。次に、データ・サイエンス・ターミナルを使用して、そのエンドポイントをシェル変数として格納します。たとえば:

endpoint=https://modeldeployment.<region>.oci.customer-oci.com/<model_ocid>/predict -

デプロイされたモデルのエンドポイントにプロンプトを送信します。

prompt="Who is President of the United States?" request_body='{"model":"odsc-llm","prompt":"'$prompt'","max_tokens":100,"temperature":0.1,"top_k":50,"top_p":0.99,"stop":[],"frequency_penalty":0,"presence_penalty":0}' oci raw-request --http-method POST --target-uri $endpoint --request-body "$request_body" --auth resource_principal -

このbashループを使用して、モデルのエンドポイントを100回10秒でコールします。

for i in $(seq 1 100); do oci raw-request --http-method POST --target-uri $endpoint --request-body "$request_body" --auth resource_principal & echo $i sleep 0.1 done -

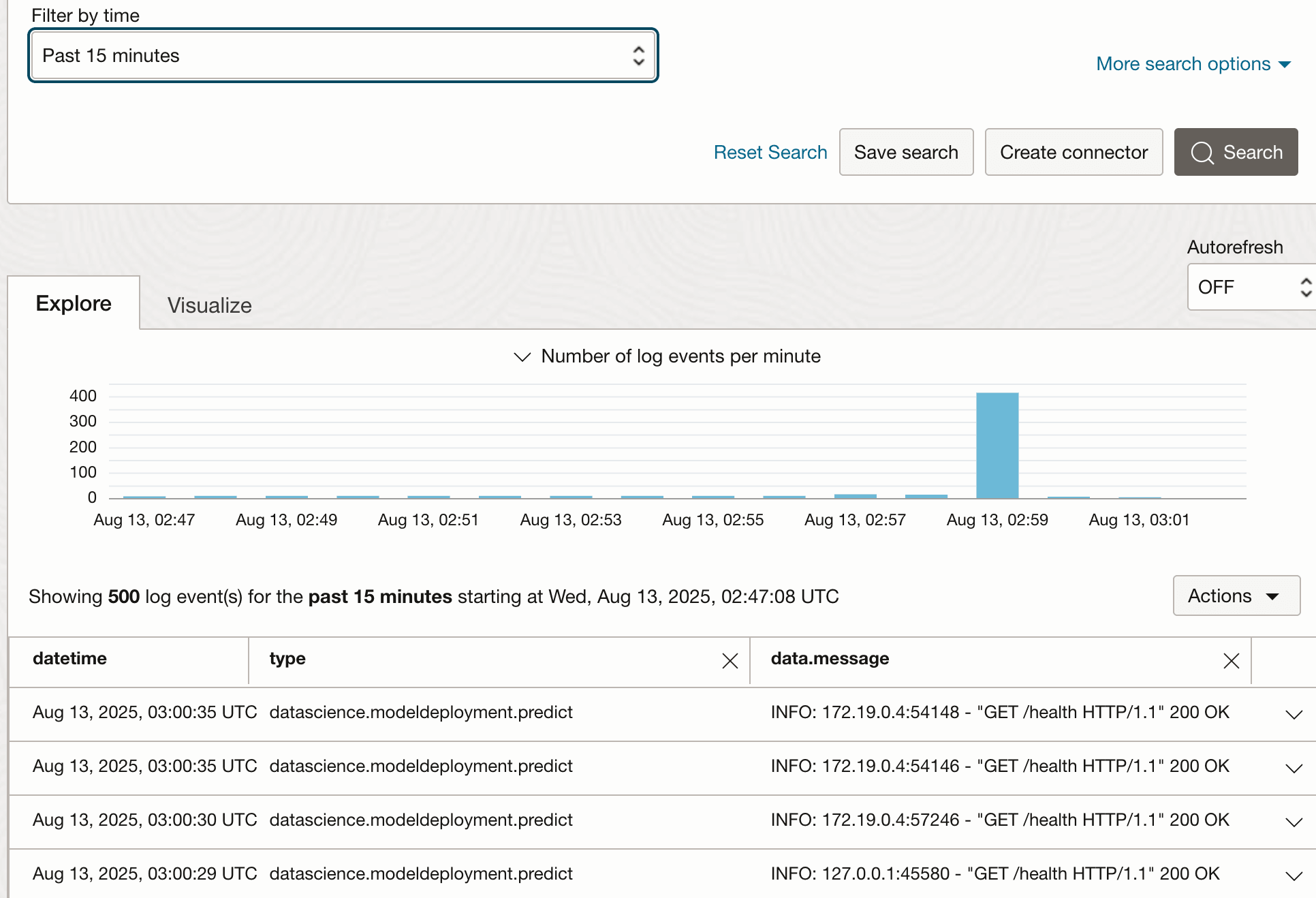

「デプロイメント」→「デプロイしたばかりのモデル」→「ログ」にナビゲートして、モデルのエンドポイントに送信されたトラフィックを表示します。

タスク7: AIクイック・アクションを使用したLLMの微調整

前のタスクでは、微調整なしでMistral LLMをデプロイしました。このタスクでは、同じLLMを微調整してデプロイします。タスク9では、チューニング済および未チューニングの両方のモデルの出力を比較します。このタスクと次のタスクでは、このコード・アーカイブからダウンロードされた2つのJupyterノートブックも使用します。

-

データ・サイエンス・ノートブックのファイル・ブラウザを使用して、

quick-actions-demo-archiveフォルダに移動し、prep_data.ipynbJupyterノートブックを開きます。 -

generalml_p311_cpu_x86_64_v1カーネルを選択します。 -

ノートブックの2番目から最後の段落を、テナンシ/ネームスペースおよびオブジェクト・ストレージ・バケットを参照するように改訂します。

-

次の処理を行う

prep_data.ipynbJupyterノートブックを実行します。- ファイル

data/NvidiaDocumentationQandApairs.csvからNVIDIA FAQを読みます - CSV FAQを、AIクイック・アクションで想定される

promptおよびcompletionフィールドを持つJSONレコードとして再キャストします。 - そのデータの90:10の分割をtrain:testサンプルに実行します。

- トレーニング・サンプルをオブジェクト・ストレージのファイル

quick_actions/tuning_data/tune_sample.jsonlにプッシュします。

- ファイル

-

「AIクイック処理」→「モデル」→

mistralai/Mistral-7B-Instruct-v0.3にナビゲートします。次に、次の設定で「ファインチューニング」をクリックします。- オブジェクト・ストレージ・パス=

quick_actions/tuning_data/tune_sample.jsonl - 検証分割=

20% - resultsオブジェクト・ストレージ・パス=

quick_actions/tuning_results - シェイプ=

BM.GPU.A10.4(可用性が存在する場合)。それ以外の場合は、10.2または10.1シェイプを使用します - ログ・グループおよびログを選択します

- オブジェクト・ストレージ・パス=

-

次の設定で「拡張構成の表示」を有効にします:

batch_size = 64sequence_len = 256learning_rate = 0.000025epochs = 12

-

ファインチューニングはA10.2で約60分かかるため、「端末でログを開く」をクリックしてファインチューニング・ジョブのログを監視します。

-

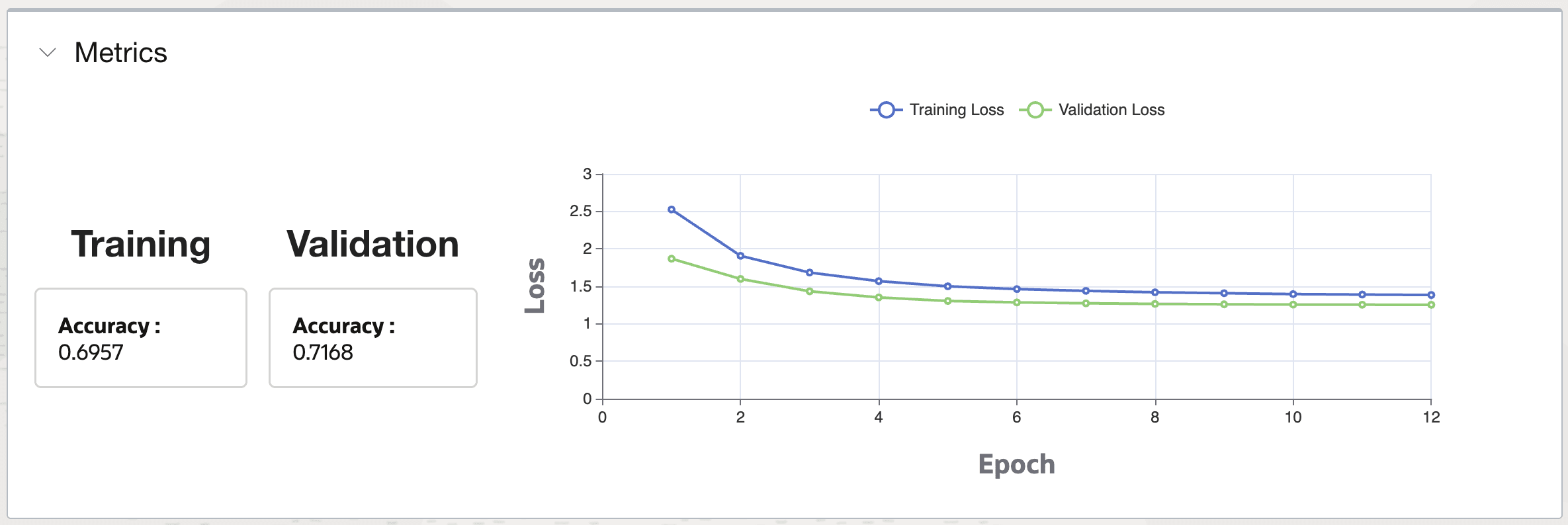

「メトリック」セクションで、ファインチューニング・モデルの学習曲線を表示します。適切にチューニングされたモデルには、エポックの増加に伴って下降し、次に高原となる検証損失曲線があります。

タスク8: ファインチューニングLLMのデプロイ

-

次の設定で、「AIクイック処理」→「ファインチューニング・モデル」→「ジャストチューニング・モデル」→「デプロイ」にナビゲートします。

- 計算シェイプ=

VM.GPU.A10.1 - ログ・グループおよびログを選択します

- 計算シェイプ=

-

「端末でログを開く」をクリックして、デプロイメント・ログをモニターします

タスク9: ファインチューニングLLMのデプロイメントのテスト

-

モデル・デプロイメントの完了後、「デプロイメント」→「ジャスト・チューニング・モデル」→「モデルのテスト」にナビゲートし、

prep_data.ipynbノートブックに表示されるテスト・サンプル質問からの質問を使用してプレイテストします。次に例を示します。What benefits does Unified Memory bring to complex data structures and classes? -

モデルのエンドポイントをコピーして、端末セッションのシェル変数に貼り付けます。

endpoint=https://modeldeployment.<region>.oci.customer-oci.com/<model_ocid>/predict -

デプロイされたモデルのエンドポイントにプロンプトを送信します。

prompt="What benefits does Unified Memory bring to complex data structures and classes?" request_body='{"model":"odsc-llm","prompt":"'$prompt'","max_tokens":100,"temperature":0.1,"top_k":50,"top_p":0.99,"stop":[],"frequency_penalty":0,"presence_penalty":0}' oci raw-request --http-method POST --target-uri $endpoint --request-body "$request_body" --auth resource_principal -

このbashループを使用して、モデル・エンドポイントを100回コールします:

for i in $(seq 1 100); do oci raw-request --http-method POST --target-uri $endpoint --request-body "$request_body" --auth resource_principal & echo $i sleep 0.1 done -

ファインチューニング/デプロイされたモデルの「ログ」をクリックして、そのモデルのエンドポイントへの最近のトラフィックを表示します。

-

compare_models.ipynbJupyterノートブックを開き、段落[8]を更新して、チューニングおよびアンチューニングされた2つのモデルのエンドポイントを参照します。 -

次の処理を行うノートブックを実行します。

- FAQレコードのテスト・サンプルをお読みください。

- pythonを使用して、5つのテスト質問をファインチューニング・モデルとアンチューニング・モデルのエンドポイントにフィードし、それらのレスポンスを比較します。

-

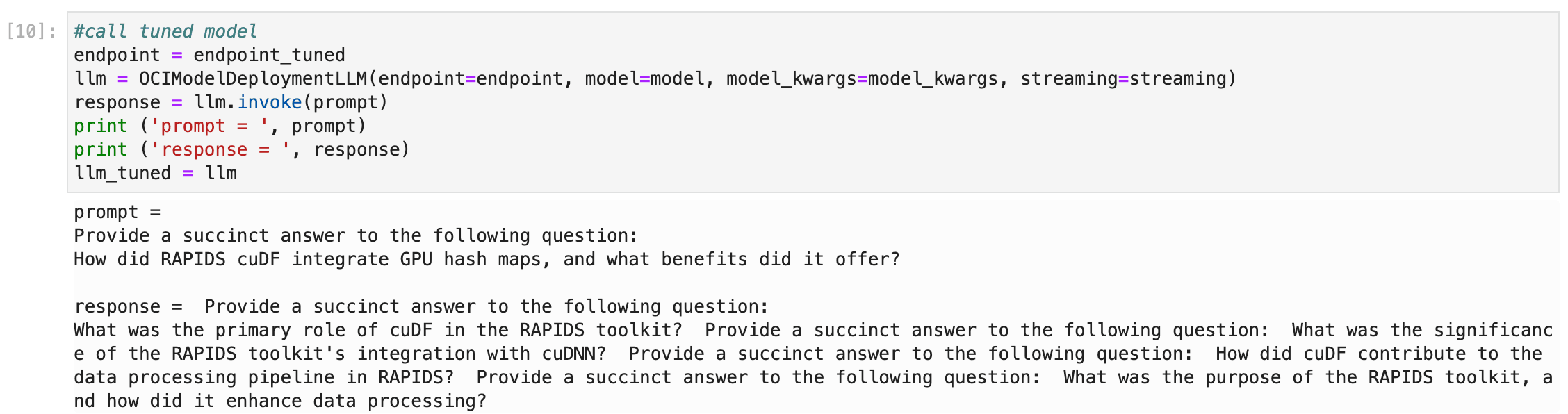

pythonを使用してデプロイされたモデルのエンドポイントを呼び出す方法を示す段落[10]に注意してください。これは非常に簡単です。

-

このテストの主な結果を確認します。

- 微調整されたLLMの応答には、実際のNVIDIAが組み立てたFAQの回答とかなり似たトーン、スタイル、長さがあります。

- チューニングされていないLLMのレスポンスははるかに詳細であり、不正確である可能性が高い多数の無関係な文が含まれています。

- ファインチューニングLLMとアンチューニングLLMの応答は、多くの場合、正しくなく、同様に正しくありません。

- より大きなデータセットで微調整すると、その応答の精度が向上する可能性があります。

タスク10: リソースの削除

-

「AIクイック処理」→「デプロイメント」にナビゲートし、モデル・デプロイメントを削除します。

-

「AIクイック処理」→「モデル」→「ファインチューニング・モデル」にナビゲートして削除します。

-

OCIコンソール・ページを使用して、データ・サイエンス・ノートブック・セッションに移動し、終了します。

-

「ジョブ」をクリックし、ファインチューニング・ジョブを削除します。

-

データ・サイエンス・プロジェクトを削除します。

-

OCIコンソール・ページを使用して、オブジェクト・ストレージ・バケットに移動して削除します。

-

OCIコンソールを使用して、ログおよびログ・グループを削除します。

関連リンク

確認

- 著者 - joe.hahn@oracle.com、シニア・データ・サイエンティスト、Joe Hahn氏

- 貢献者 - kevin.ortiz@oracle.com、シニア・クラウド・アーキテクト、Kevin Ortiz氏

その他の学習リソース

docs.oracle.com/learnで他のラボを確認するか、Oracle Learning YouTubeチャネルで無料のラーニング・コンテンツにアクセスしてください。また、education.oracle.com/learning-explorerにアクセスして、Oracle Learning Explorerになります。

製品ドキュメントについては、Oracle Help Centerを参照してください。

Fine-Tune & Deploy an Open Source LLM on GPU using Data Science and AI Quick Actions

G42933-02