Configurando o Streaming Estruturado do Spark usando Workflows

Você pode configurar uma tarefa de streaming dentro de um fluxo de trabalho para processamento contínuo de dados de fluxo.

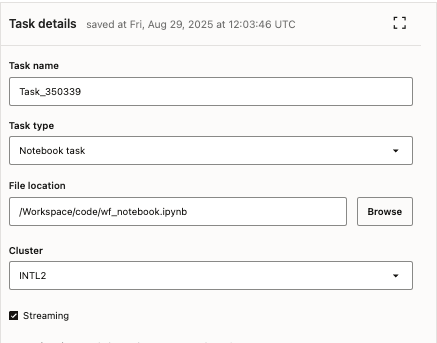

Primeiro você precisa criar um job e depois adicionar um Notebook ou uma tarefa Python a esse job para começar a usar workflows com streaming no Oracle AI Data Platform Workbench.

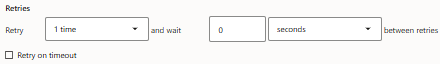

Depois que uma tarefa do Streaming é iniciada, ela continua a ser executada até que você a interrompa manualmente. Durante a manutenção mensal regular, a tarefa de Streaming é interrompida e reiniciada pelo serviço sem exigir nenhuma ação da sua extremidade.