Sobre o Streaming

Você pode processar dados de streaming ou dados produzidos continuamente quase em tempo real no Oracle AI Data Platform Workbench usando o recurso Apache Spark Structured Streaming.

Tanto notebooks quanto workflows suportam streaming estruturado do Apache Spark. Você pode usar as seguintes origens e sumidouros para ler dados de stream, gravar dados de stream e para locais de checkpoint.

Tabela 17-1 Origens e Pias Suportadas

| Origem ou Dissipador | Suportado? |

|---|---|

| Caminho do volume (/Volume/bronze/bucket1) | Suportado para todos os formatos |

| Caminho do espaço de trabalho (/Workspace/folder1/) | Suportado para todos os formatos |

| Tabelas em catálogos com três nomes de partes (catalog.schema.table) | Suportado somente para formato Delta

Não suportado para formatos Parquet, CSV, JSON, ORC Exemplo 1: Código suportado

Exemplo 2: código não suportado

|

| Kafka | Suportado para qualquer fluxo compatível com Kafka sem convenção de nomeação em três partes

Não suportado para catálogo baseado no Kafka após convenção de nomeação em três partes) |

| Serviço OCI Streaming | Suportado |

| Caminho do OCI Object Storage (usando OCI://) | Não Suportado |

| Oracle Autonomous AI Lakehouse, Oracle AI Database, Oracle Autonomous AI Transaction Processing | Não suportado para streaming (readStream ou writeStream) |

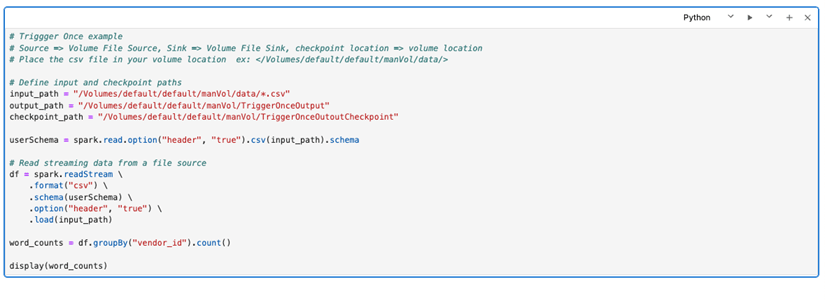

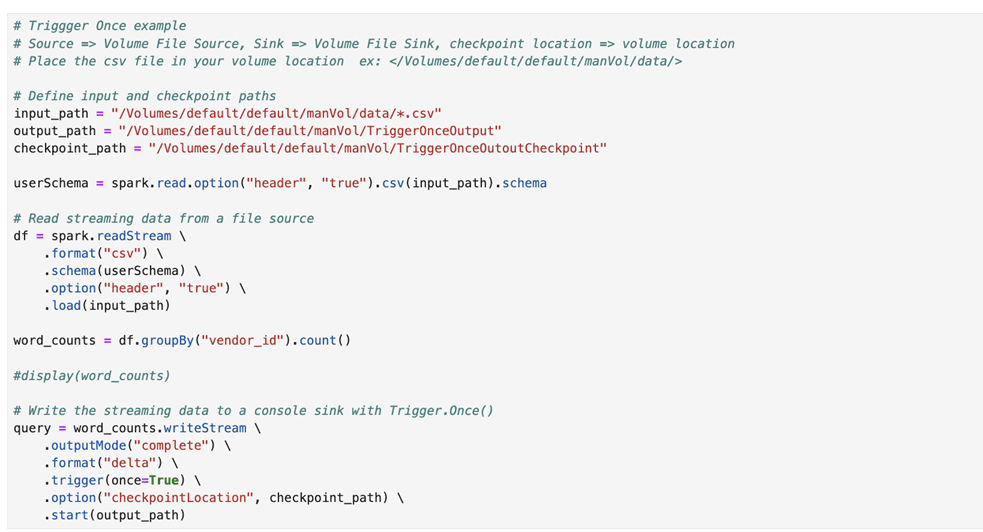

Streaming Estruturado Usando Notebooks

Você pode gravar código Python para processar dados de fluxo em um notebook. Os caminhos de volume ou de espaço de trabalho são válidos como um local de checkpoint, mas os caminhos de Armazenamento de objetos (formato oci://) não são suportados como um local de checkpoint. Recomendamos o uso de caminhos de volume como um local de checkpoint.

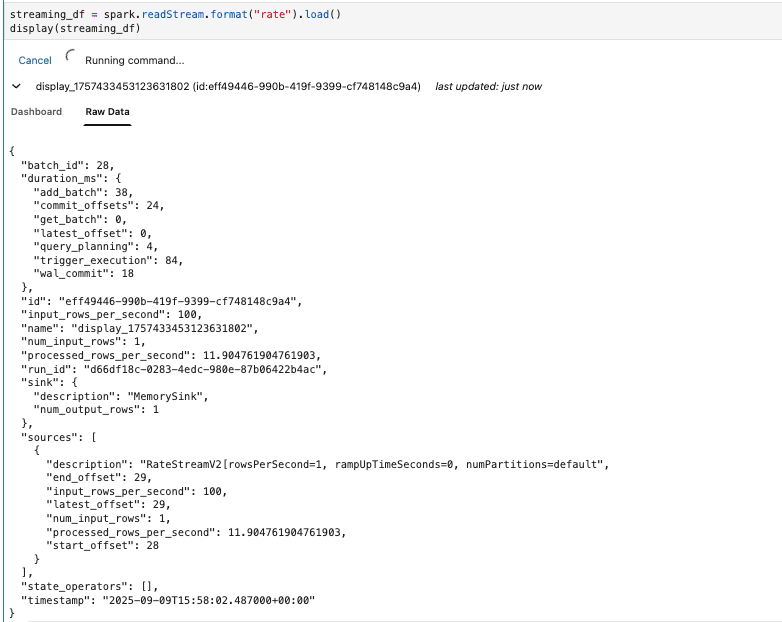

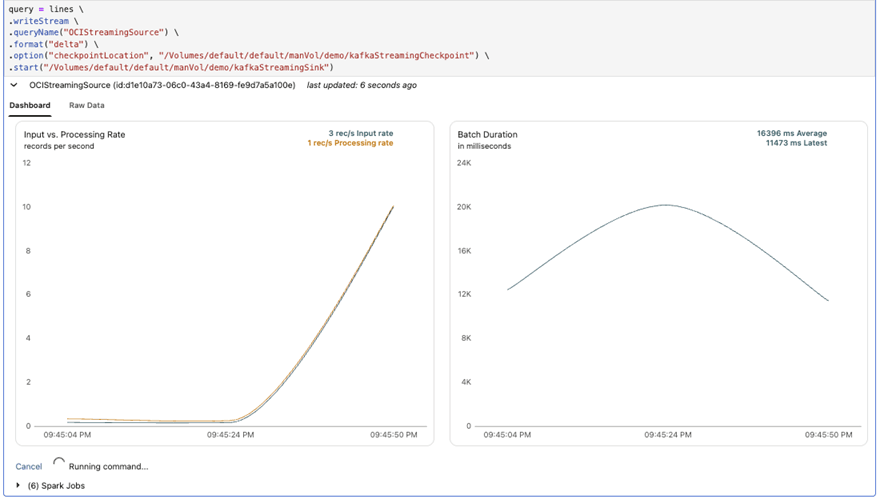

Você pode ver eventos relacionados ao streaming do Apache Spark, como taxa de entrada, taxa de processamento e duração do batch na guia Painel de Controle do seu notebook ao executar o código de streaming.

Você também pode exibir os eventos brutos relacionados ao streaming na guia Dados Brutos enquanto desenvolve seu código de forma incremental.