Configurar replicação bidirecional

Depois de configurar uma replicação unidireccional, há apenas algumas etapas extras para replicar os dados na direção oposta. Este exemplo de início rápido usa o Autonomous AI Transaction Processing e o Autonomous AI Lakehouse como seus dois bancos de dados em nuvem.

Tópicos Relacionados

Antes de começar

Você deve ter dois bancos de dados existentes na mesma tenancy e região para prosseguir com esse início rápido. Se precisar de dados de amostra, faça download de Archive.zip e siga as instruções em Lab 1, Tarefa 3: Carregar o esquema ATP

Visão geral

As etapas a seguir orientam você sobre como instanciar um banco de dados de destino usando o Oracle Data Pump e configurar a replicação bidirecional (em duas vias) entre dois bancos de dados na mesma região.

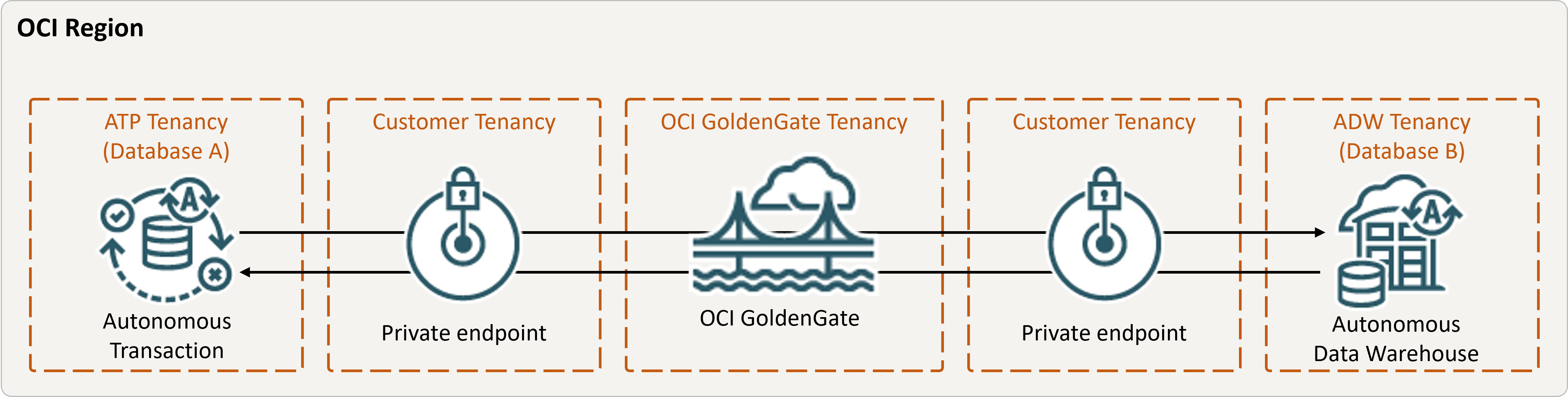

Descrição da ilustração bidirectional.png,

Tarefa 2: Adicionar informações de transação e uma tabela de checkpoint para ambos os bancos de dados

Na console de implantação do OCI GoldenGate, vá para a tela Configuração do Serviço de Administração e conclua os seguintes procedimentos:

Tarefa 3: Criar o Extract Integrado

Um Extract Integrado captura alterações contínuas no banco de dados de origem.

Tarefa 4: Exportar dados usando o Oracle Data Pump (ExpDP)

Use o Oracle Data Pump (ExpDP) para exportar dados do banco de dados de origem para o Oracle Object Store.

Tarefa 5: Instanciar o banco de dados de destino usando o Oracle Data Pump (ImpDP)

Use o Oracle Data Pump (ImpDP) para importar dados para o banco de dados de destino do SRC_OCIGGLL.dmp que foi exportado do banco de dados de origem.

Tarefa 6: Adicionar e executar um processo de Replicat Não Integrado

- Adicionar e executar um processo Replicat.

- Execute algumas alterações no Banco de Dados A para vê-las replicadas no Banco de Dados B.