Compute verwalten

In diesem Abschnitt werden die grundlegenden Funktionen zum Erstellen, Ändern oder Entfernen von Compute-Clustern in AI Data Platform Workbench beschrieben.

Compute-Cluster

Allzweck-Compute-Cluster stellen Ihnen die Compute-Ressourcen zur Verfügung, um Ihre Workloads in einer AI Data Platform Workbench-Instanz zu verarbeiten.

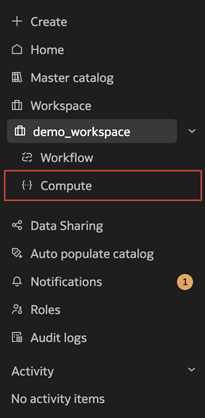

Sie verwalten Ihre Compute-Cluster auf der Seite Compute in Oracle AI Data Platform Workbench.

Berechnungstypen

In AI Data Platform Workbench sind zwei Compute-Typen vorhanden: Allzweck-Compute-Cluster und Standard-Masterkatalog-Compute-Cluster.

In AI Data Platform Workbench können Sie nur Allzweck-Compute-Cluster erstellen. Allzweck-Compute-Cluster eignen sich für eine vielseitige Palette von Workloads und können an Ihre Notizbücher angehängt und in Workflows verwendet werden. Sofern nicht anders angegeben, beziehen sich Verweise auf "Compute Cluster" oder "Cluster" in der Dokumentation auf Allzweck-Compute-Cluster.

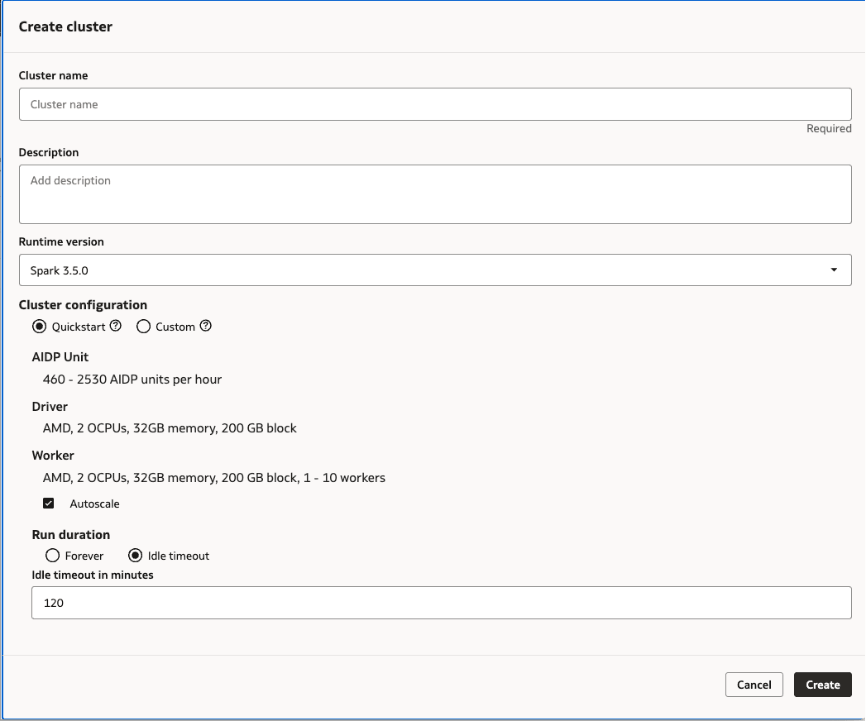

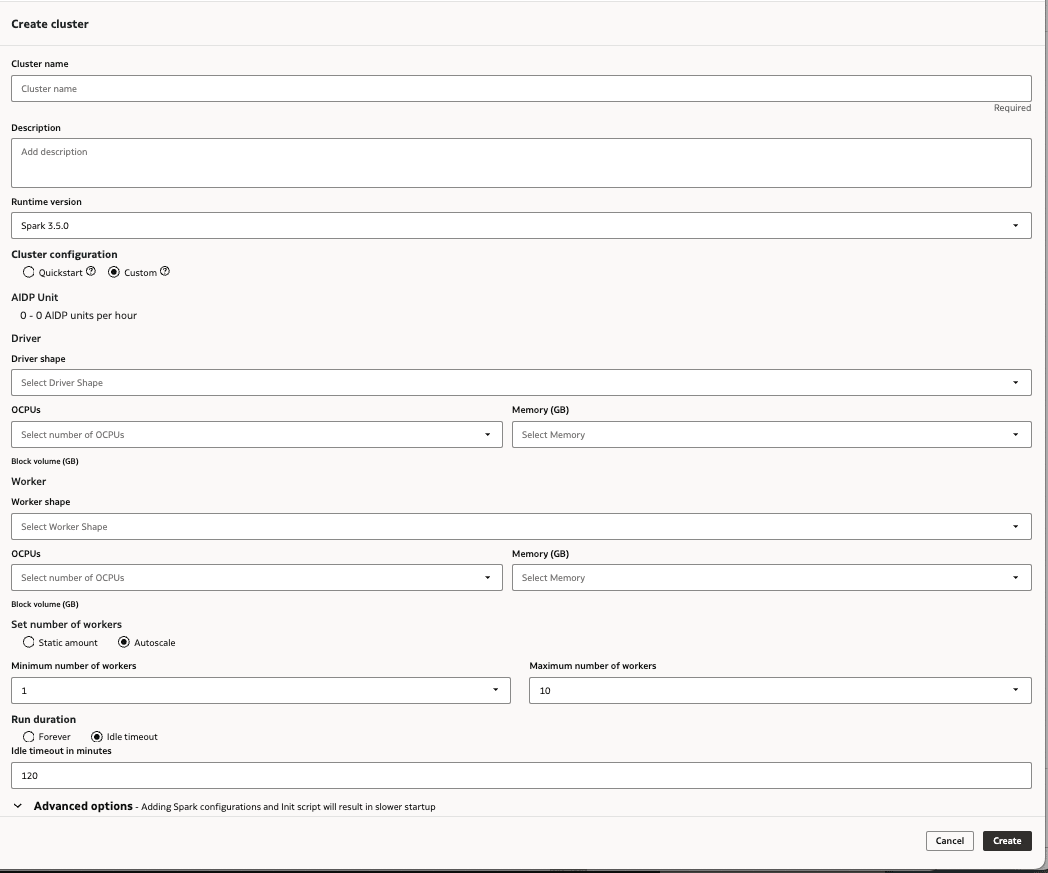

Wenn Sie ein neues Allzweck-Compute-Cluster erstellen, können Sie entweder die Schnellstart- oder die benutzerdefinierte Konfiguration auswählen. Die Schnellstartkonfiguration ist für einen schnellen Start optimiert. Mit der benutzerdefinierten Konfiguration können Sie Ihr Allzweck-Compute-Cluster an die spezifischen Workloads anpassen, die Sie für die Verarbeitung benötigen. In den Konfigurationsoptionen "Schnellstart" und "Benutzerdefiniert" können Sie Kostenprognosen anzeigen und Optionen für den Leerlaufzeit-Timeout ändern.

Hinweis:

Wenn Sie benutzerdefinierte Librarys in einem konfigurierten Allzweck-Compute-Cluster installieren, wird das Cluster automatisch in die benutzerdefinierte Konfiguration geändert. Dies kann sich auf die Startleistung auswirken.Standard-Masterkatalog-Compute-Cluster ist in allen AI Data Platform Workbench-Instanzen vorhanden. Dieses Cluster ist für wesentliche AI Data Platform Workbench-Funktionen verantwortlich, wie Such-Crawls, das Aktualisieren von Katalogobjekten, das Erstellen, Bearbeiten und Löschen von Objekten und das Testen von Verbindungen.

Clusterlaufzeit

Allzweck-Compute-Cluster können mit einer Apache Spark 3.5-Laufzeit erstellt werden. Die Laufzeitumgebung ist kompatibel mit:

- Spark 3.5.0

- Delta 3.2.0 (vorab enthalten)

- Python 3.11

- Scala 2.12

- Hadoop 3.3.4

- Java 17

Wartungsupdates für Compute-Cluster

AI Data Platform Workbench-Compute wendet Wartungsupdates automatisch ohne Benutzereingriff an. Die Wartungsupdates decken alle erforderlichen Sicherheitspatches oder Fehlerkorrekturen für Betriebssystem und interne Komponenten von AI Data Platform Workbench ab.

AI Data Platform Workbench prüft, ob keine aktiven Cluster vorhanden sind, bevor diese monatlichen Wartungsupdates eingespielt werden.

Schnellstartcluster erstellen

Sie können ein Allzweck-Compute-Cluster mit vorkonfigurierten Einstellungen zur Verarbeitung von Daten und AI-Workloads in Ihrer AI Data Platform Workbench erstellen.

Sie können das Cluster nach der Erstellung jederzeit bearbeiten.

Benutzerdefiniertes Cluster erstellen

Sie können ein Allzweck-Compute-Cluster mit Konfigurationseinstellungen Ihrer Wahl erstellen, um Daten und KI-Workloads in Ihrer AI Data Platform Workbench zu verarbeiten.

Sie können das Cluster nach der Erstellung jederzeit bearbeiten.

NVIDIA-GPU-Cluster erstellen

Sie können eine NVIDIA-GPU in einem All Purpose Compute-Cluster verwenden, um jede Workload in Ihrer einheitlichen KI- und Datenpipeline zu beschleunigen.

NVIDIA-GPU-Ausprägungen verwenden die folgenden Konfigurationen:

Tabelle 14-1: NVIDIA-GPU-Ausprägungen

| GPU-Anzahl | OCPU | Blockspeicher (GB) | GPU-Arbeitsspeicher (GB) | CPU-Arbeitsspeicher (GB) |

|---|---|---|---|---|

| 1 | 15 | 1500 | 24 | 240 |

| 2 | 30 | 3000 | 48 | 480 |

Hinweis:

Wenn Sie NVIDIA-GPU-Ausprägungen verwenden, müssen sowohl die Ausprägung "Treiber" als auch die Ausprägung "Worker" eine NVIDIA-GPU sein. Das Mischen von CPU- und GPU-Ausprägungen für dasselbe Cluster wird derzeit nicht unterstützt.NVIDIA-GPU-Cluster optimieren

Sie können Ihre NVIDIA-GPU-Cluster optimieren, um ihre Performance zu optimieren, indem Sie Empfehlungen des GPU-Providers verwenden und optionale Bibliotheken installieren.

Durch das Tuning von GPU-Clustern kann die Performance dieser Cluster optimiert werden, wenn sie von Jobs in AI Data Platform Workbench aufgerufen werden.

Für NVIDIA-GPU-basierte Cluster können Sie den Tuning Guide von NVIDIA befolgen, um Empfehlungen und Schritte zur Performanceoptimierung zu erhalten.

Sie haben auch die Möglichkeit, Spark RAPIDS-Bibliotheken zu installieren, um die Optimierung zu unterstützen:

- Die Spark RAPIDS-Bibliothek ist ein RAPIDS-Beschleuniger für Apache Spark und bietet eine Reihe von Plug-ins, die GPUs nutzen, um die Verarbeitung zu beschleunigen.

- Die Spark RAPIDS ML-Bibliothek ermöglicht GPU-beschleunigtes, verteiltes maschinelles Lernen auf Apache Spark und stellt mehrere mit PySpark ML kompatible Algorithmen bereit, die von der RAPIDS-cuML-Bibliothek unterstützt werden.

Die Spark RAPIDS-Bibliothek wird häufig zuerst für das Feature Engineering und die Datenreinigung verwendet. Anschließend wird die Kreuzvalidierung in großem Maßstab mit der Spark RAPIDS ML-Bibliothek durchgeführt. Sie können diese Bibliotheken für Anwendungsfälle wie Betrugserkennung (Zeitreihen), Web-Clickstream und A/B-Experimente verwenden.

Tabelle 14-2: Empfohlene Spark-Konfigurationen

| Einstellung | Datum | Hinweis |

|---|---|---|

| spark.executor.instances | 4 | Anzahl Worker x GPU pro Worker

Wenn die Anzahl der Worker 4 ist und die GPU-Anzahl pro Worker 1 ist, beträgt die empfohlene spark.executor.instances-Konfiguration 4 x 1 = 4 |

| funken.executor.cores | 16 | GPU-Anzahl/Worker/CPU-Cores, maximal 16 |

| funken.executor.memory | 32 GB | 2 GB/Core oder 80% der CPU-Speicher-/GPU-Anzahl pro Worker (je nachdem, welcher Wert kleiner ist) |

| spark.task.resource.gpu.amount | 0,062 | 1 / funken.executor.cores |

| spark.rapids.sql.concurrentGpuTasks | 3 | GPU-Speicher / 8 GB, maximal 4 |

| funken.rapids.shuffle.multiThreaded.writer.threads | 32 | CPU-Cores/GPU-Anzahl pro Worker |

| funken.rapids.shuffle.multiThreaded.reader.threads | 32 | CPU-Cores/GPU-Anzahl pro Worker |

| funken.shuffle.manager | com.nvidia.spark.rapids.spark350. RapidsShuffleManager | - |

| funken.rapids.shuffle.mode | MULTITHREADING | - |

| funken.plugins | com.nvidia.spark.SQLPlugin | - |

| spark.executor.resource.gpu.amount | 1 | - |

| spark.sql.files.maxPartitionBytes | 2 GB | Optional, empfohlen für große Datasets |

| spark.rapids.sql.batchSizeBytes | 2 GB | Optional, empfohlen für große Datasets |

| spark.rapids.memory.host.spillStorageGröße | 32 G | Optional, empfohlen für große Datasets |

| funken.rapids.memory.pinnedPool.size | 8 G | Optional, empfohlen für große Datasets |

| spark.sql.adaptive.coalescePartitionen.minPartitionGröße | 32 MB | Optional, empfohlen für große Datasets |

| spark.sql.adaptive.advisoryPartitionSizeInBytes | 160 MB | Optional, empfohlen für große Datasets |

| spark.rapids.filecache.enabled | True | Optional, empfohlen, wenn Workloads Datasets wiederverwenden |

Cluster ändern

Sie können Einstellungen ändern oder zusätzliche Parameter für Ihre Cluster hinzufügen.

- Navigieren Sie zu Ihrem Workspace, und klicken Sie auf Compute.

- Klicken Sie neben dem Compute-Cluster, das Sie ändern möchten, auf

Aktionen und dann auf Bearbeiten.

Aktionen und dann auf Bearbeiten. - Ändern Sie die Attribute des Compute-Clusters, oder fügen Sie bei Bedarf zusätzliche Parameter hinzu.

- Klicken Sie auf Speichern.

Cluster löschen

Sie können Compute-Cluster löschen, die nicht verwendet oder nicht mehr benötigt werden.

- Navigieren Sie zu Ihrem Workspace, und klicken Sie auf Compute.

- Klicken Sie neben dem zu löschenden Cluster auf

Aktionen, und klicken Sie auf Löschen.

Aktionen, und klicken Sie auf Löschen. - Klicken Sie auf Löschen.

Clusterdetails anzeigen

Sie können die Ausprägung und die Einstellungen eines Clusters jederzeit prüfen.

- Navigieren Sie zu Ihrem Workspace, und klicken Sie auf Compute.

- Klicken Sie auf den Namen des Clusters, für das Sie Details anzeigen möchten.

- Klicken Sie auf die Registerkarte Details.

Wartungsupdates für Compute-Cluster

Oracle AI Data Platform-Compute wendet Wartungsupdates automatisch ohne Benutzereingriff an.

Die Wartungsupdates decken alle erforderlichen Sicherheitspatches oder -fehlerkorrekturen für Betriebssystem und interne Komponenten der AI Data Platform ab. AI Data Platform prüft, ob keine aktiven Cluster vorhanden sind, bevor diese monatlichen Wartungsupdates eingespielt werden.