Gérer le calcul

Cette section décrit les fonctions de base de création, de modification ou de suppression de clusters de calcul dans AI Data Platform Workbench.

Rubriques :

- A propos des clusters de calcul

- Créer un cluster de démarrage rapide

- Créer un cluster personnalisé

- Création d'un cluster de GPU NVIDIA

- Réglage de cluster de GPU NVIDIA

- Modification d'un cluster

- Supprimer un cluster

- Visualiser les détails de cluster

- Mises à jour de maintenance pour les clusters de calcul

A propos des clusters de calcul

Les clusters de calcul polyvalents vous fournissent les ressources de calcul nécessaires pour traiter vos charges de travail dans une instance AI Data Platform Workbench.

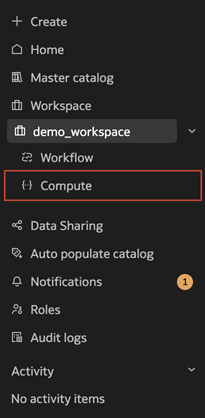

Vous gérez vos clusters de calcul à partir de la page Compute dans Oracle AI Data Platform Workbench.

Types de calcul

Il existe deux types de calcul dans AI Data Platform Workbench : les clusters de calcul polyvalents et le cluster de calcul par défaut du catalogue maître.

Vous pouvez uniquement créer des clusters de calcul polyvalents dans AI Data Platform Workbench. Les clusters de calcul tout usage conviennent à une gamme polyvalente de charges de travail. Ils peuvent être attachés à vos blocs-notes et utilisés dans les workflows. Sauf indication contraire, toute référence à "cluster de calcul" ou "cluster" dans la documentation fait référence aux clusters de calcul polyvalents.

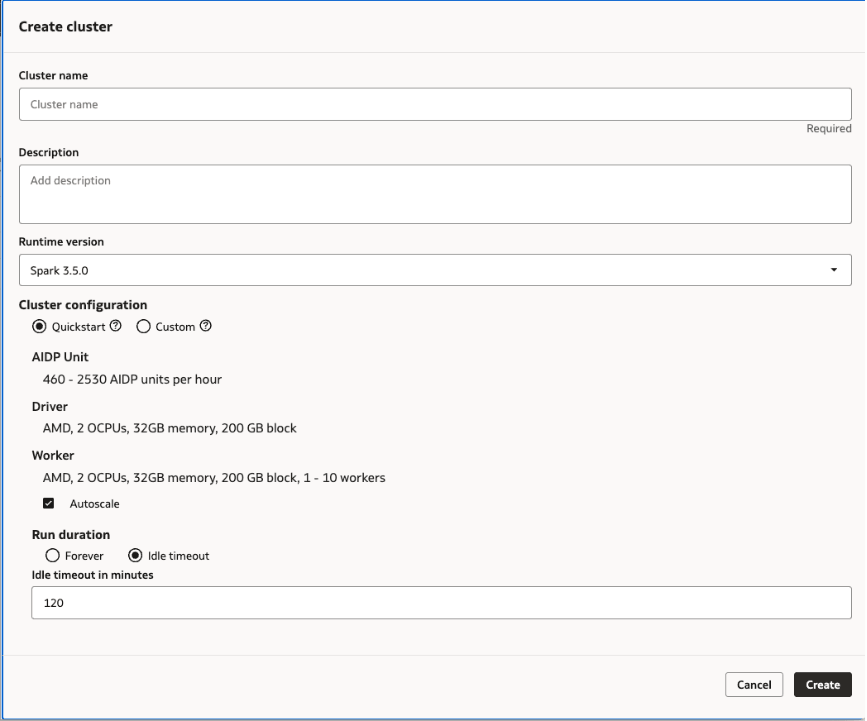

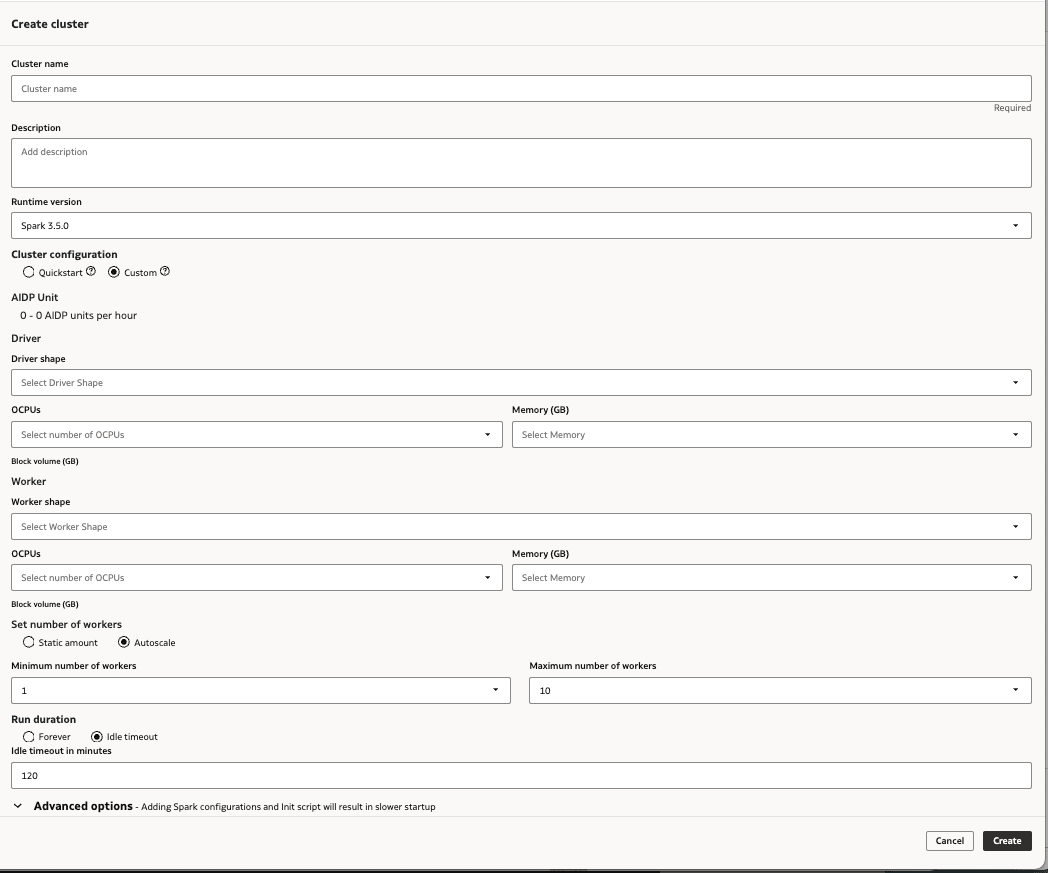

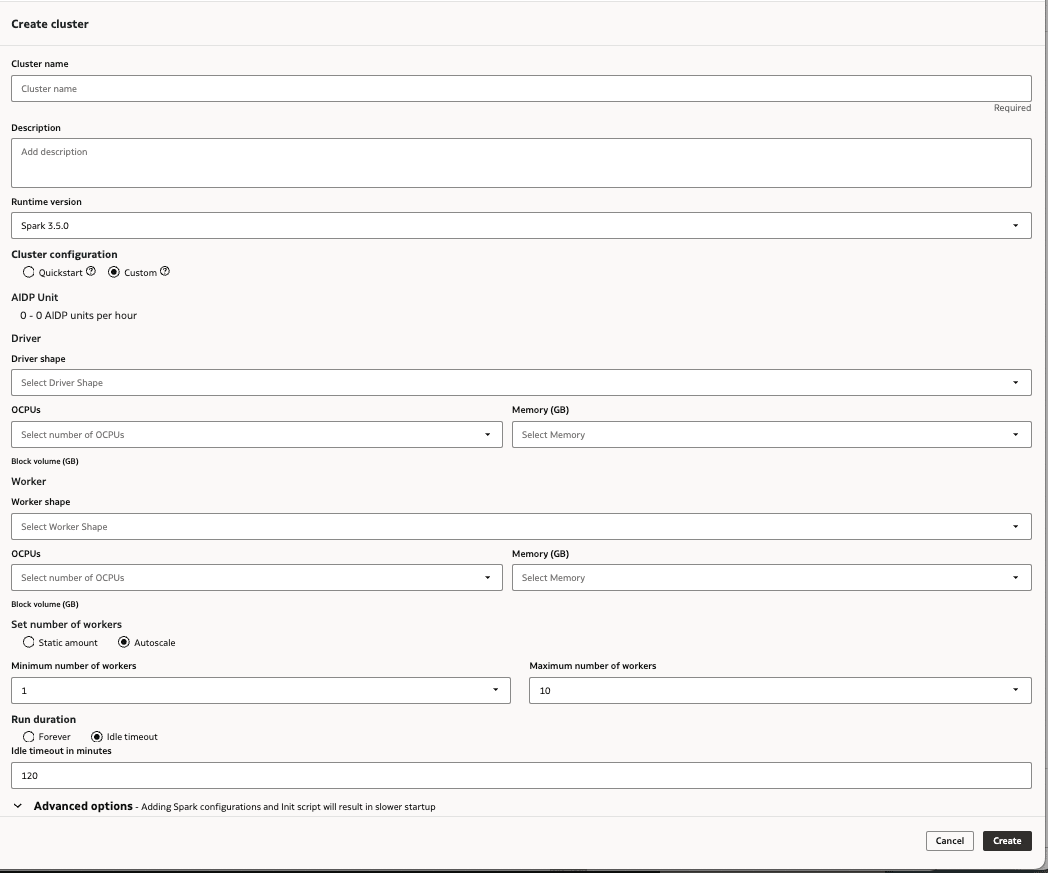

Lorsque vous créez un cluster de calcul polyvalent, vous pouvez choisir la configuration de démarrage rapide ou personnalisée. La configuration Quickstart est optimisée pour fournir un démarrage rapide, tandis que la configuration personnalisée vous permet d'affiner votre cluster de calcul polyvalent pour l'adapter aux charges de travail spécifiques que vous devez traiter. Dans les options de configuration Quickstart et Custom, vous pouvez afficher les projections de coûts et modifier les options de délai d'inactivité.

Remarques :

L'installation de bibliothèques personnalisées sur un cluster de calcul tout usage configuré Quickstart le remplace automatiquement par la configuration personnalisée. Cela peut avoir un impact sur les performances de démarrage.Le cluster de calcul du catalogue principal par défaut est présent dans toutes les instances AI Data Platform Workbench. Ce cluster est responsable des fonctions essentielles d'AI Data Platform Workbench, telles que les balayages de recherche, l'actualisation des objets de catalogue, la création, la modification et la suppression d'objets, et le test des connexions.

Exécution du cluster

Des clusters de calcul polyvalents peuvent être créés avec une exécution Apache Spark 3.5. L'environnement d'exécution est compatible avec :

- Spark 3.5.0

- Delta 3.2.0 (pré-inclus)

- Python 3.11

- Scala 2.12

- Hadoop 3.3.4

- Java 17

Mises à jour de maintenance pour les clusters de calcul

Le calcul d'AI Data Platform Workbench applique automatiquement les mises à jour de maintenance sans intervention de l'utilisateur. Les mises à jour de maintenance couvrent tous les patches de sécurité ou correctifs de bugs nécessaires pour le système d'exploitation et les composants internes d'AI Data Platform Workbench.

AI Data Platform Workbench vérifie qu'aucun cluster n'est en cours d'exécution avant d'appliquer ces mises à jour de maintenance mensuelles.

Créer un cluster de démarrage rapide

Vous pouvez choisir de créer un cluster de calcul polyvalent avec des paramètres préconfigurés pour traiter les données et les charges globales d'IA dans AI Data Platform Workbench.

Vous pouvez modifier votre cluster à tout moment après sa création.

Créer un cluster personnalisé

Vous pouvez créer un cluster de calcul polyvalent avec les paramètres de configuration de votre choix pour traiter les données et les charges de travail d'IA dans AI Data Platform Workbench.

Vous pouvez modifier votre cluster à tout moment après sa création.

Création d'un cluster de GPU NVIDIA

Vous pouvez choisir d'utiliser un GPU NVIDIA dans un cluster de calcul à usage unique pour accélérer n'importe quelle charge de travail dans votre pipeline d'IA et de données unifié.

Les formes de GPU NVIDIA utilisent les configurations suivantes :

Tableau 14-1 Formes de GPU NVIDIA

| Nombre de GPU | OCPU, | Stockage de blocs (Go) | Mémoire GPU (Go) | Mémoire d'UC (Go) |

|---|---|---|---|---|

| 1 | 15 | 1500 | 24 | 240 |

| 2 | 30 | 3 000 | 48 | 480 |

Remarques :

Lorsque vous utilisez des formes de GPU NVIDIA, les formes Driver et Worker doivent toutes deux être des GPU NVIDIA. La combinaison de formes de CPU et de GPU pour le même cluster n'est actuellement pas prise en charge.Réglage de cluster de GPU NVIDIA

Vous pouvez régler vos clusters de GPU NVIDIA pour optimiser leurs performances en utilisant les recommandations du fournisseur de GPU et en installant des bibliothèques facultatives.

Le réglage des clusters de GPU peut aider à optimiser les performances de ces clusters lorsqu'ils sont appelés par des travaux dans AI Data Platform Workbench.

Pour les clusters basés sur des GPU NVIDIA, vous pouvez suivre le guide de réglage de NVIDIA pour obtenir des recommandations et des étapes à suivre pour optimiser les performances.

Vous avez également la possibilité d'installer des bibliothèques Spark RAPIDS pour faciliter l'optimisation :

- La bibliothèque Spark RAPIDS est un accélérateur RAPIDS pour Apache Spark et fournit un ensemble de modules d'extension qui exploitent les GPU pour accélérer le traitement.

- La bibliothèque Spark RAPIDS ML permet l'apprentissage automatique distribué accéléré par GPU sur Apache Spark et fournit plusieurs algorithmes compatibles avec PySpark ML alimentés par la bibliothèque cuML RAPIDS.

La bibliothèque Spark RAPIDS est généralement utilisée en premier pour l'ingénierie des fonctionnalités et le nettoyage des données, puis la validation croisée est effectuée à grande échelle à l'aide de la bibliothèque ML Spark RAPIDS. Vous pouvez utiliser ces bibliothèques pour des cas d'utilisation tels que la détection des fraudes (séries temporelles), le flux de clics Web et l'expérimentation A/B.

Tableau 14-2 Configurations Spark recommandées

| Paramétrage | Value | Note |

|---|---|---|

| spark.executor.instances | 4 | Nombre de salariés x nombre de GPU par salarié

Si le nombre de processus actifs est de 4 et que le nombre de GPU par processus actif est de 1, la configuration spark.executor.instances recommandée est de 4 x 1 = 4 |

| spark.executor.cores | 16 | Nombre de GPU/ Coeurs de processeur/processeur, maximum de 16 |

| spark.executor.memory | 32 GB | 2 Go / cœur ou 80 % de la mémoire CPU / nombre de GPU par processus actif (le moins élevé étant retenu) |

| étincelle.tâche.ressource.gpu.montant | 0,062 | 1 / étincelle.executor.cores |

| spark.rapids.sql.concurrentGpuTasks | 3 | Mémoire GPU / 8 Go, maximum de 4 |

| spark.rapids.shuffle.multiThreaded.writer.threads | 32 | Nombre de coeurs de processeur/GPU par processus actif |

| spark.rapids.shuffle.multiThreaded.reader.threader | 32 | Nombre de coeurs de processeur/GPU par processus actif |

| spark.shuffle.manager | com.nvidia.spark.rapids.spark350. RapidsShuffleManager | - |

| shuffle.mode | MULTITHREAD | - |

| plugins | Com.nvidia.spark.SQLPlugin | - |

| spark.executor.resource.gpu.amount | 1 | - |

| spark.sql.files.maxPartitionBytes | 2 GB | Facultatif, recommandé pour les jeux de données volumineux |

| spark.rapids.sql.batchSizeBytes | 2 GB | Facultatif, recommandé pour les jeux de données volumineux |

| étincelle.rapids.memory.host.spillStockageTaille | 32 G | Facultatif, recommandé pour les jeux de données volumineux |

| étincelle.rapides.memory.pinnedPool.size | 8 G | Facultatif, recommandé pour les jeux de données volumineux |

| spark.sql.adaptive.coalescePartitions.minPartitionSize | 32 Mo | Facultatif, recommandé pour les jeux de données volumineux |

| spark.sql.adaptive.advisoryPartitionSizeInBytes | 160 Mo | Facultatif, recommandé pour les jeux de données volumineux |

| spark.rapids.filecache.enabled | True | Facultatif, recommandé si les charges globales réutiliseront les ensembles de données |

Modification d'un cluster

Vous pouvez modifier les paramètres ou ajouter des paramètres supplémentaires pour vos clusters.

- Accédez à votre espace de travail et cliquez sur Compute.

- En regard du cluster de calcul à modifier, cliquez sur

Actions, puis sur Modifier.

Actions, puis sur Modifier. - Modifiez les attributs de votre cluster de calcul ou ajoutez des paramètres supplémentaires si nécessaire.

- Cliquez sur Enregistrer.

Supprimer un cluster

Vous pouvez supprimer les clusters de calcul qui ne sont plus utilisés ou qui ne sont plus nécessaires.

- Accédez à votre espace de travail et cliquez sur Compute.

- En regard du cluster à supprimer, cliquez sur

Actions, puis sur Supprimer.

Actions, puis sur Supprimer. - Cliquez sur Supprimer.

Visualiser les détails de cluster

Vous pouvez consulter la forme et les paramètres d'un cluster à tout moment.

- Accédez à votre espace de travail et cliquez sur Compute.

- Cliquez sur le nom du cluster pour lequel vous voulez afficher les détails.

- Cliquez sur l'onglet Détails.

Mises à jour de maintenance pour les clusters de calcul

Le calcul Oracle AI Data Platform applique automatiquement les mises à jour de maintenance sans intervention de l'utilisateur.

Les mises à jour de maintenance couvrent tous les patches de sécurité ou correctifs de bugs nécessaires pour le système d'exploitation et les composants internes d'AI Data Platform. AI Data Platform vérifie qu'aucun cluster n'est en cours d'exécution avant d'appliquer ces mises à jour de maintenance mensuelles.