Gestisci computazione

In questa sezione vengono descritte le funzioni di base per la creazione, la modifica o la rimozione dei cluster di computazione nel workbench della piattaforma dati AI.

Argomenti:

Informazioni sui cluster di computazione

I cluster di computazione multifunzione offrono le risorse di computazione per elaborare i carichi di lavoro in un'istanza di AI Data Platform Workbench.

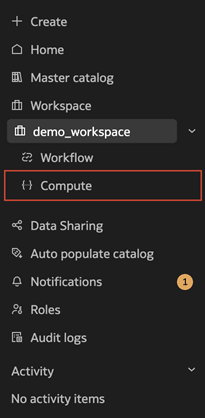

Puoi gestire i cluster di computazione dalla pagina Computazione nel tuo Oracle AI Data Platform Workbench.

Tipi di computazione

Nel workbench di AI Data Platform esistono due tipi di computazione: cluster di computazione multifunzione e cluster di computazione Master Catalog predefinito.

Puoi creare cluster di computazione completi solo nel workbench di AI Data Platform. I cluster di computazione multifunzione sono adatti per una gamma versatile di carichi di lavoro e possono essere collegati ai notebook e utilizzati nei flussi di lavoro. Se non diversamente specificato, i riferimenti a 'cluster di computazione' o 'cluster' nella documentazione fanno riferimento a cluster di computazione tutti gli usi.

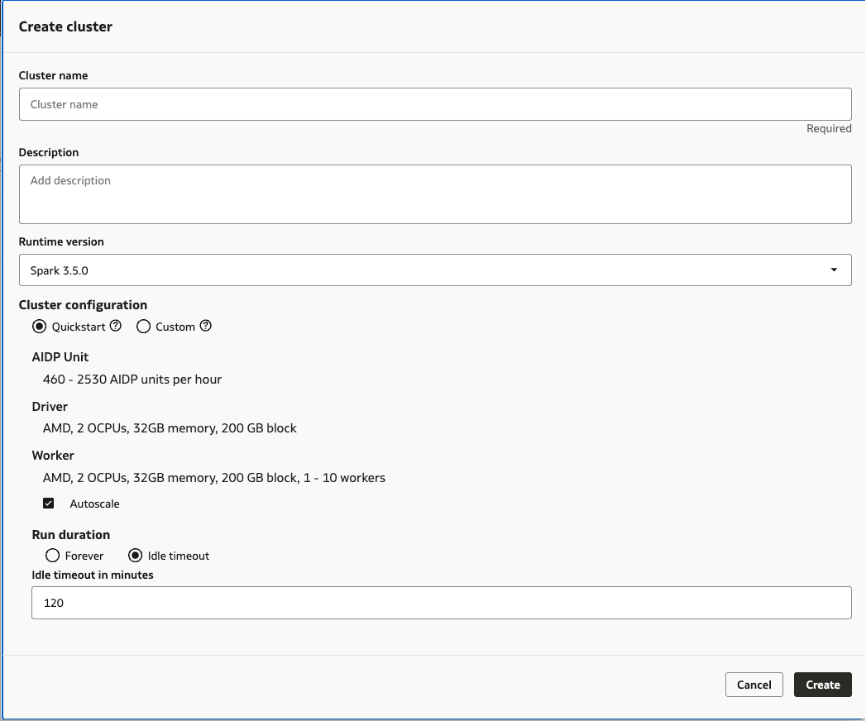

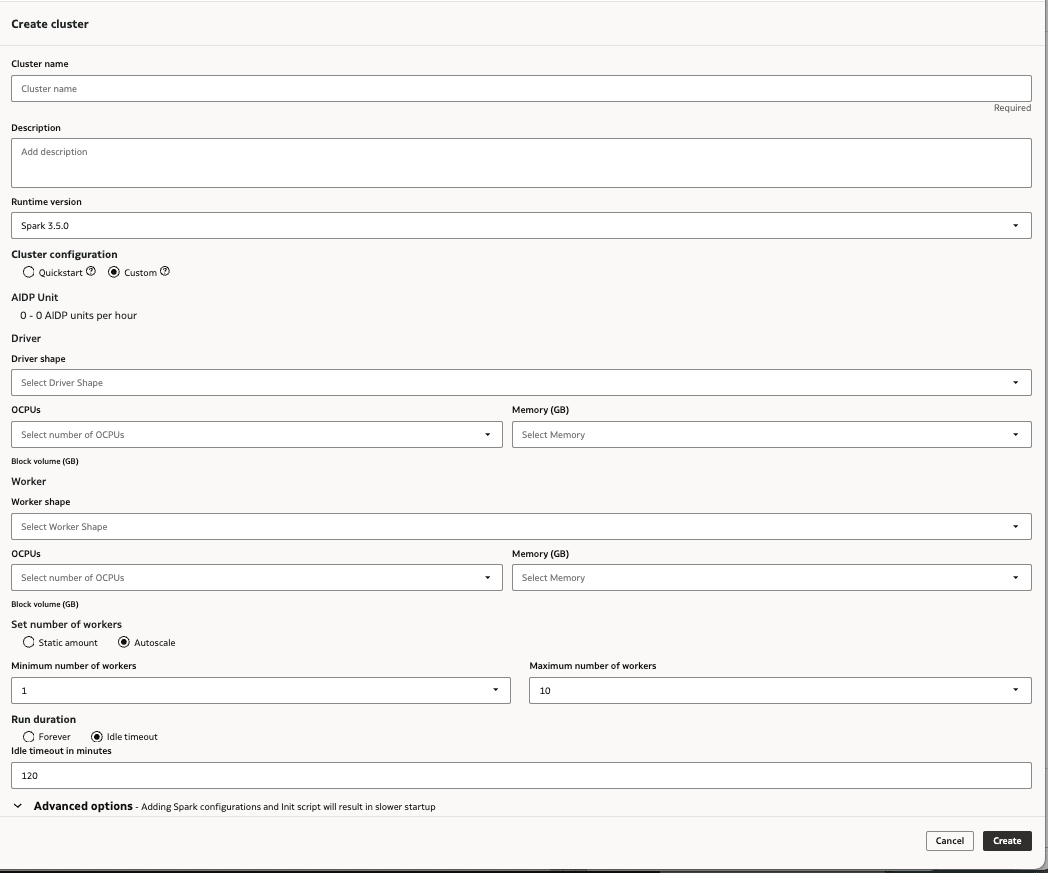

Quando crei un nuovo cluster di computazione per tutti gli scopi, puoi scegliere la configurazione Quickstart o Custom. La configurazione Quickstart è ottimizzata per fornire un avvio rapido, mentre la configurazione personalizzata consente di ottimizzare il cluster di calcolo per tutti gli scopi in base ai carichi di lavoro specifici che è necessario elaborare. In entrambe le opzioni di configurazione Quickstart e Custom, è possibile visualizzare le proiezioni dei costi e modificare le opzioni di timeout inattività.

Nota

L'installazione di librerie personalizzate in un cluster di calcolo per tutti gli scopi configurato Quickstart la modifica automaticamente nella configurazione personalizzata. Ciò può influire sulle prestazioni di avvio.Il cluster di computazione Master Catalog predefinito è presente in tutte le istanze di AI Data Platform Workbench. Questo cluster è responsabile delle funzioni essenziali di AI Data Platform Workbench, come i crawling di ricerca, l'aggiornamento degli oggetti catalogo, la creazione, la modifica e l'eliminazione di oggetti e il test delle connessioni.

Runtime del cluster

I cluster di computazione multifunzione possono essere creati con un runtime Apache Spark 3.5. L'ambiente runtime è compatibile con:

- Spark 3.5.0

- Delta 3.2.0 (pre-incluso)

- Python 3.11

- Scala 2.12

- Hadoop 3.3.4

- Java 17

Aggiornamenti della manutenzione per i cluster di computazione

La computazione di AI Data Platform Workbench applica automaticamente gli aggiornamenti di manutenzione senza l'intervento dell'utente. Gli aggiornamenti di manutenzione coprono tutte le patch di sicurezza necessarie o le correzioni di bug per il sistema operativo e i componenti interni di AI Data Platform Workbench.

AI Data Platform Workbench verifica che non siano presenti cluster in esecuzione prima di applicare questi aggiornamenti di manutenzione mensile.

Creare un cluster Quickstart

Puoi scegliere di creare un cluster di computazione completo con impostazioni preconfigurate per elaborare i dati e i carichi di lavoro AI nel tuo workbench AI Data Platform.

È possibile modificare il cluster in qualsiasi momento dopo la creazione.

Creare un cluster personalizzato

Puoi creare un cluster di computazione completo con impostazioni di configurazione personalizzate scegliendo di elaborare i dati e i carichi di lavoro AI nel tuo workbench AI Data Platform.

È possibile modificare il cluster in qualsiasi momento dopo la creazione.

Creare un cluster GPU NVIDIA

Puoi scegliere di utilizzare una GPU NVIDIA in un cluster di computazione All Purpose per accelerare qualsiasi carico di lavoro nella tua AI e pipeline di dati unificate.

Le forme GPU NVIDIA utilizzano le seguenti configurazioni:

Tabella 14-1 Forme GPU NVIDIA

| Conteggio GPU | OCPU | Storage a blocchi (GB) | Memoria GPU (GB) | Memoria CPU (GB) |

|---|---|---|---|---|

| 1 | 15 | 1500 | 24 | 240 |

| 2 | 30 | 3.000 | 48 | 480 |

Nota

Quando si utilizzano forme GPU NVIDIA, sia la forma Driver che quella Worker devono essere GPU NVIDIA. La combinazione di forme CPU e GPU per lo stesso cluster non è attualmente supportata.Tuning del cluster GPU NVIDIA

È possibile ottimizzare i cluster GPU NVIDIA per ottimizzarne le prestazioni utilizzando i suggerimenti del provider GPU e installando librerie opzionali.

Il tuning dei cluster GPU può aiutare a ottimizzare le prestazioni di tali cluster quando vengono richiamati dai job nel workbench AI Data Platform.

Per i cluster basati su GPU NVIDIA, puoi seguire la Guida al tuning di NVIDIA per suggerimenti e passi da eseguire per ottimizzare le prestazioni.

Hai anche la possibilità di installare librerie Spark RAPIDS per aiutare con l'ottimizzazione:

- La libreria Spark RAPIDS è un acceleratore RAPIDS per Apache Spark e fornisce un set di plugin che sfruttano le GPU per accelerare l'elaborazione.

- La libreria Spark RAPIDS ML consente l'apprendimento automatico distribuito con accelerazione GPU su Apache Spark e fornisce diversi algoritmi compatibili con PySpark ML alimentati dalla libreria cuML RAPIDS.

La libreria Spark RAPIDS viene in genere utilizzata prima per la progettazione delle funzioni e la pulizia dei dati, quindi la convalida incrociata viene eseguita su larga scala utilizzando la libreria ML Spark RAPIDS. È possibile utilizzare queste librerie per casi d'uso quali il rilevamento di frodi (serie temporali), il clickstream Web e la sperimentazione A/B.

Tabella 14-2 Configurazioni Spark consigliate

| Impostazione | Valore | Nota |

|---|---|---|

| spark.executor.instances | 4 | Numero di lavoratori x conteggio GPU per lavoratore

Se il numero di lavoratori è 4 e il conteggio GPU per lavoratore è 1, la configurazione consigliata di spark.executor.instances è 4 x 1 = 4 |

| spark.executor.cores | 16 | Conteggio GPU/worker/core CPU, massimo 16 |

| spark.executor.memory | 32 GB | 2 GB/core o 80% di memoria CPU/conteggio GPU per worker (qualunque sia il valore minore) |

| spark.task.resource.gpu.amount | 0,062 | 1 / spark.executor.cores |

| spark.rapids.sql.concurrentGpuTasks | 3 | Memoria GPU / 8 GB, massimo 4 |

| spark.rapids.shuffle.multiThreaded.writer.thread | 32 | Conteggio memorie centrali CPU/GPU per lavoratore |

| spark.rapids.shuffle.multiThreaded.reader.thread | 32 | Conteggio memorie centrali CPU/GPU per lavoratore |

| spark.shuffle.manager | com.nvidia.spark.rapids.spark350. RapidsShuffleManager | - |

| spark.rapids.shuffle.mode | MULTITHREAD | - |

| spumante.plugins | com.nvidia.spark.SQLPlugin | - |

| spark.executor.resource.gpu.amount | 1 | - |

| spark.sql.files.maxPartitionBytes | 2 GB | Facoltativo, consigliato per set di dati di grandi dimensioni |

| spark.rapids.sql.batchSizeBytes | 2 GB | Facoltativo, consigliato per set di dati di grandi dimensioni |

| spark.rapids.memory.host.spillStorageDimensione | 32 G | Facoltativo, consigliato per set di dati di grandi dimensioni |

| spark.rapids.memory.pinnedPool.size | 8 G | Facoltativo, consigliato per set di dati di grandi dimensioni |

| spark.sql.adaptive.coalescePartitions.minPartitionSize | 32 MB | Facoltativo, consigliato per set di dati di grandi dimensioni |

| spark.sql.adaptive.advisoryPartitionSizeInBytes | 160 MB | Facoltativo, consigliato per set di dati di grandi dimensioni |

| spark.rapids.filecache.enabled | True | Facoltativo, consigliato se i carichi di lavoro riutilizzeranno i set di dati |

Modifica di un cluster

È possibile modificare le impostazioni o aggiungere parametri aggiuntivi per i cluster.

- Passare all'area di lavoro e fare clic su Computazione.

- Avanti al cluster di computazione che si desidera modificare, fare clic su

Azioni, quindi fare clic su Modifica.

Azioni, quindi fare clic su Modifica. - Modificare gli attributi del cluster di computazione o aggiungere parametri aggiuntivi in base alle esigenze.

- Fare clic su Save.

Elimina un cluster

Puoi eliminare i cluster di computazione non utilizzati o non più necessari.

- Passare all'area di lavoro e fare clic su Computazione.

- Avanti al cluster che si desidera eliminare, fare clic su

Azioni e fare clic su Elimina.

Azioni e fare clic su Elimina. - Fare clic su Elimina.

Visualizza dettagli cluster

È possibile rivedere la forma e le impostazioni di un cluster in qualsiasi momento.

- Passare all'area di lavoro e fare clic su Computazione.

- Fare clic sul nome del cluster per il quale si desidera visualizzare i dettagli.

- Fare clic sulla scheda Dettagli.

Aggiornamenti della manutenzione per i cluster di computazione

Oracle AI Data Platform Compute applica automaticamente gli aggiornamenti di manutenzione senza l'intervento dell'utente.

Gli aggiornamenti di manutenzione coprono tutte le patch di sicurezza necessarie o le correzioni di bug per il sistema operativo e i componenti interni di AI Data Platform. AI Data Platform verifica che non siano presenti cluster in esecuzione prima di applicare questi aggiornamenti di manutenzione mensile.