管理计算

本节介绍在 AI 数据平台工作台中创建、更改或删除计算集群的基本功能。

关于计算集群

借助通用计算集群,您可以在 AI 数据平台工作台实例中处理工作负载。

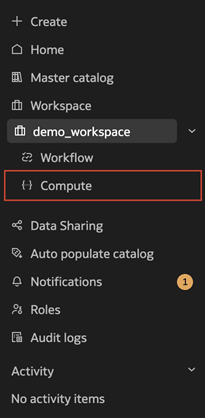

您可以从 Oracle AI Data Platform Workbench 的计算页面管理计算集群。

计算的类型

AI 数据平台工作台中存在两种类型的计算:全用途计算集群和默认主目录计算集群。

您只能在 AI 数据平台工作台中创建所有用途的计算集群。全功能计算集群适用于多种工作负载,可以附加到您的笔记本并用于工作流。除非另有说明,文档中对“计算集群”或“集群”的任何引用都引用了所有用途的计算集群。

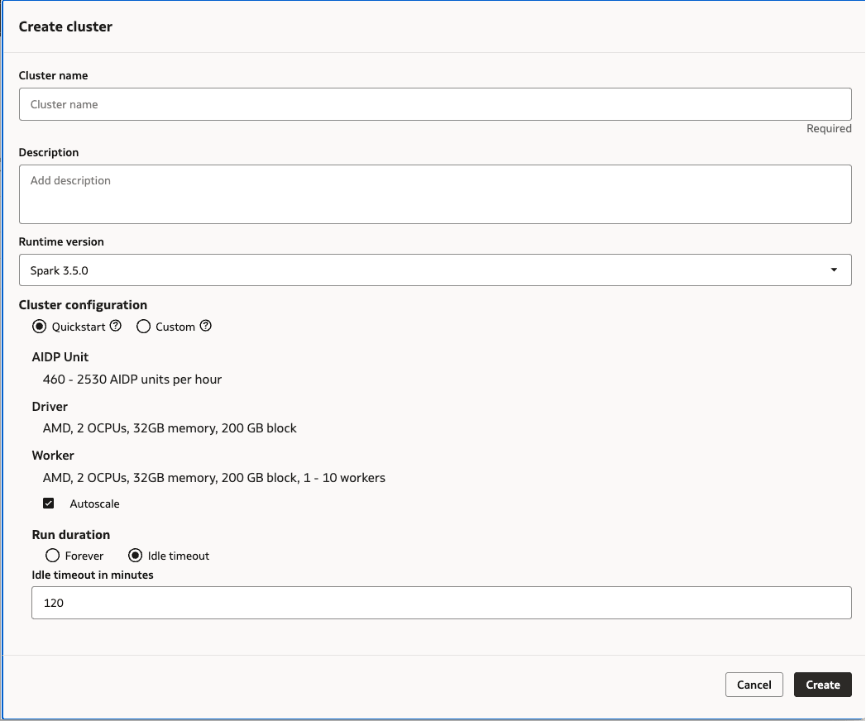

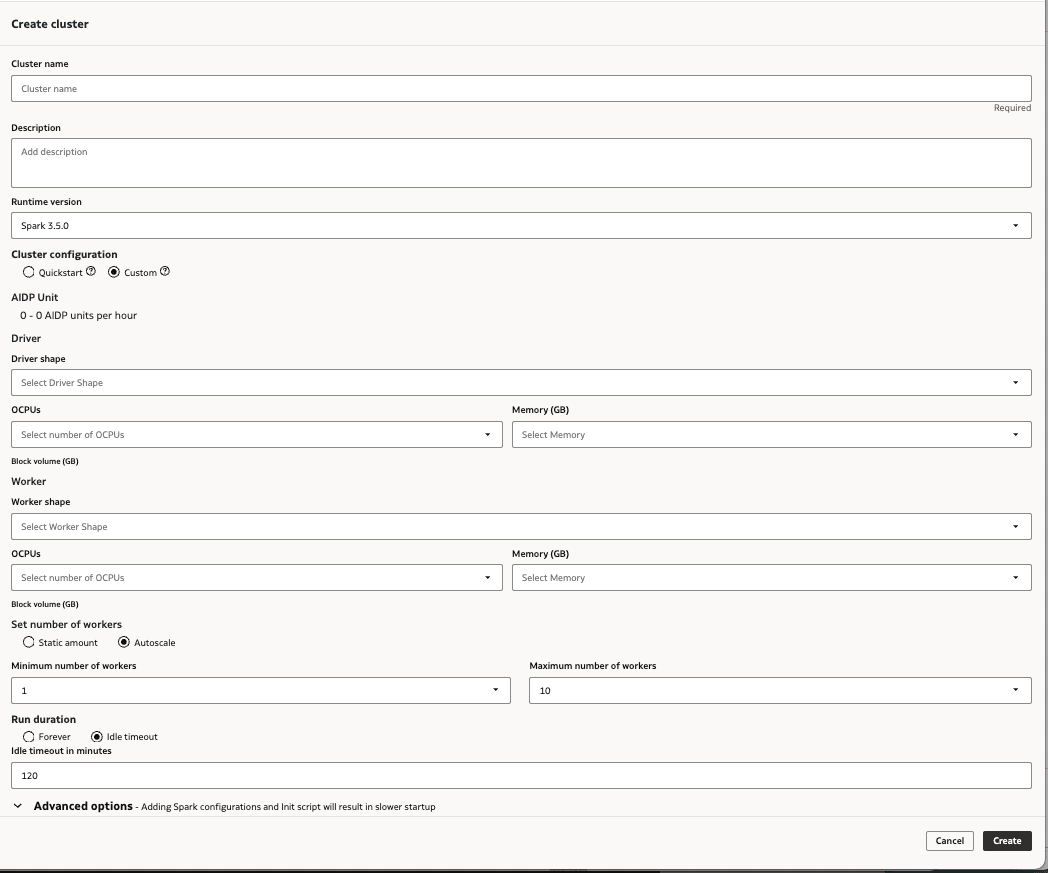

创建新的全用途计算集群时,可以选择快速入门或定制配置。快速入门配置经过优化,可以提供快速启动,而自定义配置允许您微调所有用途的计算集群,以适应您需要处理的特定工作负载。在“快速入门”和“自定义”配置选项中,您可以查看成本预测并修改空闲超时选项。

注意:

将定制库安装到配置了 Quickstart 的所有专用计算集群会自动将其更改为定制配置。这可能会影响启动性能。所有 AI 数据平台工作台实例中都存在默认主目录计算集群。此集群负责基本的 AI 数据平台工作台功能,例如搜索搜索、刷新目录对象、创建、编辑和删除对象以及测试连接。

集群运行时

可使用 Apache Spark 3.5 运行时创建全用途计算集群。运行时环境与以下各项兼容:

- Spark 3.5.0

- Delta 3.2.0(预先包含)

- Python 3.11

- Scala 2.12

- Hadoop 3.3.4

- Java 17

计算集群的维护更新

AI Data Platform Workbench 计算可自动应用维护更新,无需用户干预。维护更新涵盖操作系统和 AI Data Platform Workbench 内部组件的任何必要安全补丁程序或 bug 修复。

AI Data Platform Workbench 在应用这些每月维护更新之前验证没有正在运行的集群。

创建快速入门集群

您可以选择创建具有预配置设置的全功能计算集群,以在 AI 数据平台工作台中处理数据和 AI 工作负载。

创建后,您可以随时编辑集群。

创建定制集群

您可以创建具有您自己选择在 AI 数据平台工作台中处理数据和 AI 工作负载的配置设置的通用计算集群。

创建后,您可以随时编辑集群。

创建 NVIDIA GPU 集群

您可以选择在全用途计算集群中使用 NVIDIA GPU 来加速统一 AI 和数据管道中的任何负载。

NVIDIA GPU 配置使用以下配置:

表 14-1 NVIDIA GPU 配置

| GPU 计数 | OCPU | 块存储 (GB) | GPU 内存 (GB) | CPU 内存 (GB) |

|---|---|---|---|---|

| 1 | 15 | 1500 | 24 | 240 |

| 2 | 30 | 3000 | 48 | 480 |

注意:

使用 NVIDIA GPU 配置时,驱动程序和 Worker 配置必须是 NVIDIA GPU。当前不支持为同一集群混合 CPU 和 GPU 配置。NVIDIA GPU 集群优化

您可以通过使用 GPU 提供程序的建议和安装可选库来优化 NVIDIA GPU 集群,以优化其性能。

当 AI 数据平台工作台中的作业调用这些集群时,优化 GPU 集群有助于优化其性能。

对于基于 NVIDIA GPU 的集群,您可以按照 NVIDIA 的调优指南来获取优化性能的建议和步骤。

您还可以选择安装 Spark RAPIDS 库来帮助优化:

- Spark RAPIDS 库是适用于 Apache Spark 的 RAPIDS 加速器,提供了一组利用 GPU 加速处理的插件。

- Spark RAPIDS ML 库在 Apache Spark 上支持 GPU 加速的分布式机器学习,并提供由 RAPIDS cuML 库支持的多个 PySpark ML 兼容算法。

Spark RAPIDS 库通常首先用于功能工程和数据清理,然后使用 Spark RAPIDS ML 库大规模执行交叉验证。您可以将这些库用于欺诈检测(时间序列)、Web 点击流和 A/B 实验等用例。

表 14-2 建议的 Spark 配置

| 设置 | 值 | 注释 |

|---|---|---|

| spark.executor.instances | 4 | 每个工作进程的 worker 数 x GPU 计数

如果 Worker 数量为 4,并且每个 Worker 的 GPU 计数为 1,则建议的 spark.executor.instances 配置为 4 x 1 = 4 |

| spark.executor.cores | 16 | GPU 计数/工作进程/CPU 核心,最多 16 个 |

| spark.executor.memory | 32 GB | 2GB/核心或 80% 的 CPU 内存/每个工作进程的 GPU 计数(以较小者为准) |

| spark.task.resource.gpu.amount | 0.0625 | 1 个 / spark.executor.cores |

| spark.rapids.sql.concurrentGpu 任务 | 3 | GPU 内存 / 8GB,最多 4 个 |

| spark.rapids.shuffle.multiThreaded.writer.threads | 32 | 每个工作进程的 CPU 核心数/GPU 计数 |

| spark.rapids.shuffle.multiThreaded.reader.threads | 32 | 每个工作进程的 CPU 核心数/GPU 计数 |

| spark.shuffle.manager | com.nvidia.spark.rapids.spark350.RapidsShuffleManager | - |

| spark.rapids.shuffle.mode | 多路径 | - |

| 火花插件 | com.nvidia.spark.SQLPlugin | - |

| spark.executor.resource.gpu.amount | 1 | - |

| spark.sql.files.maxPartitionBytes | 2 GB | 可选,建议用于大型数据集 |

| spark.rapids.sql.batchSizeBytes | 2 GB | 可选,建议用于大型数据集 |

| spark.rapids.memory.host.spillStorageSize | 32 G | 可选,建议用于大型数据集 |

| spark.rapids.memory.pinnedPool.size | 8 G | 可选,建议用于大型数据集 |

| spark.sql.adaptive.coalescePartitions.minPartitionSize | 32 MB | 可选,建议用于大型数据集 |

| spark.sql.adaptive.advisoryPartitionSizeInBytes | 160 MB | 可选,建议用于大型数据集 |

| spark.rapids.filecache.enabled | 真 | 可选,建议在工作负载将重用数据集时使用 |