管理運算

本節涵蓋在 AI Data Platform Workbench 中建立、變更或移除運算叢集的基本功能。

關於運算叢集

所有用途的運算叢集都提供您運算資源,讓您在「AI 資料平台工作台」執行處理中處理工作負載。

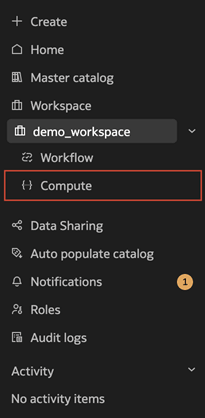

您可以從 Oracle AI Data Platform Workbench 的運算頁面管理運算叢集。

運算型態

您的 AI Data Platform Workbench 有兩種類型的運算:全方位的運算叢集與預設主要目錄運算叢集。

您只能在「AI 資料平台工作台」中建立全用途運算叢集。所有用途的運算叢集適用於各種工作負載,可附加至您的筆記型電腦,並用於工作流程中。除非另有說明,否則文件中對「運算叢集」或「叢集」的任何參照,都會參照所有用途的運算叢集。

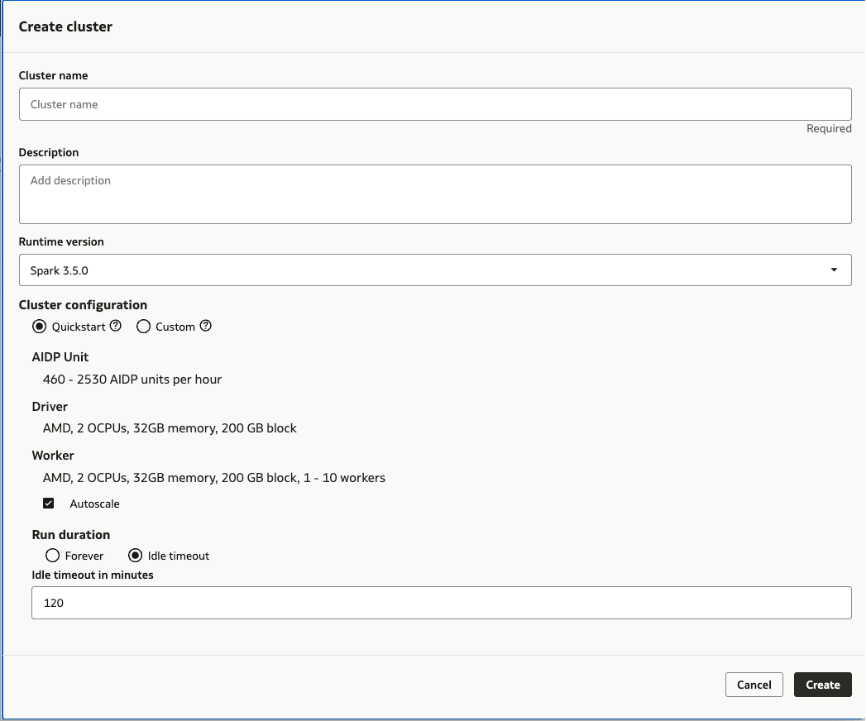

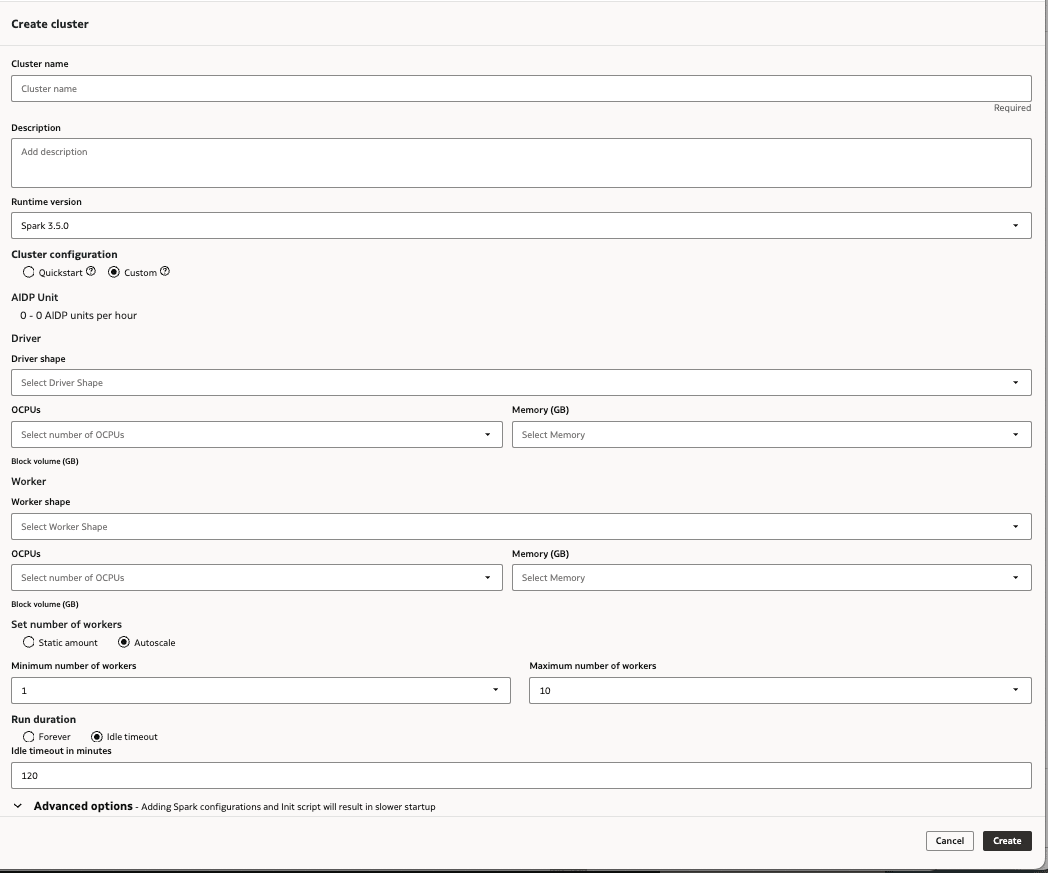

當您建立新的所有用途運算叢集時,可以選擇「快速啟動」或「自訂」組態。「快速啟動」組態經過最佳化,可提供快速啟動;而「自訂」組態則可讓您微調所有用途的運算叢集,以符合處理所需的特定工作負載。在「快速啟動」和「自訂」組態選項中,您可以檢視成本預測並修改閒置逾時選項。

附註:

將自訂程式庫安裝至 Quickstart 設定的所有用途運算叢集,會自動將它變更為「自訂」組態。這可能會影響啟動效能。所有 AI Data Platform Workbench 執行處理中都有「預設主要目錄運算叢集」。此叢集負責必要的 AI Data Platform Workbench 功能,例如搜尋蒐集、重新整理目錄物件、建立、編輯及刪除物件,以及測試連線。

叢集執行時期

可使用 Apache Spark 3.5 程式實際執行建立所有用途的運算叢集。程式實際執行環境與下列相容:

- Spark 3.5.0

- Delta 3.2.0 (已預先納入)

- Python 3.11

- Scala 2.12

- Hadoop 3.3.4

- Java 17

運算叢集的維護更新

AI Data Platform Workbench 運算會自動套用維護更新,無須使用者介入。維護更新涵蓋作業系統和 AI Data Platform Workbench 內部元件的任何必要安全修正程式或錯誤修正。

AI Data Platform Workbench 會先驗證沒有執行中的叢集,再套用這些每月維護更新。

建立快速啟動叢集

您可以選擇建立具有預先設定設定值的全用途運算叢集,以在「AI 資料平台工作台」中處理資料和 AI 工作負載。

您可以在建立叢集之後隨時編輯叢集。

建立自訂叢集

您可以在「AI 資料平台工作台」中建立具有自行選擇處理資料和 AI 工作負載之組態設定值的全用途運算叢集。

您可以在建立叢集之後隨時編輯叢集。

建立 NVIDIA GPU 叢集

您可以選擇在所有用途運算叢集中使用 NVIDIA GPU,加速統一 AI 和資料管線中的任何工作負載。

NVIDIA GPU 資源配置使用下列組態:

表格 14-1 NVIDIA GPU 資源配置

| GPU 數目 | OCPU | 區塊儲存 (GB) | GPU 記憶體 (GB) | CPU 記憶體 (GB) |

|---|---|---|---|---|

| 1 | 15 | 1500 | 24 | 240 |

| 2 | 30 | 3000 | 48 | 480 |

附註:

使用 NVIDIA GPU 資源配置時,「驅動程式」和「工作者」資源配置都必須是 NVIDIA GPU。目前不支援混合相同叢集的 CPU 和 GPU 資源配置。NVIDIA GPU 叢集調整

您可以調整 NVIDIA GPU 叢集,使用 GPU 提供者的建議以及安裝選用的程式庫來最佳化其效能。

調整 GPU 叢集可協助最佳化這些叢集在「AI 資料平台工作台」中的工作呼叫時的效能。

若是 NVIDIA GPU 型叢集,您可以依照 NVIDIA 的調校指南取得最佳化效能的建議和步驟。

您還可以選擇安裝 Spark RAPIDS 程式庫,以協助最佳化:

- Spark RAPIDS 程式庫是 Apache Spark 的 RAPIDS 加速器,提供一組利用 GPU 加速處理的 Plugin。

- Spark RAPIDS ML 程式庫可在 Apache Spark 上啟用 GPU 加速的分散式機器學習,並提供數種由 RAPIDS cuML 程式庫支援的 PySpark ML 相容演算法。

Spark RAPIDS 程式庫通常是先用於圖徵工程和資料清除,然後使用 Spark RAPIDS ML 程式庫大規模執行交叉驗證。您可以使用這些程式庫來進行詐騙偵測 (時間序列)、Web 點擊流及 A/B 實驗等使用案例。

表格 14-2 建議的 Spark 組態

| 設定 | 數值 | 附註 |

|---|---|---|

| spark.executor 執行處理 | 4 | 每一職工的職工人數 x GPU 數目

如果職工人數為 4,而每個職工的 GPU 數目為 1,則建議的 spark.executor.instances 組態為 4 x 1 = 4 |

| 繁體中文 (台灣) | 16 | GPU 數目 / 工作節點 /CPU 核心數目,最多 16 個 |

| 繁體中文 (台灣) | 32 GB | 2GB / 核心或 80% 的 CPU 記憶體 / 每個工作節點的 GPU 數目 (以較低者為準) |

| 繁體中文 (台灣) | 0.0625 | 1 / spark.executor.cores |

| 繁體中文 (香港) | 3 | GPU 記憶體 / 8GB,最大 4 |

| 繁體中文 (台灣) | 32 | 每一工作者的 CPU 核心數 /GPU 數目 |

| 繁體中文 (台灣) | 32 | 每一工作者的 CPU 核心數 /GPU 數目 |

| 繁體中文 (香港) | com.nvidia.spark.rapids.spark350.RapidsShuffleManager | - |

| 繁體中文 (台灣) | 多重執行緒 | - |

| 繁體中文 | 中文版 _ English | - |

| 繁體中文 (台灣) | 1 | - |

| spark.sql.files.max 分割區位元組 | 2 GB | 選擇性,建議用於大型資料集 |

| spark.rapids SQL.batch 大小位元組 | 2 GB | 選擇性,建議用於大型資料集 |

| 繁體中文 (香港) | 32 G | 選擇性,建議用於大型資料集 |

| 繁體中文 (台灣) | 8 G | 選擇性,建議用於大型資料集 |

| 繁體中文 (台灣) | 32 MB | 選擇性,建議用於大型資料集 |

| spark.sql.adaptive.advisory 分割區大小位元組 | 160 MB | 選擇性,建議用於大型資料集 |

| 已啟用 spark.rapids 檔案快取 | 真 | 選擇性,建議工作負載是否重複使用資料集 |