| ナビゲーションリンクをスキップ | |

| 印刷ビューの終了 | |

|

Oracle Solaris 10 1/13 インストールガイド: Live Upgrade とアップグレードの計画 Oracle Solaris 10 1/13 Information Library (日本語) |

| ナビゲーションリンクをスキップ | |

| 印刷ビューの終了 | |

|

Oracle Solaris 10 1/13 インストールガイド: Live Upgrade とアップグレードの計画 Oracle Solaris 10 1/13 Information Library (日本語) |

パート I Live Upgrade を使ったアップグレード

1. Oracle Solaris インストールの計画についての参照先

4. Live Upgrade を使用したブート環境の作成 (タスク)

5. Live Upgrade によるアップグレード (タスク)

6. 障害回復: 元のブート環境へのフォールバック (タスク)

7. Live Upgrade ブート環境の管理 (タスク)

8. 非大域ゾーンがインストールされているシステムにおける Oracle Solaris OS のアップグレード

パート II Live Upgrade を使った ZFS ルートプールのアップグレードと ZFS ルートプールへの移行

Oracle Solaris 10 8/11 リリースの新機能

UFS ルート (/) ファイルシステムから ZFS ルートプールへの移行

Solaris ボリュームマネージャーボリュームで構成された UFS ファイルシステムの ZFS ルートファイルシステムへの移行

非大域ゾーンがインストールされているシステム上への ZFS ブート環境の作成

現在稼動中のシステムからブート環境を作成する場合は、lucreate コマンドで UFS ルート (/) ファイルシステムを ZFS ルートプールにコピーします。コピー処理には、システムによって時間がかかる場合があります。

UFS ファイルシステムから移行する場合は、ディスクスライス上の UFS ルート (/) ファイルシステムをソースブート環境にすることができます。ZFS ルートプール上のソースブート環境から UFS ファイルシステム上のブート環境を作成することはできません。

このセクションで説明するコマンドは、ZFS ルートプールを作成し、UFS ルート (/) ファイルシステムから ZFS ルートプール内に新しいブート環境を作成します。ZFS ルートプールは lucreate を使用する前に作成します。また、アップグレード可能かつブート可能にするために、ディスク全体ではなくスライス上に作成します。ディスクには、EFI ラベルでなく SMI ラベルが必要です。その他の制限事項については、「Live Upgrade 使用時のシステム要件と制限事項」を参照してください。

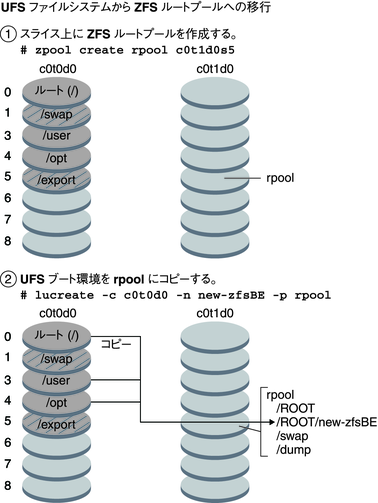

次の図に、ルートプール rpool を別のスライス c0t1d0s5 上に作成する zpool コマンドを示します。ディスクスライス c0t0d0s0 には、UFS ルート (/) ファイルシステムが含まれています。lucreate コマンドの -c オプションで指定する現在稼動中のシステム c0t0d0 が、UFS ルート (/) ファイルシステムです。-n オプションで、作成するブート環境に new-zfsBE という名前を割り当てます。-p オプションでは、新しいブート環境を rpool に配置することを指定します。UFS の /export ファイルシステムと /swap ボリュームは、新しいブート環境にコピーされません。

図 10-1 UFS ファイルシステムから ZFS ルートプールへの移行

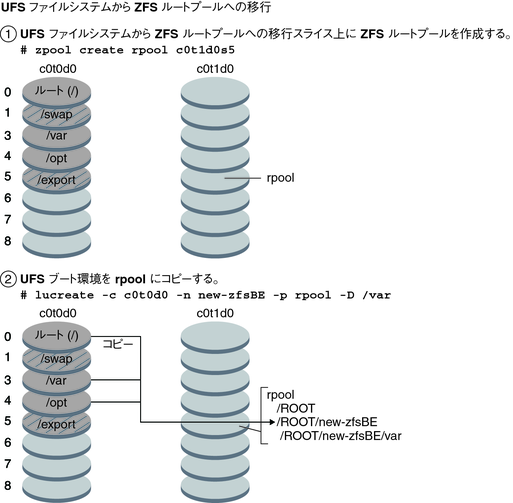

代替ブート環境内で /var についての単独のデータセットの作成を指定するには、lucreate コマンドの -D オプションを使用します。

lucreate -c c0t0d0 -n new-zfsBE -p rpool -D /var

次の図に、このサンプルの lucreate コマンドの一部として rpool 内に作成されるデータセットを示します。

図 10-2 UFS ファイルシステムから ZFS ルートプールへの移行

lucreate コマンドで -D /var を指定しない場合、/var がソースブート環境内で単独のファイルシステムであっても、代替ブート環境内では /var についての単独のデータセットは作成されません。

例 10-1 UFS ルート (/) ファイルシステムから ZFS ルートプールへの移行

この例は、図 10-1と同じコマンドを示しています。これらのコマンドで、新規のルートプール rpool を作成し、UFS ルート (/) ファイルシステムからプール内に新規ブート環境を作成します。この例では、zfs list コマンドで、zpool コマンドによって作成した ZFS ルートプールを表示しています。次の zfs list コマンドでは、lucreate コマンドで作成されたデータセットを表示しています。

# zpool create rpool c0t1d0s5 # zfs list NAME USED AVAIL REFER MOUNTPOINT rpool 5.97G 23.3G 31K /rpool

# lucreate -c c0t0d0 -n new-zfsBE -p rpool # zfs list NAME USED AVAIL REFER MOUNTPOINT rpool 5.97G 23.3G 31K /rpool rpool/ROOT 4.42G 23.3G 31K legacy rpool/ROOT/new-zfsBE 4.42G 23.3G 4.42G / rpool/dump 1.03G 24.3G 16K - rpool/swap 530M 23.8G 16K -

次の zfs list コマンドでは、lucreate コマンドの -D /var オプションを使用することによって、/var について作成された単独のデータセットを示しています。

# lucreate -c c0t0d0 -n new-zfsBE -p rpool -D /var # zfs list NAME USED AVAIL REFER MOUNTPOINT rpool 5.97G 23.3G 31K /rpool rpool/ROOT 4.42G 23.3G 31K legacy rpool/ROOT/new-zfsBE 4.42G 23.3G 4.42G / rpool/ROOT/new-zfsBE/var 248MG 23.3G 248M /var rpool/dump 1.03G 24.3G 16K - rpool/swap 530M 23.8G 16K -

新しいブート環境は /new-zfsBE です。ブート環境 new-zfsBE は、すぐにアップグレードおよびアクティブにできます。

Solaris ボリュームマネージャー (SVM) ボリュームがあるシステムでも、UFS ファイルシステムの移行が可能です。既存の SVM 構成から UFS ブート環境を作成するため、現在稼動中のシステムから新規ブート環境を作成します。その後、その新しい UFS ブート環境から ZFS ブート環境を作成します。

例 10-2 SVM ボリュームのある UFS ルート (/) ファイルシステムから ZFS ルートプールへの移行

SVM ボリュームのあるシステムを移行する場合、SVM ボリュームは無視されます。次の例に示すように、ルートプール内にミラーを設定できます。

この例では、-m オプションを指定した lucreate コマンドで、現在稼動中のシステムから新規ブート環境を作成します。ディスクスライス c1t0d0s0 には、SVM ボリュームで構成された UFS ルート (/) ファイルシステムが含まれています。zpool コマンドで、ルートプール c1t0d0s0、および RAID-1 ボリューム (ミラー) c2t0d0s0 を作成します。2 番目の lucreate コマンドの -n オプションで、作成するブート環境に c0t0d0s0 という名前を割り当てます。-s オプションでは、UFS ルート (/) ファイルシステムを指定します。-p オプションでは、新しいブート環境を rpool に配置することを指定します。

# lucreate -n ufsBE -m /:/dev/md/dsk/d104:ufs # zpool create rpool mirror c1t0d0s0 c2t1d0s0 # lucreate -n c0t0d0s0 -s ufsBE -p zpool

ブート環境 c0t0d0s0 は、すぐにアップグレードおよびアクティブにできます。